Les prochaines frontières de l'IA au-delà du scaling

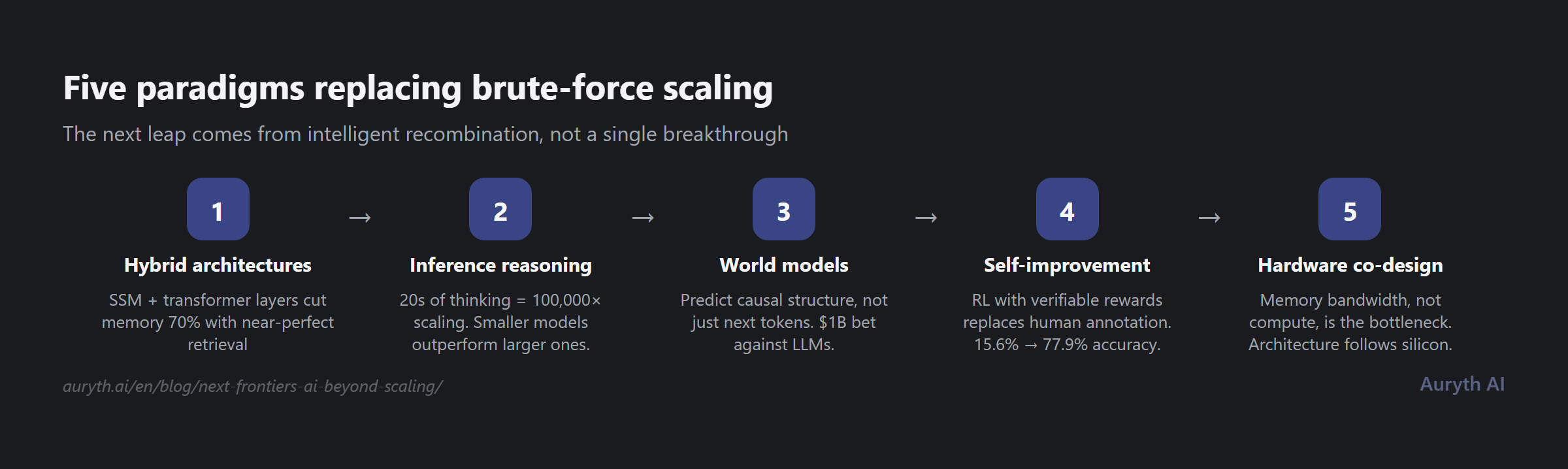

L'ère des modèles toujours plus grands touche à sa fin. Cinq paradigmes remplacent le scaling par la force brute — architectures hybrides, raisonnement au moment de l'inférence, modèles du monde, boucles d'auto-amélioration et co-conception matérielle. Ce que chacun signifie pour l'IA dans les secteurs réglementés.

Par Auryth Team

Les architectes du scaling de l’IA déclarent eux-mêmes que leur propre paradigme touche à sa fin. Ilya Sutskever, dont les travaux sur les lois de scaling ont façonné les cinq dernières années de recherche en IA, a confié à The Decoder que « nous passons de l’ère du scaling à l’ère de la recherche ». Yann LeCun a quitté Meta pour miser plus d’un milliard de dollars sur le fait que les grands modèles de langage sont une impasse. Même Dario Amodei refuse de présumer que dépenser davantage en puissance de calcul garantit le progrès.

Ce n’est pas un débat abstrait. Si vous travaillez dans un secteur réglementé — fiscalité, droit, conformité — la prochaine génération d’outils d’IA sur lesquels vous comptez sera façonnée par le paradigme qui l’emportera. Comprendre ce qui arrive vous aide à distinguer le réel du battage médiatique.

En résumé : cinq approches distinctes remplacent le scaling par la force brute, chacune s’attaquant à une limitation différente des systèmes actuels. Aucune ne l’emportera seule. Le prochain bond viendra de leur combinaison.

Les architectures hybrides remplacent discrètement les transformers purs

L’architecture transformer qui alimente aujourd’hui tous les grands modèles de langage souffre d’un problème fondamental : l’auto-attention croît de façon quadratique avec la longueur de la séquence. Doublez la fenêtre de contexte, quadruplez le calcul. Cela fonctionnait quand les modèles traitaient quelques milliers de tokens. Cela cesse de fonctionner quand il faut parcourir des codes juridiques entiers.

La solution n’est pas de remplacer les transformers — c’est de les diluer. Les systèmes en production d’IBM, NVIDIA et AI21 intercalent désormais des couches d’attention transformer avec des couches de modèles d’espace d’états (SSM). Jamba d’AI21 utilise une couche d’attention sur huit au total. IBM Granite 4.0 en utilise une sur dix. Le Nemotron-H de NVIDIA descend à environ 8 % d’attention.

Les résultats importent pour les applications professionnelles : 70 % de consommation mémoire en moins, un débit deux à cinq fois supérieur, et une extraction de documents quasi parfaite même avec un minimum de couches d’attention.

Pourquoi ne pas descendre à zéro attention ? Parce qu’une étude d’ablation de 2025 a montré que la suppression de toutes les couches d’attention fait chuter la précision d’extraction à littéralement zéro. Les couches SSM ne contribuent en rien à l’extraction par elles-mêmes. Mais il faut bien moins de couches d’attention que quiconque ne le supposait — trois suffisent pour une extraction fiable dans un modèle à 50 couches.

Pour les systèmes de génération augmentée par la recherche comme celui qui alimente Auryth, c’est directement pertinent. Les architectures hybrides permettent une recherche plus rapide dans de plus grandes bases de données juridiques, des fenêtres de contexte effectives plus longues pour le croisement de dispositions, et des coûts d’inférence réduits par requête — sans sacrifier la précision qu’exige la recherche pondérée par l’autorité.

Le raisonnement au moment de l’inférence échange du temps de réflexion contre de la taille de modèle

La loi de scaling la plus importante découverte récemment ne concerne pas l’entraînement. Elle concerne l’inférence.

Noam Brown d’OpenAI l’a dit sans détour : laisser un modèle réfléchir pendant 20 secondes sur une main de poker a produit le même gain de performance que de multiplier la taille du modèle par 100 000 et la durée d’entraînement par 100 000. L’article fondateur de Snell et al. a démontré qu’une allocation optimale du calcul au moment du test permet à des modèles plus petits de surpasser des modèles bien plus grands lors d’évaluations comparables.

Les modèles de la série o d’OpenAI utilisent l’apprentissage par renforcement à grande échelle pour générer des chaînes de pensée internes — y compris des retours en arrière et de l’auto-correction. Leur o4-mini atteint 99,5 % sur des problèmes de compétitions mathématiques pour environ 30 % du coût d’o3.

Mais il existe deux plafonds infranchissables. Le plafond de coût : les requêtes complexes peuvent nécessiter plus de 100 fois le calcul d’une seule passe. Le plafond de temps réel est plus subtil et plus lourd de conséquences — quand les évaluations prennent trois semaines parce que le modèle a besoin de trois semaines pour réfléchir, le temps lui-même devient le goulot d’étranglement.

La recherche montre qu’aucune stratégie de raisonnement unique ne domine universellement. L’auto-cohérence (vote majoritaire) plafonne indépendamment du calcul supplémentaire. Les modèles de récompense par processus qui fournissent un retour étape par étape sont 8 % plus précis et jusqu’à cinq fois plus efficaces en calcul. Les variantes de recherche arborescente Monte Carlo décident dynamiquement s’il faut explorer de nouveaux candidats ou affiner ceux qui existent.

Pour le scoring de confiance dans les contextes professionnels, les implications sont directes. Un système capable d’investir davantage de temps de réflexion sur les requêtes ambiguës — et de signaler quand sa confiance est faible — est fondamentalement plus utile qu’un système qui traite chaque question de façon identique. Le défi est de rendre cela computationnellement viable pour un usage professionnel en temps réel.

Les modèles du monde et les systèmes neurosymboliques ciblent le raisonnement lui-même

Le clivage le plus profond dans la recherche en IA oppose aujourd’hui le scaling des modèles de langage à des approches fondamentalement différentes de la compréhension.

La nouvelle entreprise de LeCun, AMI Labs, a levé 1,03 milliard de dollars pour une valorisation de 3,5 milliards — avec NVIDIA, Bezos et Samsung parmi les investisseurs — afin de construire des systèmes basés sur l’architecture prédictive à embeddings joints (JEPA). Au lieu de prédire le prochain token, JEPA prédit des représentations abstraites de la réalité. L’objectif est la compréhension causale plutôt que la correspondance statistique de motifs.

La position de LeCun est sans ambiguïté : « Si vous vous intéressez à l’IA de niveau humain, ne travaillez pas sur les LLM. »

Le contre-argument pragmatique vient de systèmes qui associent réseaux neuronaux et vérification formelle. AlphaProof de DeepMind, publié dans Nature, combine un modèle de langage avec l’apprentissage par renforcement pour démontrer des énoncés mathématiques dans le langage formel Lean. Lors de l’Olympiade internationale de mathématiques 2024, il a résolu des problèmes que seuls cinq concurrents humains avaient réussis — et chaque preuve a été vérifiée par le démonstrateur de théorèmes. Aucune hallucination possible.

Cela importe pour l’IA juridique car cela démontre une architecture viable pour un raisonnement prouvablement correct. Un système capable de vérifier formellement ses propres conclusions par rapport à une base de connaissances juridiques — pas seulement extraire et résumer, mais prouver la cohérence logique — représenterait un saut qualitatif par rapport aux approches RAG actuelles.

Le benchmark ARC-AGI de François Chollet continue d’exposer l’écart. Le meilleur modèle commercial obtient 37,6 % sur des tâches qui exigent un véritable raisonnement plutôt qu’une correspondance de motifs. L’intuition centrale de Chollet : « Les performances de raisonnement de l’IA de pointe restent fondamentalement contraintes à la couverture des connaissances. » Le raisonnement humain généralise au-delà des données d’entraînement d’une manière que les systèmes actuels ne parviennent pas à reproduire.

L’auto-amélioration fonctionne mais se heurte à des limites strictes

DeepSeek-R1 a démontré quelque chose de frappant : appliquer l’apprentissage par renforcement directement à un modèle de base avec uniquement des récompenses basées sur la justesse — sans fine-tuning supervisé, sans démonstrations humaines — a produit un modèle qui a spontanément développé l’auto-vérification et la réflexion. Les taux de réussite sur des problèmes de compétitions mathématiques sont passés de 15,6 % à 77,9 % par apprentissage par renforcement pur.

Mais le même article a révélé une limite critique : l’apprentissage par renforcement sur des modèles plus petits « ne peut tout simplement pas rivaliser avec la distillation à partir d’un enseignant plus capable ». Un modèle distillé de 32 milliards de paramètres a surpassé des modèles plus grands effectuant leur propre apprentissage par renforcement à partir de zéro.

L’auto-amorçage pur a un plafond. Il faut d’abord un enseignant solide. Cela remet en question les visions les plus optimistes d’auto-amélioration récursive tout en validant une voie plus nuancée : les grands modèles de pointe génèrent des traces de raisonnement vérifiées, qui sont distillées dans des modèles plus petits, lesquels servent de fondation pour le prochain cycle d’amélioration.

La révolution plus large du post-entraînement est passée des préférences humaines aux récompenses vérifiables. Justesse mathématique, exécution de code, systèmes de preuve formelle — ceux-ci remplacent l’annotation humaine coûteuse par une vérification automatisée. C’est le même principe qui sous-tend le scoring de confiance d’Auryth : la vérifiabilité plutôt que l’auto-évaluation du modèle.

L’effondrement de modèle — la dégradation quand les modèles s’entraînent sur leurs propres sorties — est réel mais gérable. La découverte critique : si l’on conserve les données réelles originales dans le mélange d’entraînement, l’effondrement est évité. Avec plus de 74 % des pages web nouvellement créées contenant désormais du texte généré par l’IA, la curation des données est devenue aussi importante que l’algorithme d’entraînement lui-même.

Le matériel est la main invisible qui façonne chaque architecture

Les transformers ont gagné grâce aux GPU, pas malgré eux. L’auto-attention est une multiplication de matrices denses qui atteint 80 à 90 % d’utilisation matérielle. Les SSM, avec leurs opérations récurrentes, plafonnaient initialement à 10-15 % d’utilisation — les rendant plus lents en pratique malgré un meilleur scaling théorique.

Le mur de la bande passante mémoire est devenu la contrainte dominante. L’inférence des modèles de langage est limitée par la bande passante mémoire, pas par la puissance de calcul. C’est pourquoi Cerebras, avec sa bande passante mémoire massive sur puce, offre environ deux fois la vitesse des derniers GPU NVIDIA pour les grands modèles.

La consommation d’énergie émerge comme un facteur architectural déterminant. Les centres de données américains ont consommé 183 térawattheures en 2024. La consommation d’énergie de l’IA seule pourrait atteindre 134 térawattheures par an d’ici 2026 — l’équivalent de la consommation totale de la Suède. Cette pression thermodynamique favorise les architectures qui n’activent qu’une fraction de leurs paramètres par requête : les modèles à mélange d’experts, la quantification agressive, et potentiellement les approches neuromorphiques.

Pour les applications professionnelles de l’IA, la trajectoire matérielle a une implication concrète : les coûts d’inférence détermineront quels outils d’IA sont commercialement viables à grande échelle. Les architectures qui fournissent des résultats précis avec le moins de calcul par requête — exactement l’efficacité que la recherche hybride et la recherche ciblée offrent — gagneront la course au déploiement.

Ce que cela signifie pour l’IA dans les secteurs réglementés

Cinq paradigmes convergent. Les architectures hybrides apportent vitesse et capacité de passage à l’échelle. Le raisonnement au moment de l’inférence apporte de la profondeur sur les problèmes difficiles. Les modèles du monde promettent une compréhension causale. Les boucles d’auto-amélioration réduisent la dépendance à l’annotation humaine. Les contraintes matérielles imposent l’efficacité.

Pour les professionnels qui dépendent de l’IA pour la recherche — en fiscalité, en droit, en conformité — trois conséquences s’ensuivent.

Premièrement, la précision s’améliorera non pas grâce à des modèles plus grands, mais grâce à de meilleures architectures de raisonnement. Les systèmes capables d’investir davantage de calcul sur les requêtes difficiles, de vérifier leurs propres conclusions et de signaler une véritable incertitude remplaceront ceux qui traitent chaque question de la même manière.

Deuxièmement, les systèmes basés sur la recherche documentaire deviennent plus importants, pas moins. À mesure que les modèles de langage se heurtent à des murs de données et à des plateaux de scaling, la capacité à chercher, classer et citer des sources faisant autorité — le cœur de ce qu’Auryth construit — devient le facteur de différenciation plutôt que les seules données d’entraînement.

Troisièmement, le coût de l’inférence IA déterminera quels outils survivront commercialement. Les architectures qui offrent une précision de niveau professionnel à des coûts de calcul soutenables surpasseront à la fois les chatbots bon marché mais peu fiables et les modèles de pointe brillants mais coûteux. Le point d’équilibre se trouve dans les systèmes augmentés par la recherche avec un raisonnement ciblé — précis là où ça compte, efficaces partout ailleurs.

L’ère du « il suffit de faire plus grand » est révolue. L’ère du « faire plus intelligent » a commencé.