AI en beroepsaansprakelijkheid: wat als het antwoord fout is?

Wanneer AI-gestuurd fiscaal onderzoek tot fout advies leidt, is het Belgisch recht duidelijk: de professional betaalt. Maar dat is net het sterkste argument vóór transparante AI — niet ertegen.

Door Auryth Team

Een Belgische belastingconsulent vertrouwt op een AI-tool om het geldende tarief voor de beleggingsstructuur van een cliënt op te zoeken. De tool haalt Art. 19bis WIB 92 op — bestaand artikel, bestaand wetboek — maar serveert de versie van vóór de laatste programmawet het wijzigde. De adviseur geeft advies op basis van het verouderde tarief. De cliënt handelt ernaar. De aanslag komt. De schade is aangericht.

Wie betaalt?

Het Belgisch recht beantwoordt deze vraag zonder enige ambiguïteit. De professional betaalt. Elke keer. Ongeacht welke tool de fout veroorzaakte.

Het aansprakelijkheidskader dat al bestaat

België heeft geen nieuwe AI-wetgeving nodig om de aansprakelijkheidsvraag te beantwoorden. Boek 6 van het Burgerlijk Wetboek — dat in werking trad op 1 januari 2025 — biedt het volledige kader.

Art. 6.5 stelt dat iedereen aansprakelijk is voor schade veroorzaakt door zijn fout. Art. 6.6 definieert fout als ofwel een schending van een specifieke wettelijke regel, ofwel een schending van de algemene zorgvuldigheidsnorm. Geen onderscheid tussen een fout die u handmatig maakte en een fout die u maakte door een tool te vertrouwen.

De maatstaf is de normaal voorzichtige en bekwame beroepsbeoefenaar in dezelfde omstandigheden. Een belastingconsulent die op AI-output vertrouwt zonder verificatie valt onder deze norm, net zoals iemand die op een verouderd papieren wetboek vertrouwt.

Een belangrijke wijziging in het nieuwe Boek 6: Art. 6.3 schaft het oude samenloopverbod af. Een cliënt die schade lijdt door fout fiscaal advies kan nu zowel contractuele als buitencontractuele vorderingen tegen dezelfde adviseur instellen. Dit verbreedt het blootstellingsoppervlak van de adviseur.

De AI-foutenexplosie die niemand verwachtte

De aansprakelijkheidsvraag is niet hypothetisch. Wereldwijd zijn 486 gedocumenteerde gevallen van AI-hallucinatiefouten geïdentificeerd in gerechtelijke procedures — 324 alleen al in Amerikaanse rechtbanken. Meer dan 200 daarvan vonden plaats in de eerste acht maanden van 2025 (Jones Walker, 2025).

De baanbrekende zaak: Mata v. Avianca (SDNY, 2023). Advocaten dienden een conclusie in met zes volledig verzonnen zaakreferenties gegenereerd door ChatGPT. De zaken bestonden niet. De geciteerde rechters hadden die beslissingen nooit geschreven. Het resultaat: $5.000 boete en een verwoeste professionele reputatie.

Maar Mata v. Avianca was slechts het begin. Medio 2025 sanctioneerden drie afzonderlijke Amerikaanse federale rechtbanken advocaten voor door AI gegenereerde hallucinaties in een periode van twee weken. Sancties liepen op tot $10.000 per incident.

De meest alarmerende ontwikkeling: in september 2025 werden advocaten gesanctioneerd niet voor het indienen van door AI verzonnen citaties, maar voor het niet detecteren dat de citaties van de tegenpartij verzonnen waren. De verificatieplicht breidt uit.

De afhankelijkheidsval

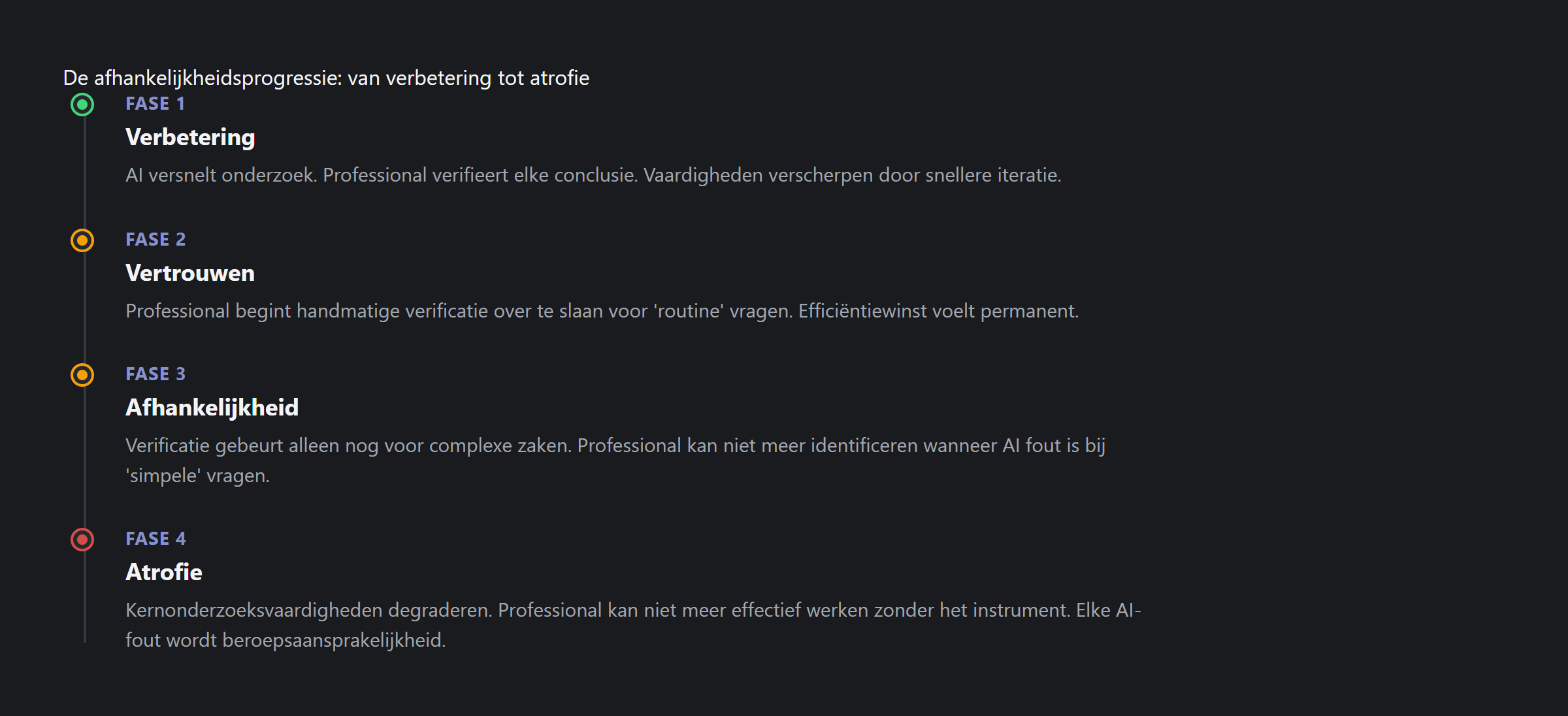

Deze zaken onthullen een patroon dat verder gaat dan individuele onzorgvuldigheid. Onderzoekers hebben een vierfasige afhankelijkheidsprogressie geïdentificeerd in hoe professionals AI adopteren (Jones Walker, 2025):

- Versterking — AI assisteert bij routinetaken; de professional behoudt volledig begrip

- Integratie — AI behandelt steeds complexer werk naarmate het vertrouwen groeit

- Afhankelijkheid — de professional heeft moeite om zonder AI te werken

- Atrofie — onafhankelijke beroepsvaardigheden verslechteren

Veel kenniswerkers hebben al fase 3 bereikt. Dit is waar het aansprakelijkheidsrisico piekt: de professional vertrouwt AI genoeg om te stoppen met verifiëren, maar heeft nog niet genoeg vaardigheid verloren om op te vallen — totdat er iets misgaat.

De gevaarlijkste fase van AI-adoptie is wanneer de professional de tool genoeg vertrouwt om te stoppen met controleren, maar niet genoeg om te begrijpen wanneer het faalt.

Wat de EU vereist — en wat niet

De EU AI Act (Verordening 2024/1689) introduceert AI-geletterdheidsverplichtingen (Art. 4, van kracht sinds 2 februari 2025) en gebruikersverplichtingen voor AI-systemen met een hoog risico (Art. 26, volledige naleving tegen 2 augustus 2027). Professionals die AI gebruiken voor fiscaal onderzoek kunnen kwalificeren als “gebruikers” — wat menselijk toezicht, monitoring en registratie vereist.

De herziene Productaansprakelijkheidsrichtlijn (van kracht sinds 8 december 2024, omzettingsdeadline 9 december 2026) dekt nu expliciet software, inclusief AI-systemen. Als een AI-tool een gebrekkige output produceert — verouderde wetgeving serveren, bijvoorbeeld — kan de fabrikant risicoaansprakelijkheid oplopen. Dit creëert een verhaalsmogelijkheid: de professional betaalt de cliënt, en claimt vervolgens bij de AI-aanbieder.

Wat de EU niet heeft: een geharmoniseerde AI-aansprakelijkheidsrichtlijn. De voorgestelde AI Liability Directive werd ingetrokken in oktober 2025 nadat belanghebbenden het niet eens konden worden over causaliteitsvermoedens. Dit betekent dat Belgische professionals volledig terugvallen op nationaal aansprakelijkheidsrecht — Art. 6.5 en 6.6 BW.

Het contraire argument: AI NIET gebruiken wordt het risico

De meeste professionals beschouwen AI als een aansprakelijkheidsrisico. De interessantere vraag is of het risico verschuift in de tegenovergestelde richting.

ABA Model Rule 1.1 (Commentaar 8, gewijzigd 2012) vereist van advocaten dat zij “op de hoogte blijven van veranderingen in het recht en de praktijk, inclusief de voordelen en risico’s verbonden aan relevante technologie.” ABA’s Formal Opinion 512 (juli 2024) breidde dit expliciet uit naar generatieve AI: advocaten moeten “een redelijk begrip hebben van de mogelijkheden en beperkingen” van AI-tools.

Het patroon is bekend. Toen elektronische juridische databanken beschikbaar kwamen — Jura, monKEY, Fisconetplus — verklaarde geen enkele rechtbank handmatig onderzoek als nalatig. Maar de standaard verschoof organisch. Rechtbanken en collega’s gingen databank-gestuurd onderzoek als basiscompetentie beschouwen. Vandaag zou een belastingconsulent die een complexe grensoverschrijdende vraag onderzoekt met alleen papieren wetboeken als onzorgvuldig worden beschouwd, niet als principieel.

AI-onderzoekstools volgen hetzelfde traject. Als een tool aantoonbaar sneller wetswijzigingen opvangt dan handmatige monitoring, kan een professional die het negeert dan beweren aan zijn zorgplicht te voldoen?

| Aanpak | Aansprakelijkheidsargument |

|---|---|

| Gebruikt AI zonder verificatie | Onder de zorgvuldigheidsnorm — niet geverifieerd, blind vertrouwd |

| Gebruikt AI met verificatie | Boven de zorgvuldigheidsnorm — breder onderzoek, gedocumenteerde bronnen, auditspoor |

| Gebruikt helemaal geen AI | Vandaag: verdedigbaar. Morgen: steeds moeilijker te verantwoorden naarmate de norm verschuift |

Het transparantie-argument

Als beroepsaansprakelijkheid blijft bestaan ongeacht de tool, is de vraag niet óf u AI moet gebruiken — maar wélke AI u kunt vertrouwen.

Een ondoorzichtige AI-tool (generieke chatbot, geen bronnen) geeft de professional niets om te verifiëren en niets om te citeren. Als de output fout is, is er geen auditspoor, geen betrouwbaarheidssignaal en geen manier om zorgvuldigheid aan te tonen.

Een transparante AI-tool (bronverwijzingen, betrouwbaarheidsscores, temporele versionering, autoriteitshiërarchie) geeft de professional precies wat nodig is voor een verdedigbare workflow:

- Bronverwijzingen koppelen elk antwoord aan specifieke bepalingen, rechtspraak of commentaar — in seconden verifieerbaar

- Betrouwbaarheidsscores signaleren wanneer het systeem onzeker is — de professional weet waar extra te controleren

- Versiegeschiedenis toont welke versie van de wet werd toegepast — geen stille toepassing van verouderde bepalingen

- Auditsporen documenteren wat werd gezocht, wanneer, en wat werd gevonden — bewijs van zorgvuldigheid

De paradox: de AI-tool die onzekerheid toegeeft is veiliger dan die welke zelfverzekerd klinkt.

Praktisch kader: AI verdedigbaar gebruiken

Voor Belgische fiscale professionals die dit landschap navigeren, zes principes:

- Verifieer elke kritieke citatie. AI versnelt onderzoek; het vervangt verificatie niet. Controleer het artikelnummer, de versiedatum en of de geciteerde bron de bewering daadwerkelijk ondersteunt

- Documenteer uw proces. Registreer welke zoekopdrachten u uitvoerde, welke bronnen de tool retourneerde, en welke verificatiestappen u nam. Dit is uw bewijs van zorgvuldigheid

- Let op de betrouwbaarheidssignalen. Wanneer een tool onzekerheid signaleert, behandel dat als een aanleiding voor handmatig onderzoek — niet als reden om het antwoord te negeren

- Begrijp de beperkingen van de tool. Weet welk corpus het dekt, hoe frequent het bijwerkt, en welke contenttypes het uitsluit. Art. 4 van de AI Act vereist deze geletterdheid

- Behoud onafhankelijke competentie. De afhankelijkheidsprogressie is reëel. Doe periodiek onderzoek zonder AI om uw professionele vaardigheden scherp te houden

- Kies transparante tools. Een AI-tool zonder bronverwijzingen is een risico — geen troef. Als u de output niet kunt verifiëren, kunt u het advies niet verdedigen

Veelgestelde vragen

Verschuift het gebruik van AI de beroepsaansprakelijkheid naar de AI-aanbieder?

Nee. Onder het Belgisch aansprakelijkheidsrecht (Art. 6.5-6.6 BW) is de professional aansprakelijk voor zijn eigen fout — inclusief de fout van vertrouwen op niet-geverifieerde AI-output. De professional kan echter verhaal halen op de AI-aanbieder via contractuele aansprakelijkheid of de herziene Productaansprakelijkheidsrichtlijn, afhankelijk van de omstandigheden.

Vereist het Belgisch recht dat professionals AI-gebruik aan cliënten melden?

Niet expliciet — nog niet. Maar de algemene transparantieplicht en de deontologische eerlijkheidsplicht suggereren dat materieel vertrouwen op AI-tools gemeld moet worden, vooral wanneer de output van de AI het gegeven advies rechtstreeks vormgeeft. Het ITAA heeft hierover nog geen specifieke richtlijnen uitgebracht.

Dekt de verzekering AI-gerelateerde beroepsfouten?

Onduidelijk. Veel beroepsaansprakelijkheidsverzekeringen hebben “stille AI”-dekking — AI-risico’s noch expliciet opgenomen, noch uitgesloten. Sommige internationale verzekeraars hebben al AI-uitsluitingen ingevoerd. De collectieve ITAA-polis dekt nalatigheid breed, maar AI-specifieke claims zijn nog niet getest. Deze onzekerheid is op zichzelf een reden om verifieerbare AI-tools te gebruiken die het foutenrisico verminderen.

Gerelateerde artikelen

- Waarom transparantie belangrijker is dan nauwkeurigheid in juridische AI → /nl/blog/transparantie-vs-nauwkeurigheid/

- Wat is confidence scoring — en waarom het eerlijker is dan een zelfverzekerd antwoord → /nl/blog/confidence-scoring-uitgelegd/

- De EU AI Act en juridische AI: wat Belgische fiscale professionals echt moeten weten → /nl/blog/eu-ai-act-juridische-ai/

Hoe Auryth TX dit toepast

Auryth TX is ontworpen voor precies dit aansprakelijkheidslandschap. Elk antwoord bevat bronverwijzingen gekoppeld aan de specifieke bepalingen, rechtspraak of commentaar die het ondersteunen. Betrouwbaarheidsscores signaleren wanneer de opgehaalde bronnen het gegenereerde antwoord zwak ondersteunen — zodat de professional weet waar zorgvuldiger te verifiëren.

Het temporele versioneringssysteem volgt welke versie van elke bepaling werd toegepast, wanneer deze in werking trad, en of er sindsdien wijzigingen zijn gepubliceerd. Opgeslagen onderzoek wordt gemarkeerd wanneer onderliggende wetgeving wijzigt. De volledige zoekgeschiedenis biedt een auditspoor dat het onderzoeksproces van de professional documenteert.

Wij elimineren de aansprakelijkheid niet — het Belgisch recht staat dat niet toe, en dat zou het ook niet moeten. Wij geven professionals de transparantie die ze nodig hebben om aan te tonen dat ze hun werk zorgvuldig deden, hun bronnen verifieerden, en het professionele oordeel uitoefenden dat de wet vereist.

Bronnen: 1. Selbst, A.D. (2020). “Negligence and AI’s Human Users.” Boston University Law Review, 100, 1315-1376. 2. Buiten, M.C., de Streel, A. & Peitz, M. (2023). “The Law and Economics of AI Liability.” Computer Law & Security Review, 48. 3. Bertolini, A. & Episcopo, F. (2023). “The European AI Liability Directives — Critique of a Half-Hearted Approach and Lessons for the Future.” Computer Law & Security Review.