Hoe wij omgaan met tegenstrijdige bronnen — en waarom de meeste AI-tools dat niet doen

Wanneer Belgische fiscale bronnen elkaar tegenspreken, is het gevaarlijkste wat een AI-tool kan doen: er één kiezen en zelfverzekerd antwoorden.

Door Auryth Team

In oktober 2023 oordeelde het Hof van Cassatie dat buitenlands inkomen vrijgesteld is van Belgische belasting zodra het valt onder het toepassingsgebied van het buitenlandse belastingstelsel — ongeacht of het daadwerkelijk belast werd. Een jaar later, in oktober 2024, oordeelde hetzelfde Hof het omgekeerde: inkomen is slechts vrijgesteld als het effectief belast werd in het bronland.

Dezelfde doctrine. Hetzelfde Hof. Tegengestelde conclusies.

Het verschil? De verdragscontext — het ene arrest betrof het dubbelbelastingverdrag België-Nederland, het andere het verdrag België-Congo. Maar voor de fiscalist die advies voorbereidt, is de implicatie identiek: twee gezaghebbende bronnen wijzen in tegengestelde richtingen, en het antwoord hangt af van welke van toepassing is op de situatie van uw cliënt.

Stel u nu voor dat u deze vraag aan een AI-tool stelt. De meeste tools geven u één antwoord, vol zelfvertrouwen, met een citaat. Ze vertellen u niet dat het andere arrest bestaat, dat de doctrine betwist is, of dat het antwoord afhangt van verdragsspecifieke bewoordingen. Die omissie is gevaarlijker dan een fout antwoord — want een fout antwoord kan verificatie uitlokken. Een zelfverzekerd, onvolledig antwoord doet dat niet.

Het contradictielandschap in het Belgisch fiscaal recht

Tegenstrijdige bronnen zijn geen fouten in het Belgische rechtssysteem. Het zijn structurele kenmerken. Het systeem produceert ze betrouwbaar, om redenen die niets met fouten te maken hebben:

| Type tegenstrijdigheid | Voorbeeld | Waarom het gebeurt |

|---|---|---|

| Kamer vs. kamer | De Nederlandstalige en Franstalige kamers van het Hof van Cassatie kwamen tot tegengestelde conclusies over de vraag of de jaarlijkse taks op collectieve beleggingsinstellingen als vermogensbelasting kwalificeert (2022) | Het tweetalige Belgische rechtssysteem behandelt zaken apart |

| Circulaire vs. rechtspraak | De administratieve circulaire neemt een standpunt in; een rechterlijke uitspraak spreekt dit later tegen — maar de circulaire wordt nooit ingetrokken | Administratieve praktijk en rechterlijke interpretatie evolueren op verschillende tijdslijnen |

| Federaal vs. regionaal | De federale inkomstenbelastingbehandeling van een instrument conflicteert met de regionale schenk-/erfbelastingbehandeling van datzelfde instrument | Drie gewesten wetgeven onafhankelijk binnen hun bevoegdheden |

| Temporeel verval | Een bepaling die geldig was toen uw cliënt een structuur opzette, is sindsdien gewijzigd of herinterpreteerd | Programmawetten wijzigen tientallen bepalingen twee keer per jaar |

| Doctrine vs. rechtspraak | Academisch commentaar verdedigt standpunt A; recente rechtspraak vestigt standpunt B | Wetenschappelijke analyse en rechterlijke beslissingen dienen verschillende functies |

Een professional die vijftien jaar binnen het Belgisch fiscaal recht heeft gewerkt, kent deze tegenstrijdigheden. Die navigeert ze met ervaring, oordeelsvermogen en nauwkeurig leeswerk. De vraag is: wat gebeurt er wanneer u AI aan dit proces toevoegt?

Het overmoedsoprobleem

De meeste AI-tools zijn geoptimaliseerd voor zelfverzekerde antwoorden. Dat is een ontwerpkeuze, geen beperking van de technologie.

Grote taalmodellen zijn structureel te zelfverzekerd. Recent onderzoek naar LLM-kalibratie toont aan dat modelvertrouwen systematisch de correctheid overschat — wat onderzoekers “miscalibratie” noemen (Xiong et al., 2024). Wanneer een LLM 90% vertrouwen toekent aan een antwoord, ligt de werkelijke nauwkeurigheid vaak aanzienlijk lager. Dit is geen oplosbaar defect. Het is, zoals de Stanford RAG-hallucinatiestudie stelde, “een onvermijdelijk gevolg van probabilistische taalmodellering” (Magesh et al., 2024).

De gevolgen zijn zichtbaar. Een database die AI-hallucinaties in juridische processtukken bijhoudt, documenteerde meer dan 700 gevallen wereldwijd tegen eind 2025, waarvan 90% in 2025 alleen. Sancties tegen advocaten variëren van $2.000 tot $31.000 per incident — niet voor het gebruik van AI, maar voor het nalaten de output te verifiëren (Charlotin, 2025).

Het patroon is steeds hetzelfde: de tool gaf een zelfverzekerd antwoord, de professional vertrouwde erop, en de bron bleek verzonnen of niet van toepassing. Maar er is een subtieler faalpatroon dat zelden de pers haalt: de tool gaf een correct antwoord — maar verborg het feit dat even gezaghebbende bronnen het oneens zijn.

De gevaarlijkste AI-fout is niet het foute antwoord. Het is het juiste antwoord dat het bestaan van een tegensprekend antwoord verbergt.

De drie maximen — en wanneer ze falen

Rechtssystemen beschikken over eeuwenoude instrumenten voor het oplossen van normatieve conflicten:

- Lex superior — hogere normen gaan voor op lagere (grondwet boven wet, wet boven circulaire)

- Lex specialis — bijzondere bepalingen gaan voor op algemene

- Lex posterior — latere normen gaan voor op eerdere

Deze maximen lossen veel tegenstrijdigheden op. Wanneer een circulaire een wet tegenspreekt, beslist lex superior: de wet prevaleert. Wanneer een algemene regel en een specifieke uitzondering conflicteren, bepaalt lex specialis de uitkomst.

Maar de Belgische fiscale praktijk produceert regelmatig situaties waar de maximen het conflict niet eenduidig oplossen:

- Twee arresten van het Hof van Cassatie van gelijk gezag met tegengestelde conclusies (lex posterior zegt dat het latere prevaleert — maar was het een bewuste koerswijziging, of was de context anders?)

- Een circulaire die de administratie actief handhaaft ondanks strijdigheid met rechtspraak (lex superior zegt dat de rechtspraak prevaleert — maar volgt de belastinginspecteur het arrest of de circulaire?)

- Academische doctrine die een ambiguïteit identificeert die noch de wetgever noch de rechter heeft behandeld

In deze situaties bestaat er geen enkel juist antwoord. Er zijn standpunten, elk met verschillende niveaus van ondersteuning, risico en verdedigbaarheid. De taak van de professional is dit landschap te navigeren en de cliënt te adviseren welk standpunt in te nemen en waarom.

Een AI-tool die dit landschap platslaat tot één zelfverzekerd antwoord helpt niet. Het verwijdert precies de informatie die de professional het hardst nodig heeft.

Hoe eerlijke onzekerheid eruitziet

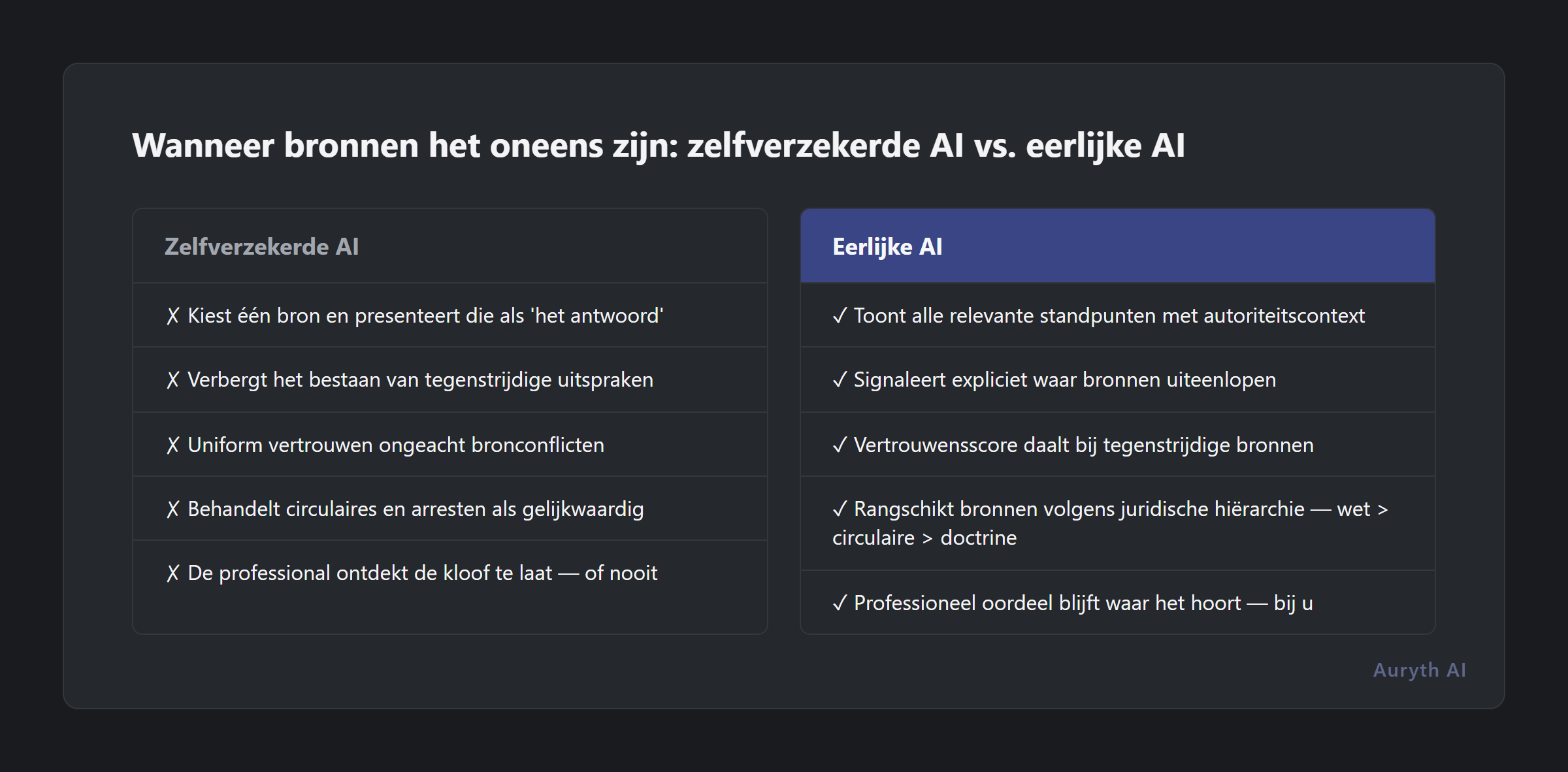

Het alternatief voor zelfverzekerde antwoorden is niet vage antwoorden. Het is gestructureerde onzekerheid — het volledige beeld presenteren met voldoende context voor de professional om een oordeel te vellen.

| Wat de meeste tools doen | Hoe eerlijke onzekerheid eruitziet |

|---|---|

| Eén standpunt presenteren als “het antwoord” | Alle relevante standpunten tonen met hun gezagsniveau |

| Eén bron citeren | Tonen waar bronnen overeenstemmen en waar ze divergeren |

| Uniform vertrouwen ongeacht bronkwaliteit | Betrouwbaarheidsscore die daalt wanneer bronnen tegenspreken |

| Geen indicatie van ambiguïteit | Expliciete vlag: “Bronnen over dit onderwerp komen tot verschillende conclusies” |

| Circulaires en arresten als gelijkwaardig behandelen | Rangschikken naar juridische hiërarchie — maar signaleren wanneer de administratie afwijkt van de rechterlijke interpretatie |

Dit is moeilijker te bouwen. Het vereist dat het systeem detecteert wanneer opgehaalde bronnen het oneens zijn, de aard van het meningsverschil classificeert, en de tegenstrijdigheid presenteert op een manier die de professional helpt in plaats van overweldigt.

Maar het is ook wat professionals daadwerkelijk nodig hebben. Een belastingadviseur die een rulingaanvraag voorbereidt voor de DVB (Dienst Voorafgaande Beslissingen) wil geen mening van een chatbot. Die wil weten: wat zegt de wet, wat zegt de administratie, wat zeggen de rechtbanken, en waar lopen deze drie uiteen?

Veelgestelde vragen

Kan AI echt tegenstrijdigheden tussen juridische bronnen detecteren?

Ja — op het niveau van retrieval. Wanneer een systeem meerdere bronnen ophaalt die tegengestelde claims maken over dezelfde juridische vraag, kunnen natural language inference (NLI)-modellen de tegenstrijdigheid identificeren. Het moeilijkere probleem is het classificeren van de tegenstrijdigheid: is het een echte ambiguïteit, een opgelost conflict (waar lex superior het beslist), of een schijntegenstelling veroorzaakt door verschillende feitelijke contexten? Huidige systemen kunnen tegenstrijdigheden betrouwbaar signaleren. Ze volledig classificeren vereist nog steeds professioneel oordeelsvermogen.

Is het niet beter om gewoon het meest gezaghebbende antwoord te geven?

Voor opgeloste conflicten wel — lex superior en lex specialis horen het antwoord te sturen. Maar voor werkelijk betwiste standpunten is het presenteren van alleen de “meest gezaghebbende” bron misleidend. Een arrest van het Hof van Cassatie uit 2023 vervangt niet automatisch een arrest uit 2024 als ze verschillende verdragscontexten betreffen. Authority ranking is noodzakelijk maar niet voldoende.

Hoe moet ik zelf omgaan met tegenstrijdige bronnen in mijn praktijk?

Documenteer alles. Wanneer bronnen het oneens zijn, noteer de tegenstrijdigheid expliciet in uw onderzoeksoutput. Identificeer welke oplossingsmaxime van toepassing is (indien van toepassing). Als het conflict echt is, presenteer de cliënt de concurrerende standpunten en uw aanbeveling — samen met het risicoprofiel van elk standpunt.

Gerelateerde artikelen

- Waarom transparantie belangrijker is dan nauwkeurigheid in juridische AI

- Wat is confidence scoring — en waarom het eerlijker is dan een zelfzeker antwoord

- Wat is authority ranking — en waarom uw juridische AI-tool het waarschijnlijk negeert

- Wat de Stanford-hallucinatiestudie werkelijk onthulde

Hoe Auryth TX dit toepast

Auryth TX behandelt brontegenstrijdigheden als informatie, niet als fouten. Wanneer de retrieval-laag bronnen ophaalt die tot verschillende conclusies komen over dezelfde juridische vraag, signaleert het systeem de tegenstrijdigheid expliciet in plaats van er stilzwijgend één te kiezen.

Elke opgehaalde bron draagt haar positie in de Belgische juridische hiërarchie — grondwet, wetgeving, koninklijk besluit, circulaire, rechtspraak, doctrine — zodat tegenstrijdigheden worden gepresenteerd met hun gezagscontext. Wanneer een circulaire een rechterlijke uitspraak tegenspreekt, toont het systeem beide standpunten en identificeert de hiërarchie. Wanneer twee arresten het oneens zijn, toont het systeem beide met hun datum, kamer en verdragscontext. De betrouwbaarheidsscore daalt wanneer bronnen tegenspreken, wat de professional een helder signaal geeft dat deze vraag diepere analyse vereist.

Het resultaat is geen zwakker antwoord. Het is een vollediger antwoord. De professional ziet het volledige contradictieoppervlak en past zijn oordeelsvermogen toe — wat precies is hoe serieus fiscaal advies altijd heeft gewerkt.

Wanneer bronnen het oneens zijn, moet uw AI-tool u dat vertellen. Niet voor u beslissen.

Bronnen: 1. Magesh, V. et al. (2024). “Hallucination-Free? Assessing the Reliability of Leading AI Legal Research Tools.” Journal of Empirical Legal Studies. 2. Xiong, M. et al. (2024). “Can LLMs Express Their Uncertainty? An Empirical Evaluation of Confidence Elicitation in LLMs.” ICLR 2024. 3. PwC Legal België (2025). “Confusion grows over ‘subject-to-tax’ rule for foreign-sourced income exemptions in Belgium.” PwC België. 4. Charlotin, D. (2025). “AI Hallucination Cases Database.” Onafhankelijk onderzoek.