Implémenter l'IA dans votre cabinet fiscal : pourquoi la confiance compte plus que la technologie

La plupart des implémentations d'IA échouent parce que les cabinets sautent la phase de construction de confiance. Un cadre pratique en 4 phases.

Par Auryth Team

Vous avez acheté l’outil. Vous avez fait la démo. Tout le monde était impressionné. Trois mois plus tard, deux personnes l’utilisent — et l’une d’elles est l’associé qui a signé le contrat.

Ce scénario se répète dans les cabinets de services professionnels du monde entier. Une étude de BCG sur l’adoption de l’IA en entreprise a révélé que la mise en œuvre réussie se décompose en trois composantes : 10 % d’algorithmes, 20 % d’infrastructure technologique et 70 % de transformation organisationnelle. Pourtant, la plupart des cabinets consacrent 90 % de leurs efforts aux deux premiers.

Dans les pratiques fiscales belges, l’écart est encore plus grand. Les fiscalistes portent une responsabilité professionnelle pour leurs conseils en vertu du code déontologique de l’ITAA. Quand vous leur demandez de faire confiance à un outil d’IA, vous ne leur demandez pas d’apprendre un nouveau logiciel — vous leur demandez de mettre leur réputation professionnelle en jeu. Pas étonnant que la démo seule ne change pas les comportements.

Le fossé de confiance dont personne ne parle

Les chiffres sont édifiants. La recherche montre systématiquement qu’environ 80 % des projets d’IA en entreprise n’atteignent pas leurs objectifs. L’enquête de PwC Belgium a révélé que seulement 21 % des entreprises belges ont dépassé le stade du pilote IA.

Mais voici le paradoxe : la Belgique figure parmi les trois premiers pays de l’UE pour l’utilisation de l’IA au travail selon Eurostat. Les professionnels belges ne sont pas technophobes — ils sont exigeants. Ils ont essayé ChatGPT pour des questions fiscales. Ils l’ont vu inventer des numéros d’articles. Ils savent à quoi ressemble une mauvaise IA.

Le problème n’est pas la résistance à la technologie. C’est la résistance à l’autorité non vérifiée.

Tech-first vs trust-first : deux approches, un seul gagnant

La plupart des guides d’implémentation se lisent comme des manuels produit : installer, configurer, former, déployer. C’est l’approche tech-first, et elle échoue parce qu’elle traite l’adoption comme un déploiement logiciel plutôt que comme un changement comportemental.

| Approche tech-first | Approche trust-first | |

|---|---|---|

| Semaine 1 | Formation complète de l’équipe, toutes les fonctionnalités | Une personne, un cas d’usage |

| Mois 1 | Tout le monde devrait l’utiliser | L’utilisateur pilote vérifie 20 réponses manuellement |

| Mois 3 | « Pourquoi personne ne l’utilise ? » | Le pilote partage les résultats vérifiés avec l’équipe |

| Mois 6 | Abonnement résilié | L’équipe construit une bibliothèque de requêtes partagée |

| Résultat | Shelfware | Outil intégré au flux de travail |

L’approche trust-first est plus lente. C’est aussi la seule qui fonctionne.

La règle des 20 réponses

Avant que quiconque dans votre cabinet ne se forme une opinion sur un outil d’IA, une personne doit vérifier 20 réponses manuellement. Pas 5 — c’est trop peu pour rencontrer les cas limites. Pas 50 — c’est trop pour maintenir la motivation. Vingt.

Voici ce que ces 20 réponses vous apprennent :

- Réponses 1–5 : Vous découvrez les forces de l’outil. Recherches simples, confirmations de taux, identification d’articles.

- Réponses 6–12 : Vous trouvez les premières limites. Une source manquante, une référence obsolète, une question mal traitée.

- Réponses 13–20 : Vous développez une confiance calibrée. Vous savez quand vous fier au résultat et quand vérifier. C’est une expertise qu’aucune démo ne peut fournir.

La confiance calibrée vaut plus que la certitude aveugle.

La personne qui complète ce processus devient le champion IA de votre cabinet — non pas parce qu’elle a été désignée, mais parce qu’elle a forgé sa propre conviction.

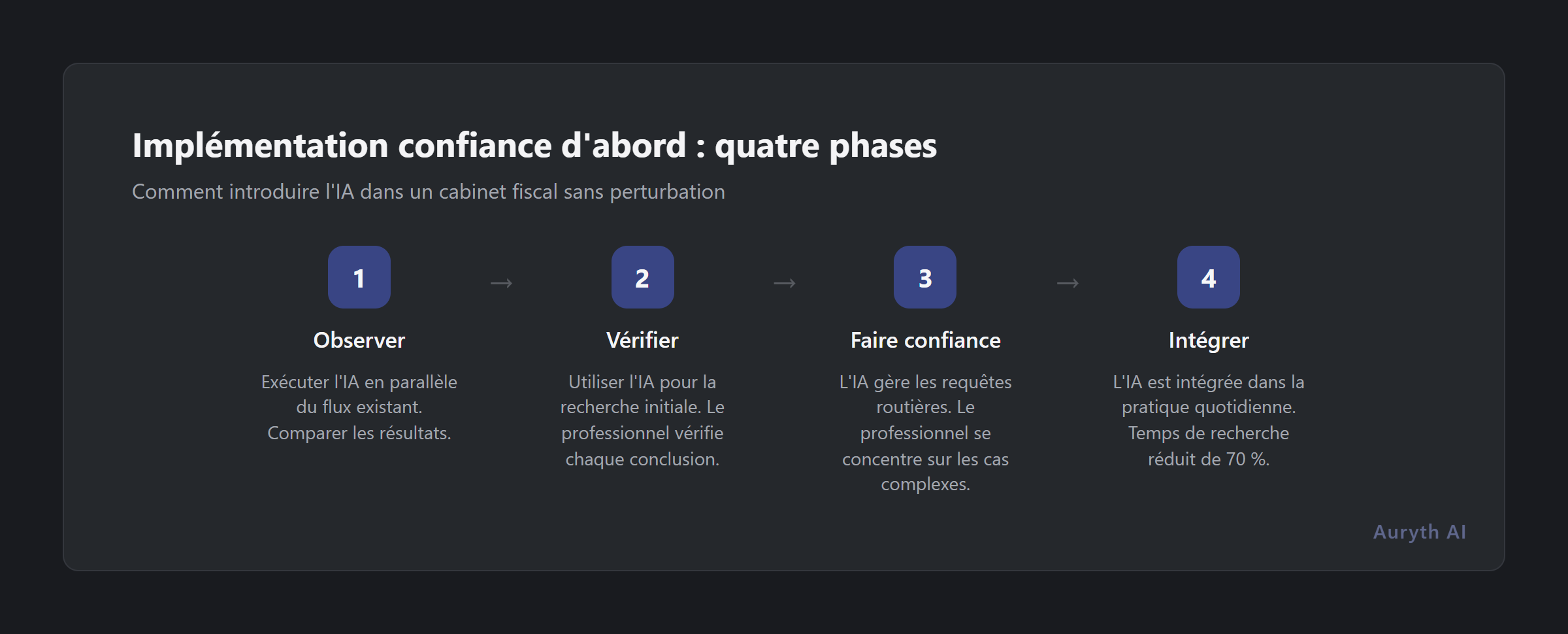

Un cadre d’implémentation en quatre phases

Phase 1 : Explorer (semaines 1–2). Une personne. Un cas d’usage. Choisissez le professionnel le plus curieux, pas le plus senior. Définissez un périmètre étroit — recherche de taux TOB, identification d’articles ou recherche de rulings. L’objectif n’est pas encore la productivité. C’est la familiarisation.

Phase 2 : Vérifier (semaines 3–6). La règle des 20 réponses. Votre utilisateur pilote effectue 20 requêtes réelles issues de dossiers clients en cours. Pour chaque réponse, il vérifie contre les sources primaires : Fisconetplus, Jura, le texte légal lui-même. Il documente ce qui était correct, incomplet ou erroné. Ce journal de vérification devient l’atout le plus précieux de votre implémentation.

Phase 3 : Élargir (mois 2–3). Partagez des preuves, pas de l’enthousiasme. L’utilisateur pilote présente son journal de vérification à l’équipe — non pas « cet outil est formidable » mais « voici 20 questions que j’ai testées, voici ce qu’il a bien fait, voici où il avait besoin de correction ». Les collègues font davantage confiance aux preuves de pairs qu’aux démos de fournisseurs. Élargissez à 2–3 utilisateurs et à des cas d’usage plus larges.

Phase 4 : Intégrer (mois 4–6). Construisez un savoir institutionnel. Créez une bibliothèque de requêtes partagée — des modèles pour les schémas de recherche récurrents. Documentez quels formats de questions donnent les meilleurs résultats et quels sujets nécessitent une vérification supplémentaire. Faites de l’outil une partie du flux de travail, pas une étape séparée.

Où ça dérape : trois tueurs d’implémentation

Le saut de la démo au déploiement. Passer d’une démo impressionnante directement au déploiement à l’échelle du cabinet. Sans la phase de construction de confiance, l’adoption s’effondre en quelques semaines. C’est le mode d’échec le plus courant — et le plus évitable.

La sur-confiance sans vérification. L’échec inverse : un utilisateur qui fait confiance trop vite, arrête de vérifier et finit par produire des conseils basés sur un résultat d’IA incorrect. Une seule mauvaise expérience empoisonne le puits pour toute l’équipe.

La sous-utilisation par méfiance. Un utilisateur forcé d’adopter l’outil, qui ne lui a jamais fait confiance et ne l’utilise que pour des recherches triviales qu’il pourrait faire plus vite manuellement. Le ROI ne se matérialise jamais car l’outil fonctionne à 10 % de sa capacité.

Les trois scénarios d’échec partagent la même cause : sauter la Phase 2.

Mesurer ce qui compte vraiment

Oubliez les métriques d’adoption de fonctionnalités. Dans un cabinet fiscal, trois chiffres vous disent si l’implémentation réussit :

| Métrique | Ce qu’elle mesure | Cible saine (mois 6) |

|---|---|---|

| Requêtes par professionnel par semaine | Profondeur d’utilisation réelle | 8–15 requêtes |

| Ratio de requêtes complexes | Maturité de la confiance | >40 % cross-domaine ou temporel |

| Gain de temps déclaré par dossier | Valeur perçue | 30–60 minutes |

Si les requêtes sont élevées mais la complexité faible, votre équipe utilise l’IA comme un moteur de recherche — pas comme un outil de recherche. Si la complexité est élevée mais les requêtes basses, la confiance grandit mais l’habitude n’est pas encore formée.

Questions fréquentes

Combien de temps prend une implémentation complète d’IA dans un cabinet fiscal ?

Comptez 4 à 6 mois du premier login au flux de travail intégré. Les deux premières semaines sont de l’exploration ; la vraie courbe d’adoption commence après la phase de vérification des 20 réponses. Les cabinets qui tentent de comprimer cela en 2 semaines rapportent systématiquement des taux d’adoption plus bas.

Faut-il commencer par les associés seniors ou le personnel junior ?

Ni l’un ni l’autre. Commencez par le professionnel le plus curieux, quel que soit son ancienneté. La curiosité prédit l’adoption mieux que l’autorité ou les compétences techniques. Le rôle du champion est de construire des preuves qui convainquent les autres — cela nécessite un intérêt sincère, pas un mandat.

Que faire si l’outil se trompe pendant la phase de vérification ?

C’est exactement le but. Trouver des erreurs pendant la vérification contrôlée est la meilleure chose qui puisse arriver. Cela enseigne la confiance calibrée et donne à l’utilisateur pilote une connaissance spécifique des limites de l’outil. Une erreur trouvée en Phase 2 construit plus de confiance que dix réponses correctes pendant une démo.

Articles connexes

- Comment évaluer un outil d’IA juridique : 10 questions qui comptent vraiment → /fr/blog/evaluation-outil-ia-juridique/

- « Je ne fais pas confiance à l’IA pour le conseil fiscal » — et vous avez raison → /fr/blog/resistance-ia-conseil-fiscal/

- Combien de temps l’IA fiscale fait-elle vraiment gagner ? Une estimation honnête → /fr/blog/gain-temps-ia-fiscale/

Comment Auryth TX applique ceci

Auryth TX est conçu pour une adoption trust-first. Chaque réponse affiche ses citations de sources — les articles, rulings et commentaires spécifiques qu’il a retrouvés. Les scores de confiance vous indiquent le degré de certitude du système, pour savoir quand vérifier davantage et quand faire confiance au résultat.

La plateforme soutient naturellement le processus de vérification des 20 réponses : chaque réponse inclut les sources primaires pour que vous puissiez les vérifier vous-même contre Fisconetplus ou le texte légal. Les fonctions d’export vous permettent de sauvegarder votre journal de vérification et de le partager avec vos collègues.

Commencez avec un essai gratuit de 14 jours. Vérifiez les 20 premières réponses vous-même. Puis décidez.

Sources : 1. Yang, Y. et al. (2024). « Artificial Intelligence in Auditing: A Framework and Assessment ». Auditing: A Journal of Practice & Theory. 2. Daly, S. et al. (2025). « Trust and AI Adoption in Organizations ». Technological Forecasting and Social Change. 3. Ibrahim, M. et al. (2025). « Technology Acceptance Model for AI in Professional Services ». Information Systems Frontiers.