L'AI Act européen et l'IA juridique : ce que les professionnels fiscaux belges doivent réellement savoir

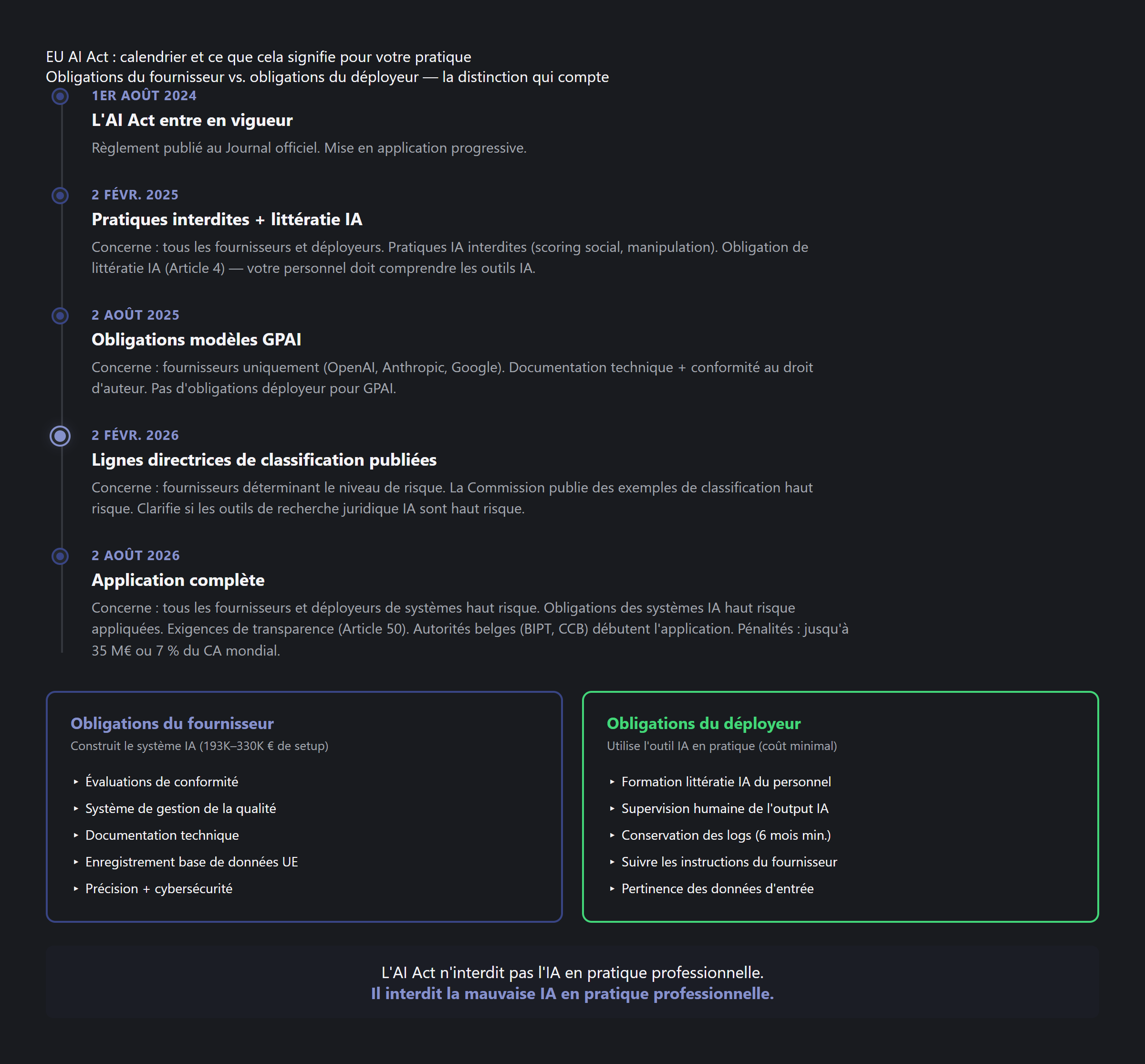

L'AI Act est entré en vigueur le 1er août 2024. Certaines dispositions sont déjà actives. La plupart des articles confondent les obligations des fournisseurs avec celles des déployeurs — voici la distinction qui compte pour votre pratique.

Par Auryth Team

L’AI Act européen est déjà en vigueur. Pas dans le futur — depuis le 1er août 2024. Les pratiques d’IA interdites sont bannies depuis février 2025. Les obligations de littératie en IA s’appliquent dès maintenant. Et en août 2026 — dans six mois — l’application des obligations pour les systèmes à haut risque commence, avec des sanctions pouvant atteindre 35 millions d’euros ou 7 % du chiffre d’affaires mondial.

Si vous êtes un professionnel fiscal belge utilisant des outils d’IA dans votre pratique, chaque article que vous avez lu sur ce règlement vous a probablement effrayé plus qu’il ne le devrait. Voici pourquoi : presque tout ce qui a été écrit sur l’AI Act confond ce que les fournisseurs doivent faire avec ce que les déployeurs doivent faire. La différence n’est pas académique. C’est la différence entre 330 000 € de coûts de conformité et essentiellement zéro.

La distinction qui change tout : fournisseur vs. déployeur

L’AI Act crée deux rôles fondamentalement différents avec des obligations fondamentalement différentes.

Les fournisseurs construisent des systèmes d’IA. OpenAI, Anthropic, Google, Auryth — quiconque développe, entraîne ou met un système d’IA sur le marché. Les fournisseurs de systèmes d’IA à haut risque doivent effectuer des évaluations de conformité, mettre en œuvre des systèmes de gestion de la qualité, maintenir une documentation technique extensive, enregistrer leurs systèmes dans la base de données européenne, et garantir l’exactitude, la robustesse et la cybersécurité.

Les déployeurs utilisent des systèmes d’IA dans un contexte professionnel. C’est vous. Cabinets d’avocats, cabinets comptables, cabinets de conseil fiscal, départements fiscaux d’entreprises — quiconque utilise un outil d’IA dans le cadre de son travail professionnel.

Vos obligations en tant que déployeur sont plus légères, plus pratiques et nettement moins coûteuses :

| Obligation | Ce que cela signifie en pratique |

|---|---|

| Littératie en IA (Article 4) | Assurez-vous que votre personnel comprend les bases du fonctionnement des outils d’IA qu’il utilise, leurs limites et leurs risques. Une formation interne suffit — aucune certification n’est requise |

| Surveillance humaine (Article 26) | Un professionnel qualifié examine les résultats de l’IA avant qu’ils n’atteignent les clients. Si vous le faites déjà — et vous devriez le faire — vous êtes déjà conforme |

| Conservation des journaux | Conservez les journaux générés par le système pendant au moins six mois |

| Pertinence des données d’entrée | Utilisez l’outil comme prévu, avec des données d’entrée appropriées |

| Suivre les instructions d’utilisation | Lisez et suivez la documentation du fournisseur |

C’est tout. Pas d’évaluation de conformité. Pas de système de gestion de la qualité. Pas de coût de mise en place de 193 000 € à 330 000 €. La charge de conformité pour les déployeurs est la formation, la surveillance et la tenue de registres — des activités que toute pratique professionnelle compétente devrait déjà effectuer.

Ce qui est déjà en vigueur

L’application de l’AI Act suit un calendrier progressif. Certaines dispositions sont déjà actives :

Depuis le 2 février 2025 :

- Les pratiques d’IA interdites sont bannies. Notation sociale, techniques subliminales manipulatrices, exploitation de vulnérabilités, identification biométrique à distance en temps réel dans les espaces publics (avec des exceptions limitées). Aucune de ces interdictions n’affecte les outils de recherche fiscale par IA.

- Les obligations de littératie en IA s’appliquent. L’Article 4 exige que les fournisseurs et les déployeurs garantissent un « niveau suffisant de littératie en IA » parmi le personnel qui exploite ou est affecté par les systèmes d’IA. Cela est en vigueur maintenant — pas en août 2026.

Depuis le 2 août 2025 :

- Les obligations relatives aux IA à usage général (GPAI) s’appliquent. Cela affecte les fournisseurs de modèles de fondation — OpenAI pour ChatGPT, Anthropic pour Claude, Google pour Gemini. Ils doivent maintenir une documentation technique, se conformer aux règles de droit d’auteur et publier des résumés des données d’entraînement. En tant que déployeur, vous n’avez aucune obligation spécifique aux GPAI. C’est la charge du fournisseur.

À venir le 2 août 2026 :

- Les obligations complètes pour les systèmes d’IA à haut risque entrent en vigueur. Les exigences de transparence de l’Article 50 s’appliquent. Les autorités nationales — en Belgique, le BIPT, le Centre pour la Cybersécurité Belgique et l’Inspection du travail — commencent l’application.

À venir le 2 février 2026 :

- La Commission européenne publie des lignes directrices de classification avec des exemples pratiques pour déterminer si un système d’IA est considéré comme à haut risque. Ces orientations arrivent six mois avant l’application, donnant au marché une dernière fenêtre pour s’adapter.

La question du haut risque : l’IA juridique est-elle qualifiée ?

C’est là que la discussion devient véritablement complexe — et où la plupart des commentaires simplifient à l’excès.

L’Annexe III de l’AI Act énumère les catégories de systèmes d’IA considérés comme à haut risque. Le point 8 couvre « l’administration de la justice et les processus démocratiques » et inclut spécifiquement les systèmes d’IA « destinés à aider une autorité judiciaire à rechercher et interpréter les faits et le droit et à appliquer le droit à un ensemble concret de faits. »

Lisez attentivement. Le texte dit autorité judiciaire — tribunaux, juges, cours. Pas les avocats. Pas les conseillers fiscaux. Pas les comptables.

Un outil d’IA de recherche fiscale utilisé par un conseiller professionnel pour rechercher des dispositions et préparer des conseils n’assiste pas une autorité judiciaire. Il assiste un professionnel dans son travail préparatoire. Cette distinction compte juridiquement, et c’est une distinction que les futures lignes directrices de classification de la Commission européenne (février 2026) devraient clarifier.

De plus, l’Article 6(3) prévoit une voie d’exemption explicite. Un système d’IA énuméré dans l’Annexe III n’est pas considéré comme à haut risque s’il :

- Effectue une « tâche procédurale étroite »

- Améliore le résultat d’une « activité humaine préalablement achevée »

- N’« influence pas matériellement » le résultat de la prise de décision

Un outil de recherche qui récupère et organise des dispositions juridiques pour qu’un professionnel les interprète et les applique correspond à cette description. Le jugement du professionnel — pas le résultat de l’IA — détermine le conseil. L’IA effectue un travail préparatoire ; l’humain prend la décision.

Une exception critique : les exemptions de l’Article 6(3) ne s’appliquent jamais si le système d’IA effectue un profilage de personnes physiques. Si un outil d’IA fiscale personnalise des recommandations basées sur les caractéristiques individuelles du client, il pourrait tomber dans la classification à haut risque indépendamment de la voie d’exemption. C’est la contrainte de conception la plus importante pour les fournisseurs d’IA juridique.

Ce que cela signifie spécifiquement pour la pratique belge

La mise en œuvre belge de l’AI Act reflète sa structure fédérale :

- Le BIPT (Institut belge des services postaux et des télécommunications) sert d’autorité de surveillance du marché et de point de contact unique

- Le Centre pour la Cybersécurité Belgique gère les aspects de cybersécurité

- L’Inspection du travail couvre l’IA dans les contextes de travail

- Le COC (Organe de contrôle de l’information policière) couvre l’IA en matière d’application de la loi

De manière cruciale, l’AI Act est un règlement d’harmonisation maximale. La Belgique ne peut pas introduire ses propres règles supplémentaires sur l’IA. Le cadre est uniforme dans toute l’UE — ce qui signifie que la conformité en Belgique équivaut à la conformité partout.

La position du barreau belge

L’OVB (ordre des barreaux flamands) et la NOvA (ordre des avocats néerlandais) ont publié des lignes directrices conjointes sur l’IA via alice.law qui adoptent une position permissive mais prudente :

- L’utilisation de l’IA n’est « ni interdite ni obligatoire » — elle relève de la « liberté et responsabilité » professionnelle de l’avocat

- Les avocats devraient pseudonymiser les données personnelles avant de les entrer dans des outils d’IA

- En règle générale, les données personnelles ne devraient pas être entrées dans les invites des outils d’IA

- Les avocats doivent lire et comprendre les conditions d’utilisation de l’outil d’IA : politiques de formation des données, emplacements de transfert et de stockage des données, si le système est ouvert ou fermé, dispositions de responsabilité et règles de propriété intellectuelle

- L’avocat reste entièrement responsable de tout résultat généré par l’IA utilisé dans le travail professionnel

Le CCBE (Conseil des barreaux européens) a renforcé cela avec son guide d’octobre 2025 sur l’utilisation de l’IA générative par les avocats, établissant un cadre paneuropéen qui met l’accent sur la responsabilité professionnelle plutôt que sur l’interdiction.

La position des comptables belges

Le baromètre ITAA 2025 révèle une profession qui s’oriente vers l’IA plutôt que de s’en éloigner :

- 71 % des comptables belges considèrent l’IA comme une opportunité pour des conseils personnalisés

- 80 % estiment qu’il est de leur devoir professionnel de guider les clients dans la transition numérique

- 59 % souhaitent investir dans des solutions de gestion sécurisée des données

Le président de l’ITAA, Bart Van Coile, a déclaré que les membres « ressentent la pression de réglementations de plus en plus complexes mais restent l’ancre de confiance » pour leurs clients. Ce cadrage — l’IA comme un outil qui renforce le rôle de conseiller de confiance, et non comme un outil qui le menace — s’aligne précisément avec la philosophie réglementaire de l’AI Act.

L’obligation de littératie en IA : ce qu’elle exige réellement

L’Article 4 est la disposition que la plupart des professionnels belges négligent, malgré son entrée en vigueur. Il exige que les fournisseurs et les déployeurs garantissent que le personnel dispose d’un « niveau suffisant de littératie en IA » en tenant compte de ses « connaissances techniques, expérience, éducation et formation » ainsi que du « contexte dans lequel les systèmes d’IA doivent être utilisés. »

En pratique, cela signifie :

- Votre personnel devrait comprendre comment fonctionnent les outils d’IA qu’il utilise au niveau conceptuel — pas l’architecture technique, mais l’approche générale (basée sur la récupération vs. générative, ce que signifie « notation de confiance », pourquoi les sources comptent)

- Votre personnel devrait comprendre les limites de l’outil — ce qu’il ne peut pas faire, où il fait des erreurs, quand vérifier de manière indépendante

- Votre personnel devrait comprendre le cadre de responsabilité professionnelle — l’IA produit un brouillon, le professionnel possède le conseil

- Documentation — les dossiers de formation interne suffisent. Aucune certification formelle n’est requise

Aucune amende autonome n’existe pour le non-respect de l’Article 4. Mais il fonctionne comme un « facteur aggravant majeur » dans toute enquête réglementaire. Si un problème survient et que l’enquête révèle l’absence de formation à la littératie en IA, toute autre sanction peut être augmentée.

L’application nationale de la littératie en IA commence en août 2026 via les autorités de surveillance du marché — en Belgique, cela signifie le BIPT.

L’intersection avec le RGPD

Pour les professionnels fiscaux belges, l’AI Act ne fonctionne pas de manière isolée. Tout outil d’IA traitant des données personnelles — noms de clients, informations financières, positions fiscales — doit se conformer simultanément à l’AI Act et au RGPD.

Points d’interaction clés :

- La minimisation des données s’applique aux deux cadres. L’exigence des orientations de l’OVB de pseudonymiser les données avant de les entrer dans des outils d’IA n’est pas seulement une bonne pratique professionnelle — elle est conforme au RGPD

- La prise de décision automatisée en vertu de l’Article 22 du RGPD et les règles de profilage de l’AI Act créent des obligations qui se chevauchent. Si votre outil d’IA prend ou influence matériellement des décisions concernant des individus, les deux cadres s’appliquent intégralement

- L’Omnibus numérique (novembre 2025) a introduit des amendements au RGPD reconnaissant la formation à l’IA comme un « intérêt légitime », résolvant partiellement l’une des tensions clés entre les deux cadres

Pour la pratique fiscale professionnelle : gardez les données personnelles hors des invites lorsque c’est possible, pseudonymisez lorsque ce n’est pas le cas, et assurez-vous que votre fournisseur d’IA dispose d’une conformité RGPD documentée pour son traitement des données. Ce sont des obligations de déployeur qui ne nécessitent aucune expertise juridique pour être mises en œuvre — juste de la sensibilisation et de la discipline.

Le cadre de sanctions

Les chiffres sont suffisamment importants pour mériter l’attention :

| Violation | Sanction maximale |

|---|---|

| Pratiques d’IA interdites | 35 millions d’euros ou 7 % du chiffre d’affaires mondial (selon le montant le plus élevé) |

| Obligations des systèmes à haut risque | 15 millions d’euros ou 3 % du chiffre d’affaires mondial |

| Informations trompeuses aux autorités | 7,5 millions d’euros ou 1 % du chiffre d’affaires mondial |

Pour les PME, le montant le plus faible s’applique. Pour les grandes organisations, le montant le plus élevé. Ce sont des sanctions maximales — l’application réelle sera probablement proportionnée et progressive, similaire au bilan du RGPD.

Le risque pratique pour les déployeurs (pratiques professionnelles utilisant des outils d’IA) est minime pour la simple raison que les obligations des déployeurs sont minimales. Formez votre personnel, maintenez la surveillance, conservez les journaux, suivez les instructions. Si vous faites ces quatre choses, le cadre de sanctions est effectivement sans pertinence pour votre pratique.

La vraie question de conformité

L’aperçu le plus important de l’AI Act n’est pas ce qu’il interdit. C’est ce qu’il légitime.

Lorsqu’un règlement établit des critères de conformité explicites pour les outils d’IA dans les contextes professionnels, il crée simultanément deux catégories : les outils qui répondent aux critères et ceux qui n’y répondent pas. Les chatbots à usage général utilisés pour la recherche fiscale — sans transparence des sources, sans pistes d’audit, sans précision documentée, sans conception de surveillance humaine — auront de plus en plus de mal à justifier leur utilisation dans la pratique professionnelle à mesure que le cadre réglementaire mûrit.

Les outils d’IA juridique spécialement conçus avec transparence, citation des sources, notation de confiance et architecture humain-dans-la-boucle ne sont pas seulement de meilleurs outils. Ce sont les outils conformes. L’AI Act n’interdit pas l’IA dans la pratique professionnelle — il interdit la mauvaise IA dans la pratique professionnelle.

L’OVB positionne déjà l’IA comme un outil de soutien légitime. L’ITAA voit déjà l’IA comme une opportunité. Le cadre réglementaire fournit désormais la structure de conformité qui transforme l’intérêt professionnel en pratique professionnelle.

Une liste de contrôle pratique de conformité pour les pratiques fiscales belges

Déjà requis (depuis février 2025) :

- Assurez-vous que le personnel comprend les outils d’IA qu’il utilise (littératie en IA, Article 4)

- Documentez la formation interne sur les capacités et limites de l’IA

Requis d’ici août 2026 :

- Mettez en œuvre des procédures de surveillance humaine pour les conseils assistés par IA

- Conservez les journaux du système d’IA pendant au moins six mois

- Assurez-vous que les outils d’IA utilisés sont déployés conformément aux instructions du fournisseur

- Examinez la documentation du fournisseur pour les revendications de conformité

Bonne pratique continue :

- Pseudonymisez les données des clients avant de les entrer dans les invites d’IA

- Vérifiez les résultats de l’IA avant de les livrer aux clients

- Conservez les enregistrements de recherche assistée par IA à des fins d’audit

- Surveillez les orientations de classification de la Commission européenne (février 2026)

Articles connexes

- « Je ne fais pas confiance à l’IA pour les conseils fiscaux » — et vous avez raison. Voici pourquoi vous devriez quand même essayer. →

- Comment évaluer un outil d’IA juridique : 10 questions qui comptent vraiment →

- Qu’est-ce que le scoring de confiance — et pourquoi c’est plus honnête qu’une réponse confiante →

Comment Auryth TX applique cela

Auryth TX est conçu pour la conformité à l’AI Act par architecture, et non par réflexion après coup.

Chaque requête de recherche produit une réponse entièrement sourcée avec des citations au niveau des articles, une notation de confiance et une piste d’audit complète. La conception humain-dans-la-boucle signifie que le professionnel prend toujours la décision interprétative finale — l’outil récupère, organise et signale ; le professionnel juge, conseille et prend la responsabilité.

La transparence des sources n’est pas une fonctionnalité — c’est la fondation. Chaque disposition citée renvoie à sa source. Chaque score de confiance reflète la qualité de récupération et la profondeur de couverture. Chaque session de recherche génère une trace documentée adaptée aux dossiers professionnels.

Pour l’obligation de littératie en IA : l’interface d’Auryth est conçue pour enseigner pendant qu’elle fonctionne. Les indicateurs de confiance, la provenance des sources, les cartes de couverture de domaine et les drapeaux de version temporelle rendent le raisonnement de l’outil visible — transformant chaque session de recherche en formation implicite à la littératie.

Aucune donnée personnelle n’entre dans le système par conception. Les requêtes portent sur des dispositions juridiques, pas sur des clients. L’architecture élimine l’intersection avec le RGPD avant qu’elle ne se produise.

À 99 €/mois, une infrastructure de conformité qui répond aux exigences de l’AI Act pour les déployeurs coûte moins qu’une seule heure de risque de non-conformité.

Recherchez plus rapidement. Couvrez davantage. Conseillez mieux — en conformité.

Sources : 1. European Parliament and Council (2024). Regulation (EU) 2024/1689 (AI Act). Official Journal of the European Union. 2. OVB (2025). « AI-richtlijnen voor advocaten. » ovb.be. Voir aussi : Alice.law (2025). “AI guidelines for lawyers in Belgium and the Netherlands.” 3. CCBE (2025). “Guide on the use of generative AI by lawyers.” ccbe.eu. 4. ITAA (2026). “ITAA-Barometer 2025.” blogitaa.be. 5. European Commission (2025). “General-Purpose AI Code of Practice.” digital-strategy.ec.europa.eu. 6. Ooms, W. & Gils, T. (2025). “Implementing the AI Act in Belgium: Scope of Application and Authorities.” SSRN. 7. ICT Rechtswijzer (2025). “The AI Act — Belgian implementation.” ictrechtswijzer.be.