IA et responsabilité professionnelle : que se passe-t-il quand la réponse est fausse ?

Quand la recherche fiscale assistée par IA mène à un mauvais conseil, le droit belge est clair : c'est le professionnel qui paie. Mais c'est précisément l'argument le plus fort en faveur d'une IA transparente.

Par Auryth Team

Un conseiller fiscal belge s’appuie sur un outil d’IA pour rechercher le taux applicable à la structure d’investissement d’un client. L’outil retrouve l’art. 19bis CIR 92 — article réel, code réel — mais sert la version d’avant la dernière loi-programme qui l’a modifié. Le conseiller donne un avis basé sur le taux obsolète. Le client agit en conséquence. L’avis d’imposition arrive. Le dommage est fait.

Qui paie ?

Le droit belge répond à cette question sans aucune ambiguïté. Le professionnel paie. À chaque fois. Quel que soit l’outil qui a produit l’erreur.

Le cadre de responsabilité qui existe déjà

La Belgique n’a pas besoin d’une nouvelle législation sur l’IA pour répondre à la question de la responsabilité. Le Livre 6 du Code civil belge — entré en vigueur le 1er janvier 2025 — fournit le cadre complet.

L’art. 6.5 dispose que toute personne est responsable du dommage causé par sa faute. L’art. 6.6 définit la faute comme soit la violation d’une règle légale spécifique, soit un manquement au devoir général de prudence (zorgvuldigheidsnorm). Aucune distinction entre une erreur commise manuellement et une erreur commise en faisant confiance à un outil.

La norme est celle du professionnel normalement prudent et compétent placé dans les mêmes circonstances. Un conseiller fiscal qui se fie aux résultats de l’IA sans vérification tombe en dessous de cette norme, tout comme celui qui se fierait à un code papier obsolète.

Un changement majeur dans le nouveau Livre 6 : l’art. 6.3 abolit l’ancienne interdiction de cumul (samenloopverbod). Un client lésé par un mauvais conseil fiscal peut désormais poursuivre à la fois sur le plan contractuel et délictuel contre le même conseiller. Cela élargit la surface d’exposition du conseiller.

L’épidémie d’erreurs d’IA que personne n’avait prévue

La question de la responsabilité n’est pas hypothétique. Dans le monde entier, 486 cas documentés d’erreurs d’hallucination d’IA ont été identifiés dans des procédures judiciaires — 324 dans les seuls tribunaux américains. Plus de 200 de ces cas se sont produits au cours des huit premiers mois de 2025 (Jones Walker, 2025).

L’affaire emblématique : Mata v. Avianca (SDNY, 2023). Des avocats ont soumis des conclusions contenant six références jurisprudentielles entièrement fabriquées par ChatGPT. Les affaires n’existaient pas. Les juges cités n’avaient jamais rédigé ces décisions. Résultat : 5 000 $ d’amende et une réputation professionnelle détruite.

Mais Mata v. Avianca n’était que le début. Mi-2025, trois tribunaux fédéraux américains distincts ont sanctionné des avocats pour des hallucinations générées par l’IA en l’espace de deux semaines. Les sanctions ont atteint 10 000 $ par incident.

Le développement le plus alarmant : en septembre 2025, des avocats ont été sanctionnés non pas pour avoir soumis des citations fabriquées par l’IA, mais pour ne pas avoir détecté que les citations de la partie adverse étaient fausses. Le devoir de vérification s’élargit.

Le piège de la dépendance

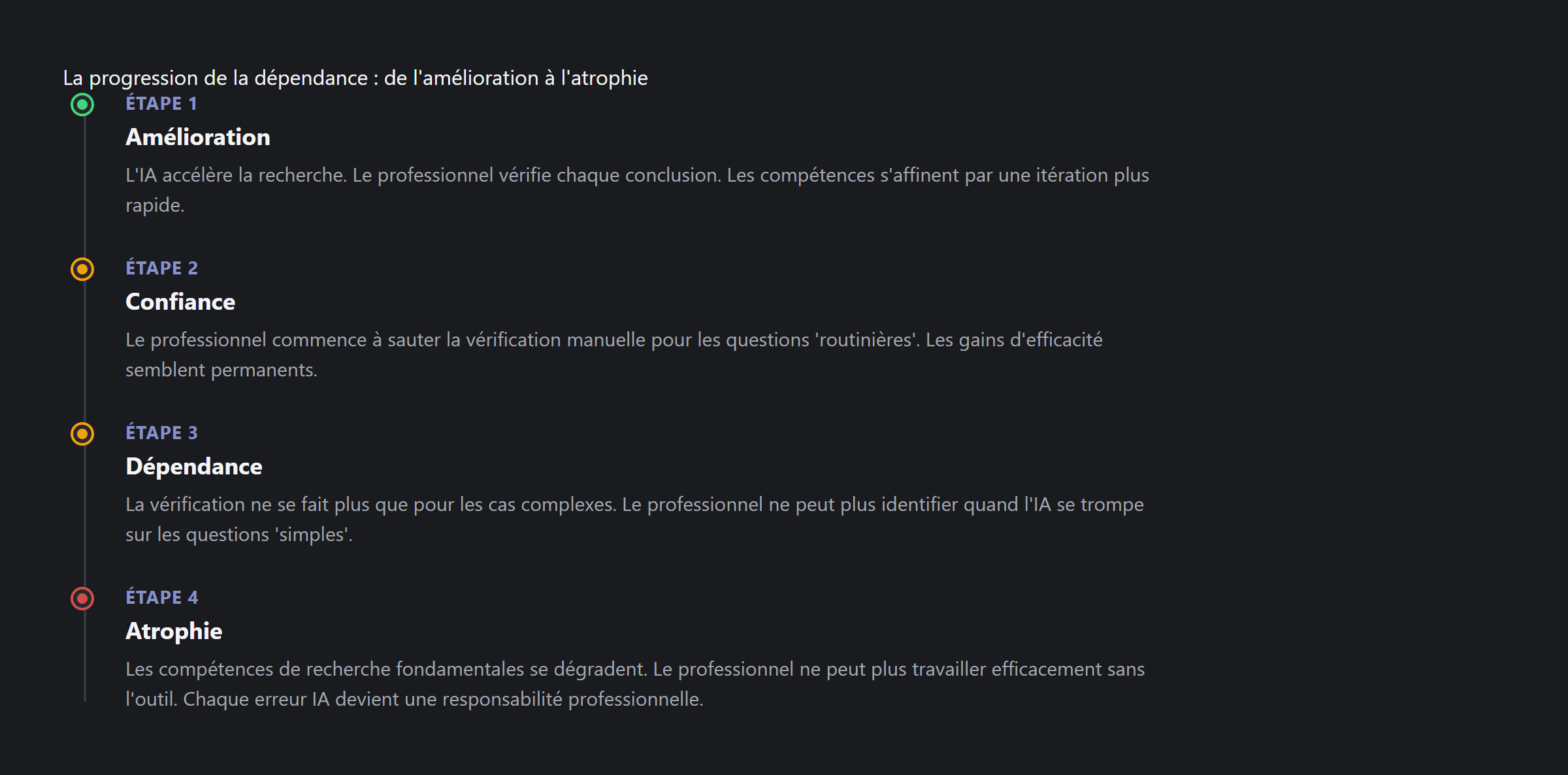

Ces affaires révèlent un schéma qui va au-delà de la négligence individuelle. Les chercheurs ont identifié une progression de la dépendance en quatre phases dans l’adoption de l’IA par les professionnels (Jones Walker, 2025) :

- Amélioration — l’IA assiste les tâches routinières ; le professionnel conserve une compréhension complète

- Intégration — l’IA gère un travail de plus en plus complexe à mesure que la confiance grandit

- Dépendance — le professionnel peine à travailler sans l’IA

- Atrophie — les capacités de pratique indépendante se détériorent

De nombreux travailleurs du savoir ont déjà atteint la phase 3. C’est là que le risque de responsabilité culmine : le professionnel fait suffisamment confiance à l’IA pour arrêter de vérifier, mais n’a pas encore perdu assez de compétences pour que quiconque le remarque — jusqu’à ce que quelque chose tourne mal.

La phase la plus dangereuse de l’adoption de l’IA est quand le professionnel fait assez confiance à l’outil pour arrêter de vérifier, mais pas assez pour comprendre quand il échoue.

Ce que l’UE exige — et ce qu’elle n’exige pas

Le règlement européen sur l’IA (Règlement 2024/1689) introduit des obligations de littératie en IA (art. 4, en vigueur depuis le 2 février 2025) et des obligations pour les utilisateurs de systèmes d’IA à haut risque (art. 26, conformité complète d’ici le 2 août 2027). Les professionnels utilisant l’IA pour la recherche fiscale pourraient être qualifiés de « déployeurs » — ce qui exigerait une surveillance humaine, un monitoring et une tenue de registres.

La directive révisée sur la responsabilité du fait des produits (en vigueur depuis le 8 décembre 2024, délai de transposition le 9 décembre 2026) couvre désormais explicitement les logiciels, y compris les systèmes d’IA. Si un outil d’IA produit un résultat défectueux — servir une loi obsolète, par exemple — le fabricant pourrait engager sa responsabilité stricte. Cela crée une voie de recours : le professionnel indemnise le client, puis se retourne contre le fournisseur d’IA.

Ce que l’UE n’a pas : une directive harmonisée sur la responsabilité en matière d’IA. La proposition de directive sur la responsabilité en matière d’IA a été retirée en octobre 2025 faute d’accord entre les parties prenantes. Cela signifie que les professionnels belges retombent entièrement sur le droit national de la responsabilité — art. 6.5 et 6.6 du Code civil.

L’argument contraire : NE PAS utiliser l’IA devient le risque

La plupart des professionnels considèrent l’IA comme un risque de responsabilité. La question plus intéressante est de savoir si le risque se déplace dans la direction opposée.

L’ABA Model Rule 1.1 (Commentaire 8, modifié 2012) exige des avocats qu’ils « se tiennent au courant des évolutions du droit et de sa pratique, y compris les avantages et risques liés aux technologies pertinentes ». L’avis formel 512 de l’ABA (juillet 2024) a étendu cela explicitement à l’IA générative : les avocats doivent avoir « une compréhension raisonnable des capacités et des limites » des outils d’IA.

Le schéma est familier. Quand les bases de données juridiques électroniques sont devenues disponibles — Jura, monKEY, Fisconetplus — aucun tribunal n’a déclaré la recherche exclusivement manuelle comme négligente. Mais la norme a évolué organiquement. Les tribunaux et les pairs en sont venus à considérer la recherche assistée par base de données comme une compétence de base. Aujourd’hui, un conseiller fiscal qui recherche une question transfrontalière complexe uniquement avec des codes papier serait considéré comme imprudent, pas comme rigoureux.

Les outils de recherche par IA suivent la même trajectoire. Si un outil détecte manifestement les modifications législatives plus rapidement que la veille manuelle, un professionnel qui l’ignore peut-il prétendre avoir satisfait à son devoir de prudence ?

| Approche | Argument de responsabilité |

|---|---|

| Utilise l’IA sans vérification | En dessous du devoir de prudence — pas vérifié, confiance aveugle |

| Utilise l’IA avec vérification | Au-dessus du devoir de prudence — recherche plus large, sources documentées, piste d’audit |

| N’utilise pas du tout l’IA | Aujourd’hui : défendable. Demain : de plus en plus difficile à justifier à mesure que la norme évolue |

L’argument de la transparence

Si la responsabilité professionnelle persiste quel que soit l’outil, la question n’est pas de savoir s’il faut utiliser l’IA — mais quelle IA mérite confiance.

Un outil d’IA opaque (chatbot générique, sans sources) ne donne au professionnel rien à vérifier et rien à citer. Si le résultat est faux, il n’y a ni piste d’audit, ni signal de confiance, ni moyen de démontrer la diligence.

Un outil d’IA transparent (citations de sources, scores de confiance, versionnage temporel, hiérarchie d’autorité) donne au professionnel exactement ce dont il a besoin pour un workflow défendable :

- Les citations de sources lient chaque réponse aux dispositions, décisions ou commentaires spécifiques — vérifiables en secondes

- Les scores de confiance signalent quand le système est incertain — le professionnel sait où approfondir

- L’historique des versions montre quelle version de la loi a été appliquée — pas d’application silencieuse de dispositions obsolètes

- Les pistes d’audit documentent ce qui a été recherché, quand et ce qui a été trouvé — preuve de diligence

Le paradoxe : l’outil d’IA qui admet l’incertitude est plus sûr que celui qui semble confiant.

Cadre pratique : utiliser l’IA de manière défendable

Pour les fiscalistes belges naviguant dans ce paysage, six principes :

- Vérifiez chaque citation critique. L’IA accélère la recherche ; elle ne remplace pas la vérification. Vérifiez le numéro d’article, la date de version et si la source citée soutient réellement l’affirmation

- Documentez votre processus. Enregistrez quelles requêtes vous avez effectuées, quelles sources l’outil a retournées et quelles étapes de vérification vous avez prises. C’est votre preuve de diligence

- Surveillez les signaux de confiance. Quand un outil signale une incertitude, traitez cela comme une invitation à la recherche manuelle — pas comme une raison d’ignorer la réponse

- Comprenez les limites de l’outil. Sachez quel corpus il couvre, à quelle fréquence il se met à jour et quels types de contenu il exclut. L’art. 4 du règlement IA exige cette littératie

- Maintenez une compétence indépendante. La progression de la dépendance est réelle. Effectuez périodiquement des recherches sans IA pour garder vos compétences professionnelles aiguisées

- Choisissez des outils transparents. Un outil d’IA sans citations de sources est un risque — pas un atout. Si vous ne pouvez pas vérifier le résultat, vous ne pouvez pas défendre le conseil

Questions fréquentes

L’utilisation de l’IA transfère-t-elle la responsabilité professionnelle au fournisseur d’IA ?

Non. En vertu du droit belge de la responsabilité (art. 6.5-6.6 CC), le professionnel est responsable de sa propre faute — y compris celle de se fier à des résultats d’IA non vérifiés. Cependant, le professionnel peut exercer un recours contre le fournisseur d’IA via la responsabilité contractuelle ou la directive révisée sur la responsabilité du fait des produits, selon les circonstances.

Le droit belge exige-t-il que les professionnels déclarent l’utilisation de l’IA à leurs clients ?

Pas explicitement — pas encore. Mais le devoir général de transparence et l’obligation déontologique d’honnêteté suggèrent qu’une dépendance matérielle aux outils d’IA devrait être déclarée, surtout quand les résultats de l’IA façonnent directement le conseil donné. L’ITAA n’a pas encore publié de directives spécifiques sur ce point.

L’assurance couvrira-t-elle les erreurs professionnelles liées à l’IA ?

Incertain. De nombreuses polices de responsabilité professionnelle ont une couverture « IA silencieuse » — les risques IA ni explicitement inclus, ni exclus. Certains assureurs internationaux ont déjà introduit des exclusions IA. La police collective de l’ITAA couvre la négligence de manière large, mais les sinistres spécifiques à l’IA n’ont pas été testés. Cette incertitude est en soi une raison d’utiliser des outils d’IA vérifiables qui réduisent le risque d’erreur.

Articles connexes

- Pourquoi la transparence compte plus que la précision en IA juridique → /fr/blog/transparence-vs-precision/

- Qu’est-ce que le scoring de confiance — et pourquoi c’est plus honnête qu’une réponse assurée → /fr/blog/scoring-confiance-explique/

- Le règlement européen sur l’IA et l’IA juridique : ce que les fiscalistes belges doivent vraiment savoir → /fr/blog/loi-ia-europeenne-ia-juridique/

Comment Auryth TX applique ceci

Auryth TX est conçu pour exactement ce paysage de responsabilité. Chaque réponse inclut des citations de sources liées aux dispositions, décisions ou commentaires spécifiques qui la soutiennent. Les scores de confiance signalent quand les sources retrouvées soutiennent faiblement la réponse générée — le professionnel sait ainsi où vérifier plus attentivement.

Le système de versionnage temporel suit quelle version de chaque disposition a été appliquée, quand elle est entrée en vigueur et si des amendements ont été publiés depuis. Les recherches sauvegardées sont signalées quand la loi sous-jacente change. L’historique complet des requêtes fournit une piste d’audit qui documente le processus de recherche du professionnel.

Nous n’éliminons pas la responsabilité — le droit belge ne le permet pas, et il ne le devrait pas. Nous donnons aux professionnels la transparence dont ils ont besoin pour démontrer qu’ils ont fait leur travail avec soin, vérifié leurs sources et exercé le jugement professionnel que la loi exige.

Sources : 1. Selbst, A.D. (2020). « Negligence and AI’s Human Users ». Boston University Law Review, 100, 1315-1376. 2. Buiten, M.C., de Streel, A. & Peitz, M. (2023). « The Law and Economics of AI Liability ». Computer Law & Security Review, 48. 3. Bertolini, A. & Episcopo, F. (2023). « The European AI Liability Directives — Critique of a Half-Hearted Approach and Lessons for the Future ». Computer Law & Security Review.