De EU AI Act en juridische AI: wat Belgische fiscalisten echt moeten weten

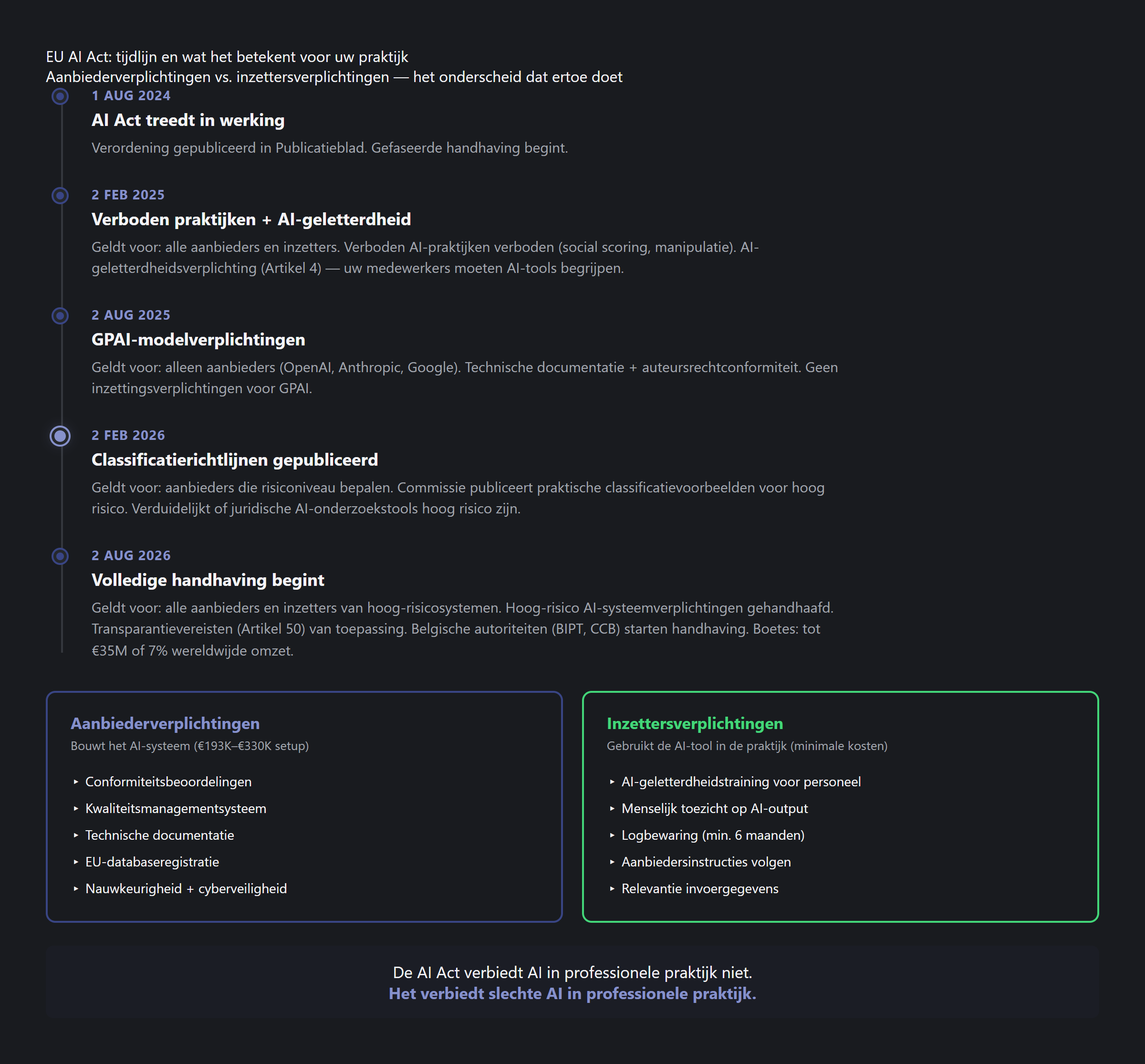

De AI Act is van kracht sinds 1 augustus 2024. Sommige bepalingen zijn nu al actief. De meeste artikelen verwarren verplichtingen voor aanbieders met verplichtingen voor gebruikers — hier is het onderscheid dat ertoe doet voor uw praktijk.

Door Auryth Team

De EU AI Act is al van kracht. Niet in de toekomst — sinds 1 augustus 2024. Verboden AI-praktijken zijn sinds februari 2025 verboden. AI-geletterdheidverplichtingen gelden nu. En in augustus 2026 — over zes maanden — beginnen handhavingsmaatregelen voor hoogrisicoregelsystemen, met boetes tot €35 miljoen of 7% van de wereldwijde omzet.

Als u een Belgische fiscalist bent die AI-tools gebruikt in uw praktijk, heeft elk artikel dat u over deze regelgeving heeft gelezen u waarschijnlijk meer bang gemaakt dan nodig was. Dit is waarom: bijna alles wat over de AI Act is geschreven, verwart wat aanbieders moeten doen met wat gebruikers moeten doen. Het verschil is niet academisch. Het is het verschil tussen €330.000 aan nalevingskosten en in wezen nul.

Het onderscheid dat alles verandert: aanbieder vs. gebruiker

De AI Act creëert twee fundamenteel verschillende rollen met fundamenteel verschillende verplichtingen.

Aanbieders bouwen AI-systemen. OpenAI, Anthropic, Google, Auryth — iedereen die een AI-systeem ontwikkelt, traint of op de markt brengt. Aanbieders van hoogrisico-AI-systemen moeten conformiteitsbeoordelingen uitvoeren, kwaliteitsmanagementsystemen implementeren, uitgebreide technische documentatie bijhouden, hun systemen registreren in de EU-database, en nauwkeurigheid, robuustheid en cyberbeveiliging waarborgen.

Gebruikers gebruiken AI-systemen in een professionele context. Dat bent u. Advocatenkantoren, boekhoudkantoren, fiscale adviespraktijken, bedrijfsbelastingafdelingen — iedereen die een AI-tool gebruikt als onderdeel van hun professionele werk.

Uw verplichtingen als gebruiker zijn lichter, praktischer en aanzienlijk minder duur:

| Verplichting | Wat het betekent in de praktijk |

|---|---|

| AI-geletterdheid (Artikel 4) | Zorg ervoor dat uw personeel de basis begrijpt van hoe de AI-tools die zij gebruiken werken, hun beperkingen en hun risico’s. Interne training volstaat — geen certificering vereist |

| Menselijk toezicht (Artikel 26) | Een gekwalificeerde professional beoordeelt AI-output voordat deze cliënten bereikt. Als u dit al doet — en dat zou u moeten doen — bent u al compliant |

| Logbewaring | Bewaar door het systeem gegenereerde logs gedurende minimaal zes maanden |

| Relevantie van invoergegevens | Gebruik de tool zoals bedoeld, met geschikte invoergegevens |

| Volg gebruiksinstructies | Lees en volg de documentatie van de aanbieder |

Dat is alles. Geen conformiteitsbeoordeling. Geen kwaliteitsmanagementsysteem. Geen opzetkosten van €193.000–€330.000. De nalevingslast voor gebruikers is training, toezicht en administratie — activiteiten die elke bekwame professionele praktijk al zou moeten uitvoeren.

Wat is al van kracht

De handhaving van de AI Act volgt een gefaseerde tijdlijn. Sommige bepalingen zijn al actief:

Sinds 2 februari 2025:

- Verboden AI-praktijken zijn verboden. Sociale scoring, manipulatieve subliminale technieken, uitbuiting van kwetsbaarheden, realtime biometrische identificatie op afstand in openbare ruimtes (met beperkte uitzonderingen). Geen van deze treffen AI-tools voor fiscaal onderzoek.

- AI-geletterdheidverplichtingen zijn van toepassing. Artikel 4 vereist dat zowel aanbieders als gebruikers zorgen voor een “toereikend niveau van AI-geletterdheid” onder personeel dat AI-systemen bedient of erdoor wordt beïnvloed. Dit is nu al van kracht — niet augustus 2026.

Sinds 2 augustus 2025:

- GPAI-modelverplichtingen (algemene AI) zijn van toepassing. Dit treft aanbieders van fundamentele modellen — OpenAI voor ChatGPT, Anthropic voor Claude, Google voor Gemini. Zij moeten technische documentatie bijhouden, voldoen aan auteursrechtregels en trainingsgegevenssamenvattingen publiceren. Als gebruiker heeft u geen GPAI-specifieke verplichtingen. Dit is de last van de aanbieder.

Komend augustus 2026:

- Volledige hoogrisicoregelsysteemverplichtingen treden in werking. Transparantievereisten onder Artikel 50 zijn van toepassing. Nationale autoriteiten — in België de BIPT, het Centrum voor Cybersecurity België en de Arbeidsinspectie — beginnen met handhaving.

Komend februari 2026:

- De Europese Commissie publiceert classificatierichtlijnen met praktische voorbeelden voor het bepalen of een AI-systeem kwalificeert als hoog risico. Deze begeleiding komt zes maanden vóór handhaving, waardoor de markt een laatste window krijgt om zich aan te passen.

De hoogrisicocategorie: kwalificeert juridische AI?

Dit is waar de discussie echt complex wordt — en waar de meeste commentaren te veel vereenvoudigen.

Bijlage III van de AI Act somt categorieën op van AI-systemen die als hoog risico worden beschouwd. Punt 8 heeft betrekking op de “rechtsbedeling en democratische processen” en omvat specifiek AI-systemen “die bedoeld zijn om een rechterlijke autoriteit te ondersteunen bij het onderzoeken en interpreteren van feiten en het recht en bij het toepassen van het recht op een concrete reeks feiten.”

Lees dat zorgvuldig. De tekst zegt rechterlijke autoriteit — rechtbanken, rechters, tribunalen. Niet advocaten. Niet fiscale adviseurs. Niet accountants.

Een fiscaal onderzoek-AI-tool die door een professionele adviseur wordt gebruikt om bepalingen te onderzoeken en advies voor te bereiden, ondersteunt geen rechterlijke autoriteit. Het ondersteunt een professional bij hun voorbereidend werk. Dit onderscheid is juridisch belangrijk, en het is een onderscheid dat de aankomende classificatierichtlijnen van de Europese Commissie (februari 2026) naar verwachting zullen verduidelijken.

Bovendien biedt Artikel 6(3) een expliciete vrijstellingsroute. Een AI-systeem vermeld in Bijlage III wordt niet beschouwd als hoog risico als het:

- Een “beperkte procedurele taak” uitvoert

- Het resultaat verbetert van een “eerder voltooide menselijke activiteit”

- Geen “materiële invloed” heeft op de uitkomst van besluitvorming

Een onderzoekstool die wettelijke bepalingen ophaalt en organiseert voor een professional om te interpreteren en toe te passen, past bij deze beschrijving. Het professionele oordeel — niet de AI-output — bepaalt het advies. De AI voert voorbereidend werk uit; de mens neemt de beslissing.

Eén cruciale uitzondering: Artikel 6(3) vrijstellingen zijn nooit van toepassing als het AI-systeem profilering van natuurlijke personen uitvoert. Als een fiscale AI-tool aanbevelingen personaliseert op basis van individuele cliëntkenmerken, kan het in de hoogrisicocategorie vallen, ongeacht de vrijstellingsroute. Dit is de belangrijkste ontwerpbeperking voor aanbieders van juridische AI.

Wat dit specifiek betekent voor de Belgische praktijk

Belgies implementatie van de AI Act weerspiegelt zijn federale structuur:

- BIPT (Belgisch Instituut voor postdiensten en telecommunicatie) fungeert als markttoezichtautoriteit en enig contactpunt

- Centrum voor Cybersecurity België behandelt cybersecurityaspecten

- Arbeidsinspectie behandelt AI in werkplekcontexten

- COC (Controleorgaan op de Politionele Informatie) behandelt AI voor wetshandhaving

Cruciaal is dat de AI Act een maximum harmonisatie verordening is. België kan geen eigen aanvullende AI-regels introduceren. Het kader is uniform over de EU — wat betekent dat naleving in België gelijk staat aan naleving overal.

De positie van de Belgische balie

De OVB (Orde van Vlaamse Balies) en NOvA (Nederlandse Orde van Advocaten) publiceerden gezamenlijke AI-richtlijnen via alice.law die een permissief maar voorzichtig standpunt innemen:

- AI-gebruik is “noch verboden noch verplicht” — het valt binnen de “vrijheid en verantwoordelijkheid” van de advocaat

- Advocaten moeten persoonsgegevens pseudonimiseren voordat ze deze in AI-tools invoeren

- Als regel mogen persoonsgegevens niet worden ingevoerd in AI-toolprompts

- Advocaten moeten de gebruiksvoorwaarden van de AI-tool lezen en begrijpen: trainingsbeleid voor gegevens, locaties voor gegevensoverdracht en -opslag, of het systeem open of gesloten is, aansprakelijkheidsbepalingen en IP-regels

- De advocaat blijft volledig verantwoordelijk voor alle door AI gegenereerde output die in professioneel werk wordt gebruikt

De CCBE (Council of Bars and Law Societies of Europe) versterkte dit met zijn gids van oktober 2025 over het gebruik van generatieve AI door advocaten, waarbij een pan-Europees kader werd opgesteld dat professionele verantwoordelijkheid benadrukt boven verbod.

De positie van de Belgische accountant

De ITAA-Barometer 2025 onthult een beroepsgroep die zich naar AI beweegt in plaats van ervan weg:

- 71% van de Belgische accountants beschouwt AI als een kans voor gepersonaliseerd advies

- 80% gelooft dat het hun professionele plicht is om cliënten te begeleiden door digitale transitie

- 59% wil investeren in veilige gegevensbeheeroplossingen

ITAA-voorzitter Bart Van Coile stelde dat leden “de druk van steeds complexere regelgeving voelen maar het anker van vertrouwen blijven” voor hun cliënten. Deze framing — AI als een tool die de vertrouwde adviseurrol versterkt, niet bedreigt — sluit precies aan bij de regelgevingsfilosofie van de AI Act.

De AI-geletterdheidverplichting: wat het werkelijk vereist

Artikel 4 is de bepaling die de meeste Belgische professionals over het hoofd zien, ondanks dat het al van kracht is. Het vereist dat aanbieders en gebruikers zorgen dat personeel een “toereikend niveau van AI-geletterdheid” heeft, rekening houdend met hun “technische kennis, ervaring, opleiding en training” evenals de “context waarin de AI-systemen zullen worden gebruikt.”

In de praktijk betekent dit:

- Uw personeel moet begrijpen hoe de AI-tools die zij gebruiken op conceptueel niveau werken — niet de technische architectuur, maar de algemene aanpak (op ophaling gebaseerd vs. generatief, wat “betrouwbaarheidsscore” betekent, waarom bronnen ertoe doen)

- Uw personeel moet begrijpen wat de beperkingen van de tool zijn — wat het niet kan, waar het fouten maakt, wanneer onafhankelijk moet worden geverifieerd

- Uw personeel moet begrijpen het professionele verantwoordelijkheidskader — de AI produceert een concept, de professional bezit het advies

- Documentatie — interne trainingsregistraties volstaan. Geen formele certificering vereist

Er bestaat geen zelfstandige boete voor het niet naleven van Artikel 4. Maar het fungeert als een “grote verzwarende factor” in elk regelgevend onderzoek. Als er een probleem ontstaat en het onderzoek onthult geen AI-geletterdheidstraining, kan elke andere boete worden verhoogd.

Nationale handhaving van AI-geletterdheid begint in augustus 2026 via markttoezichtautoriteiten — in België betekent dat BIPT.

De GDPR-kruising

Voor Belgische fiscalisten werkt de AI Act niet in isolatie. Elke AI-tool die persoonsgegevens verwerkt — cliëntnamen, financiële informatie, fiscale posities — moet tegelijkertijd voldoen aan zowel de AI Act als de GDPR.

Belangrijke interactiepunten:

- Gegevensminimalisatie is van toepassing op beide kaders. De OVB-begeleiding die vereist dat gegevens worden gepseudonomiseerd voordat ze in AI-tools worden ingevoerd, is niet alleen professionele best practice — het is GDPR-conform

- Geautomatiseerde besluitvorming onder GDPR Artikel 22 en de profileringsregels van de AI Act creëren overlappende verplichtingen. Als uw AI-tool beslissingen neemt over of materieel beïnvloedt die over individuen gaan, zijn beide kaders volledig van toepassing

- De Digital Omnibus (november 2025) introduceerde GDPR-amendementen die AI-training erkenden als een “gerechtvaardigd belang,” waarmee een van de belangrijkste spanningen tussen de twee kaders gedeeltelijk werd opgelost

Voor professionele fiscale praktijk: houd persoonsgegevens waar mogelijk uit prompts, pseudonimiseer waar dit niet mogelijk is, en zorg ervoor dat uw AI-aanbieder gedocumenteerde GDPR-naleving heeft voor hun gegevensverwerking. Dit zijn gebruikersverplichtingen die geen juridische expertise vereisen om te implementeren — alleen bewustzijn en discipline.

Het boetekader

De cijfers zijn groot genoeg om aandacht te verdienen:

| Overtreding | Maximale boete |

|---|---|

| Verboden AI-praktijken | €35 miljoen of 7% van de wereldwijde omzet (welke van beide hoger is) |

| Hoogrisicoregelsysteemverplichtingen | €15 miljoen of 3% van de wereldwijde omzet |

| Misleidende informatie aan autoriteiten | €7,5 miljoen of 1% van de wereldwijde omzet |

Voor kmo’s is het lagere van de twee bedragen van toepassing. Voor grotere organisaties het hogere bedrag. Dit zijn maximale boetes — de feitelijke handhaving zal waarschijnlijk proportioneel en gradueel zijn, vergelijkbaar met het trackrecord van de GDPR.

Het praktische risico voor gebruikers (professionele praktijken die AI-tools gebruiken) is minimaal om de simpele reden dat gebruikersverplichtingen minimaal zijn. Train uw personeel, handhaaf toezicht, houd logs bij, volg instructies. Als u deze vier dingen doet, is het boetekader effectief irrelevant voor uw praktijk.

De echte nalevingsvraag

Het belangrijkste inzicht uit de AI Act is niet wat het verbiedt. Het is wat het legitimeert.

Wanneer een verordening expliciete nalevingscriteria vaststelt voor AI-tools in professionele contexten, creëert het tegelijkertijd twee categorieën: tools die aan de criteria voldoen en tools die dat niet doen. Algemene chatbots die voor fiscaal onderzoek worden gebruikt — zonder brontransparantie, zonder audittrails, zonder gedocumenteerde nauwkeurigheid, zonder ontwerp voor menselijk toezicht — zullen het steeds moeilijker vinden om hun gebruik in professionele praktijk te rechtvaardigen naarmate het regelgevingskader rijpt.

Speciaal gebouwde juridische AI-tools ontworpen met transparantie, broncitatie, betrouwbaarheidsscore en menselijk-in-de-lus architectuur zijn niet alleen betere tools. Het zijn de conforme tools. De AI Act verbiedt geen AI in professionele praktijk — het verbiedt slechte AI in professionele praktijk.

De OVB positioneert AI al als een legitieme ondersteunende tool. De ITAA ziet AI al als een kans. Het regelgevingskader biedt nu de nalevingsstructuur die professionele interesse omzet in professionele praktijk.

Een praktische nalevingschecklist voor Belgische fiscale praktijken

Al vereist (sinds februari 2025):

- Zorg ervoor dat personeel de AI-tools begrijpt die zij gebruiken (AI-geletterdheid, Artikel 4)

- Documenteer interne training over AI-capaciteiten en -beperkingen

Vereist tegen augustus 2026:

- Implementeer procedures voor menselijk toezicht op AI-ondersteund advies

- Onderhoud AI-systeemlogs gedurende minimaal zes maanden

- Zorg ervoor dat gebruikte AI-tools worden ingezet volgens aanbiedersinstructies

- Bekijk aanbiederdocumentatie voor nalevingsclaims

Doorlopende best practice:

- Pseudonimiseer cliëntgegevens voordat u deze in AI-prompts invoert

- Verifieer AI-output voordat u deze aan cliënten levert

- Houd records bij van AI-ondersteund onderzoek voor auditdoeleinden

- Monitor de classificatiebegeleiding van de Europese Commissie (februari 2026)

Gerelateerde artikelen

- “Ik vertrouw AI niet voor fiscaal advies” — en u hebt gelijk. Hier is waarom u het toch moet proberen. →

- Hoe een juridische AI-tool evalueren: 10 vragen die echt tellen →

- Wat is confidence scoring — en waarom het eerlijker is dan een zelfverzekerd antwoord →

Hoe Auryth TX dit toepast

Auryth TX is ontworpen voor AI Act-naleving door architectuur, niet door nagedachte.

Elke onderzoeksvraag produceert een volledig onderbouwde respons met citaties op artikelniveau, betrouwbaarheidsscore en een complete audittrail. Het menselijk-in-de-lus ontwerp betekent dat de professional altijd de definitieve interpretatieve beslissing neemt — de tool haalt op, organiseert en markeert; de professional oordeelt, adviseert en neemt verantwoordelijkheid.

Brontransparantie is geen functie — het is de basis. Elke geciteerde bepaling linkt naar zijn bron. Elke betrouwbaarheidsscore weerspiegelt de ophaalkwaliteit en dekkingsdiepte. Elke onderzoekssessie genereert een gedocumenteerde trail geschikt voor professionele registraties.

Voor de AI-geletterdheidverplichting: de interface van Auryth is ontworpen om te onderwijzen terwijl het werkt. Betrouwbaarheidsindicatoren, bronherkomst, domeindekkingskaarten en tijdelijke versievlaggen maken de redenering van de tool zichtbaar — waardoor elke onderzoekssessie impliciete geletterdheidstraining wordt.

Er komen standaard geen persoonsgegevens in het systeem. Vragen gaan over wettelijke bepalingen, niet over cliënten. De architectuur elimineert de GDPR-kruising voordat deze zich voordoet.

Voor €99/maand kost nalevingsinfrastructuur die voldoet aan de gebruikersvereisten van de AI Act minder dan een enkel uur risico op niet-naleving.

Onderzoek sneller. Dek meer af. Adviseer beter — conform.

Bronnen: 1. European Parliament and Council (2024). Regulation (EU) 2024/1689 (AI Act). Official Journal of the European Union. 2. OVB (2025). “AI-richtlijnen voor advocaten.” ovb.be. Zie ook: Alice.law (2025). “AI guidelines for lawyers in Belgium and the Netherlands.” 3. CCBE (2025). “Guide on the use of generative AI by lawyers.” ccbe.eu. 4. ITAA (2026). “ITAA-Barometer 2025.” blogitaa.be. 5. European Commission (2025). “General-Purpose AI Code of Practice.” digital-strategy.ec.europa.eu. 6. Ooms, W. & Gils, T. (2025). “Implementing the AI Act in Belgium: Scope of Application and Authorities.” SSRN. 7. ICT Rechtswijzer (2025). “The AI Act — Belgian implementation.” ictrechtswijzer.be.