De volgende grenzen in AI voorbij schaling

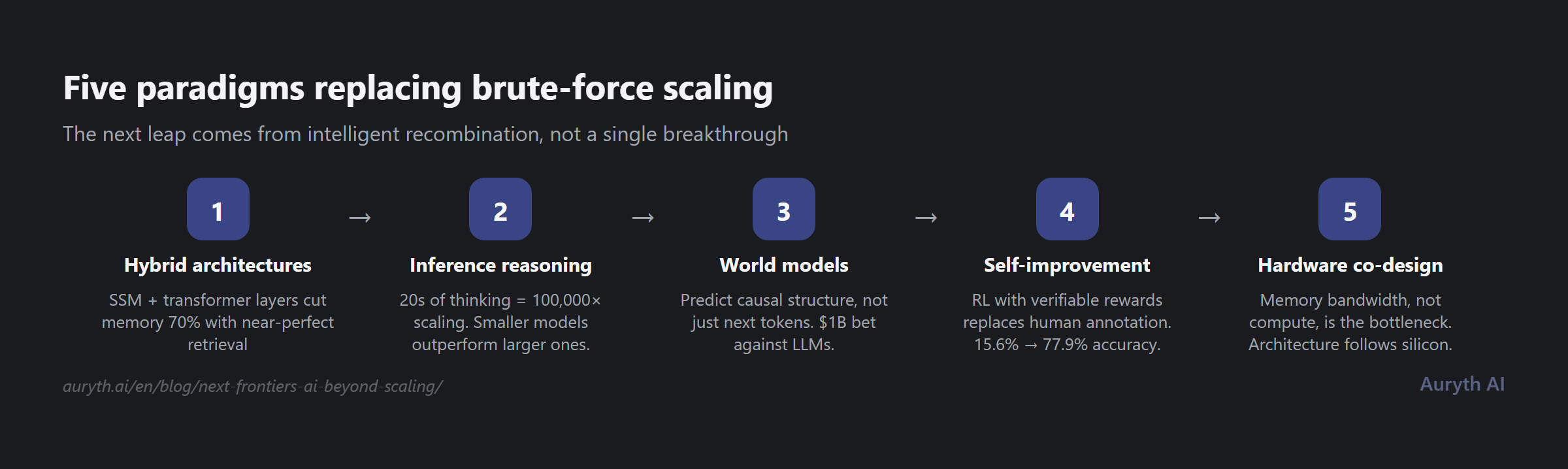

Het tijdperk van steeds grotere modellen loopt ten einde. Vijf paradigma's vervangen brute-force schaling — hybride architecturen, inferentie-redenering, wereldmodellen, zelflerende feedbackloops en hardware-co-design. Wat elk paradigma betekent voor AI in gereguleerde sectoren.

Door Auryth Team

De architecten van AI-schaling zeggen nu zelf dat hun eigen paradigma ten einde loopt. Ilya Sutskever, wiens werk aan schalingswetten de afgelopen vijf jaar AI-onderzoek vormgaf, vertelde The Decoder dat “we van het tijdperk van schaling naar het tijdperk van onderzoek bewegen.” Yann LeCun verliet Meta om meer dan een miljard dollar in te zetten op de stelling dat grote taalmodellen een doodlopende weg zijn. Zelfs Dario Amodei weigert aan te nemen dat meer investeren in rekenkracht automatisch vooruitgang garandeert.

Dit is geen abstract debat. Als u in een gereguleerde sector werkt — fiscaliteit, juridisch, compliance — wordt de volgende generatie AI-tools waarop u vertrouwt bepaald door het paradigma dat wint. Begrijpen wat er aankomt helpt u onderscheid te maken tussen wat echt is en wat hype.

De korte versie: vijf verschillende benaderingen vervangen brute-force schaling, elk gericht op een andere beperking van huidige systemen. Geen enkele zal alleen winnen. De volgende sprong komt uit hun combinatie.

Hybride architecturen vervangen stilletjes pure transformers

De transformer-architectuur die vandaag elk groot taalmodel aandrijft heeft een fundamenteel probleem: self-attention schaalt kwadratisch met de sequentielengte. Verdubbel het contextvenster, verviervoudig de rekenkracht. Dit werkte toen modellen een paar duizend tokens verwerkten. Het faalt wanneer u door complete wetboeken moet zoeken.

De oplossing is niet transformers vervangen — maar ze verdunnen. Productiesystemen van IBM, NVIDIA en AI21 wisselen nu transformer-aandachtslagen af met state-space model (SSM) lagen. AI21’s Jamba gebruikt één aandachtslaag per acht lagen totaal. IBM Granite 4.0 draait op één op de tien. NVIDIA’s Nemotron-H daalt tot ongeveer 8% aandacht.

De resultaten zijn relevant voor professionele toepassingen: 70% minder geheugenverbruik, twee tot vijf keer hogere doorvoer, en nagenoeg perfecte documentretrieval zelfs met minimale aandachtslagen.

Waarom niet naar nul aandacht? Omdat een ablatie-onderzoek uit 2025 aantoonde dat het verwijderen van alle aandachtslagen de retrieval-nauwkeurigheid tot letterlijk nul doet dalen. SSM-lagen dragen op zichzelf niets bij aan retrieval. Maar u heeft veel minder aandachtslagen nodig dan iedereen aannam — slechts drie volstaan voor betrouwbare retrieval in een model met 50 lagen.

Voor retrieval-augmented generation-systemen zoals het systeem achter Auryth is dit direct relevant. Hybride architecturen betekenen sneller zoeken door grotere juridische databases, langere effectieve contextvensters voor het kruislings verwijzen van bepalingen, en lagere inferentiekosten per zoekopdracht — zonder de precisie op te offeren die autoriteitsgewogen retrieval vereist.

Inferentie-redenering ruilt denktijd in voor modelomvang

De belangrijkste schalingswet die recent ontdekt is, gaat niet over training. Het gaat over inferentie.

Noam Brown van OpenAI zei het onomwonden: een model 20 seconden laten nadenken over een pokerhand leverde dezelfde prestatieverbetering op als het model 100.000 keer opschalen en 100.000 keer langer trainen. Het baanbrekende paper van Snell et al. toonde aan dat optimaal toegewezen test-time rekenkracht kleinere modellen beter laat presteren dan veel grotere modellen in vergelijkbare evaluaties.

OpenAI’s o-serie modellen gebruiken grootschalig reinforcement learning om interne denkketens te genereren — inclusief terugkeren en zelfcorrectie. Hun o4-mini haalt 99,5% op wiskundige competitieproblemen tegen ruwweg 30% van de kosten van o3.

Maar er zijn twee harde plafonds. Het kostenplafond: complexe queries kunnen meer dan 100 keer de rekenkracht van een enkele passage vereisen. Het wandklokplafond is subtieler en ingrijpender — wanneer evaluaties drie weken duren omdat het model drie weken denktijd nodig heeft, wordt tijd zelf de bottleneck.

Het onderzoek toont aan dat geen enkele redeneerstrategie universeel domineert. Self-consistency (meerderheidsstemming) bereikt een plateau ongeacht extra rekenkracht. Process reward models die per stap feedback geven zijn 8% nauwkeuriger en tot vijf keer rekenefficiënter. Monte Carlo tree search-varianten beslissen dynamisch of ze nieuwe kandidaten verkennen of bestaande verfijnen.

Voor betrouwbaarheidsscoring in professionele contexten heeft dit directe implicaties. Een systeem dat meer denktijd kan investeren in ambigue queries — en meldt wanneer zijn betrouwbaarheid laag is — is fundamenteel nuttiger dan een systeem dat elke vraag identiek verwerkt. De uitdaging is dit rekenkundig haalbaar maken voor professioneel gebruik in realtime.

Wereldmodellen en neurosymbolische systemen richten zich op redeneren zelf

De diepste kloof in AI-onderzoek vandaag stelt taalmodelschaling tegenover fundamenteel andere benaderingen van begrip.

LeCuns nieuwe onderneming, AMI Labs, haalde $1,03 miljard op tegen een waardering van $3,5 miljard — met onder meer NVIDIA, Bezos en Samsung als investeerders — om systemen te bouwen op basis van Joint Embedding Predictive Architecture (JEPA). In plaats van het volgende token te voorspellen, voorspelt JEPA abstracte representaties van de werkelijkheid. Het doel is causaal begrip in plaats van statistische patroonherkenning.

LeCuns standpunt is ondubbelzinnig: “Als u geïnteresseerd bent in AI op menselijk niveau, werk dan niet aan LLM’s.”

Het pragmatische tegenargument komt van systemen die neurale netwerken combineren met formele verificatie. DeepMinds AlphaProof, gepubliceerd in Nature, combineert een taalmodel met reinforcement learning om wiskundige stellingen te bewijzen in de formele taal Lean. Op de Internationale Wiskundeolympiade 2024 loste het problemen op die slechts vijf menselijke deelnemers aankonden — en elk bewijs werd geverifieerd door de stellingbewijzer. Hallucinaties zijn onmogelijk.

Dit is relevant voor juridische AI omdat het een haalbare architectuur demonstreert voor bewijsbaar correcte redenering. Een systeem dat zijn eigen conclusies formeel kan verifiëren tegen een juridische kennisbank — niet alleen ophalen en samenvatten, maar logische consistentie bewijzen — zou een kwalitatieve sprong voorwaarts zijn ten opzichte van huidige RAG-benaderingen.

François Chollets ARC-AGI-benchmark blijft de kloof blootleggen. Het beste commerciële model scoort 37,6% op taken die echt redeneren vereisen in plaats van patroonherkenning. Chollets kernvinding: “De redeneerprestaties van huidige frontier-AI blijven fundamenteel beperkt tot kennisdekking.” Menselijk redeneren generaliseert voorbij trainingsdata op manieren die huidige systemen niet kunnen.

Zelfverbetering werkt maar kent harde grenzen

DeepSeek-R1 demonstreerde iets opmerkelijks: reinforcement learning direct toepassen op een basismodel met alleen op correctheid gebaseerde beloningen — zonder supervised fine-tuning, zonder menselijke demonstraties — produceerde een model dat spontaan zelfverificatie en reflectie ontwikkelde. Slagingspercentages op wiskundige competitieproblemen sprongen van 15,6% naar 77,9% door pure reinforcement learning.

Maar hetzelfde paper onthulde een kritieke grens: reinforcement learning op kleinere modellen “kan simpelweg niet concurreren met distillatie vanuit een capabelere leraar.” Een gedistilleerd model met 32 miljard parameters presteerde beter dan grotere modellen die hun eigen reinforcement learning vanaf nul uitvoerden.

Puur zelflerend bootstrappen heeft een plafond. U heeft eerst een sterke leraar nodig. Dit ondergraaft de meest optimistische visies op recursieve zelfverbetering, maar valideert een genuanceerder pad: grote frontier-modellen genereren geverifieerde redeneertraces, die worden gedistilleerd in kleinere modellen, die als basis dienen voor de volgende verbeteringsronde.

De bredere post-training-revolutie is verschoven van menselijke voorkeuren naar verifieerbare beloningen. Wiskundige correctheid, code-uitvoering, formele bewijssystemen — deze vervangen dure menselijke annotatie door geautomatiseerde verificatie. Dit is hetzelfde principe achter Auryths betrouwbaarheidsscoring: verifieerbaarheid boven zelfinschatting door het model.

Model collapse — degradatie wanneer modellen op hun eigen output trainen — is reëel maar beheersbaar. De cruciale bevinding: als u originele, echte data in de trainingsmix houdt, wordt collapse voorkomen. Met meer dan 74% van nieuw gecreëerde webpagina’s die nu AI-gegenereerde tekst bevatten, is datacuratie even belangrijk geworden als het trainingsalgoritme zelf.

Hardware is de onzichtbare hand die elke architectuur vormgeeft

Transformers wonnen dankzij GPU’s, niet ondanks GPU’s. Self-attention is dichte matrixvermenigvuldiging die 80–90% hardware-utilisatie bereikt. SSM’s, met hun recurrente operaties, piekten aanvankelijk op 10–15% utilisatie — waardoor ze in de praktijk langzamer waren ondanks betere theoretische schaling.

De geheugenbandbreedte-muur is de dominante beperking geworden. Taalmodel-inferentie wordt beperkt door geheugenbandbreedte, niet door rekenkracht. Dit is waarom Cerebras, met zijn enorme on-chip geheugenbandbreedte, ruwweg twee keer de snelheid levert van NVIDIA’s nieuwste chips voor grote modellen.

Energieverbruik komt op als architecturele drijfveer. Amerikaanse datacenters verbruikten 183 terawattuur in 2024. Het energieverbruik van AI alleen kan in 2026 134 terawattuur per jaar bereiken — equivalent aan het totale verbruik van Zweden. Deze thermodynamische druk begunstigt architecturen die slechts een fractie van hun parameters per query activeren: mixture-of-experts modellen, agressieve kwantisatie, en mogelijk neuromorfische benaderingen.

Voor professionele AI-toepassingen heeft het hardwaretraject een concrete implicatie: inferentiekosten bepalen welke AI-tools commercieel levensvatbaar zijn op schaal. De architecturen die nauwkeurige resultaten leveren met de minste rekenkracht per query — precies de efficiëntie die hybride zoektechnologie en gerichte retrieval bieden — zullen de uitrol-race winnen.

Wat dit betekent voor AI in gereguleerde sectoren

Vijf paradigma’s convergeren. Hybride architecturen leveren snelheid en schaal. Inferentie-redenering levert diepgang bij moeilijke problemen. Wereldmodellen beloven causaal begrip. Zelflerende feedbackloops verminderen de afhankelijkheid van menselijke annotatie. Hardwarebeperkingen dwingen efficiëntie af.

Voor professionals die voor onderzoek afhankelijk zijn van AI — in fiscaliteit, juridische dienstverlening, compliance — volgen drie dingen.

Ten eerste zal nauwkeurigheid niet verbeteren door grotere modellen, maar door betere redeneerarchitecturen. Systemen die meer rekenkracht kunnen inzetten bij moeilijkere vragen, hun eigen conclusies kunnen verifiëren en echte onzekerheid rapporteren, zullen systemen vervangen die elke vraag op dezelfde manier verwerken.

Ten tweede worden retrieval-gebaseerde systemen belangrijker, niet minder belangrijk. Naarmate taalmodellen tegen datamuren en schalingsplateaus aanlopen, wordt het vermogen om te zoeken, te rangschikken en te citeren uit gezaghebbende bronnen — de kern van wat Auryth bouwt — het onderscheidende kenmerk in plaats van de trainingsdata alleen.

Ten derde zullen de kosten van AI-inferentie bepalen welke tools commercieel overleven. Architecturen die professionele nauwkeurigheid leveren tegen duurzame rekenkosten zullen zowel goedkope-maar-onbetrouwbare chatbots als dure-maar-briljante frontier-modellen overtreffen. De sweet spot is retrieval-augmented systemen met gerichte redenering — precies waar het ertoe doet, efficiënt overal elders.

Het tijdperk van “maak het gewoon groter” is voorbij. Het tijdperk van slimmer maken is begonnen.