Der EU AI Act und KI für Rechtsberatung: was belgische Steuerberater tatsächlich wissen müssen

Der AI Act ist seit dem 1. August 2024 in Kraft. Einige Bestimmungen gelten bereits. Die meisten Artikel verwechseln die Pflichten von Anbietern mit denen von Anwendern — hier ist die Unterscheidung, die für Ihre Praxis wichtig ist.

Von Auryth Team

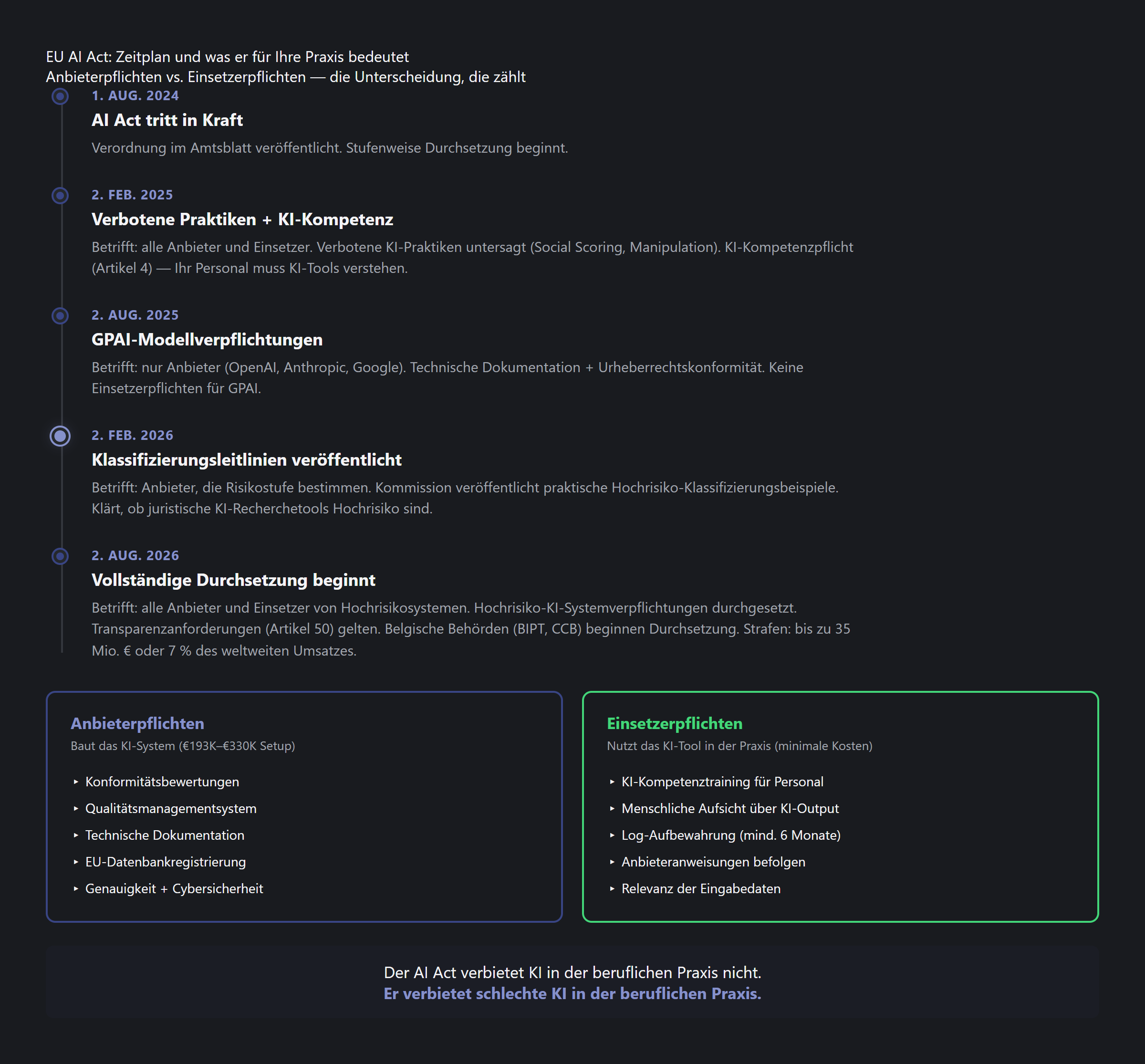

Der EU AI Act ist bereits in Kraft. Nicht in der Zukunft — seit dem 1. August 2024. Verbotene KI-Praktiken sind seit Februar 2025 untersagt. Die Verpflichtungen zur KI-Kompetenz gelten jetzt bereits. Und im August 2026 — in sechs Monaten — beginnt die Durchsetzung der Verpflichtungen für Hochrisikosysteme, unterstützt durch Strafen von bis zu 35 Millionen Euro oder 7 % des weltweiten Umsatzes.

Wenn Sie ein belgischer Steuerberater sind, der KI-Tools in seiner Praxis einsetzt, hat Sie wahrscheinlich jeder Artikel über diese Verordnung mehr erschreckt, als er sollte. Hier ist der Grund: Fast alles, was über den AI Act geschrieben wird, verwechselt, was Anbieter tun müssen, mit dem, was Anwender tun müssen. Der Unterschied ist nicht akademisch. Es ist der Unterschied zwischen 330.000 Euro Compliance-Kosten und im Wesentlichen null.

Die entscheidende Unterscheidung: Anbieter vs. Anwender

Der AI Act schafft zwei grundlegend verschiedene Rollen mit grundlegend verschiedenen Verpflichtungen.

Anbieter entwickeln KI-Systeme. OpenAI, Anthropic, Google, Auryth — jeder, der ein KI-System entwickelt, trainiert oder auf den Markt bringt. Anbieter von Hochrisiko-KI-Systemen müssen Konformitätsbewertungen durchführen, Qualitätsmanagementsysteme implementieren, umfangreiche technische Dokumentation führen, ihre Systeme in der EU-Datenbank registrieren und Genauigkeit, Robustheit und Cybersicherheit gewährleisten.

Anwender nutzen KI-Systeme in einem beruflichen Kontext. Das sind Sie. Anwaltskanzleien, Steuerberatungskanzleien, Steuerabteilungen von Unternehmen — jeder, der ein KI-Tool als Teil seiner beruflichen Arbeit nutzt.

Ihre Verpflichtungen als Anwender sind leichter, praktischer und deutlich kostengünstiger:

| Verpflichtung | Was es in der Praxis bedeutet |

|---|---|

| KI-Kompetenz (Artikel 4) | Stellen Sie sicher, dass Ihre Mitarbeiter die Grundlagen der von ihnen verwendeten KI-Tools verstehen, deren Grenzen und Risiken. Interne Schulungen genügen — keine Zertifizierung erforderlich |

| Menschliche Aufsicht (Artikel 26) | Ein qualifizierter Fachmann überprüft den KI-Output, bevor er die Mandanten erreicht. Wenn Sie das bereits tun — und das sollten Sie — sind Sie bereits konform |

| Protokollaufbewahrung | Bewahren Sie systemgenerierte Protokolle für mindestens sechs Monate auf |

| Relevanz der Eingabedaten | Verwenden Sie das Tool wie vorgesehen, mit angemessenen Eingabedaten |

| Gebrauchsanweisungen befolgen | Lesen und befolgen Sie die Dokumentation des Anbieters |

Das ist alles. Keine Konformitätsbewertung. Kein Qualitätsmanagementsystem. Keine Einrichtungskosten von 193.000 bis 330.000 Euro. Die Compliance-Belastung für Anwender besteht aus Schulung, Aufsicht und Dokumentation — Aktivitäten, die jede kompetente berufliche Praxis bereits durchführen sollte.

Was bereits in Kraft ist

Die Durchsetzung des AI Act folgt einem gestaffelten Zeitplan. Einige Bestimmungen sind bereits aktiv:

Seit dem 2. Februar 2025:

- Verbotene KI-Praktiken sind untersagt. Social Scoring, manipulative unterschwellige Techniken, Ausnutzung von Schwachstellen, Echtzeit-Fernidentifikation mittels biometrischer Daten im öffentlichen Raum (mit begrenzten Ausnahmen). Nichts davon betrifft KI-Tools für die Steuerrecherche.

- Verpflichtungen zur KI-Kompetenz gelten. Artikel 4 verlangt von Anbietern und Anwendern, dass sie ein „ausreichendes Niveau an KI-Kompetenz” bei Mitarbeitern sicherstellen, die KI-Systeme bedienen oder von ihnen betroffen sind. Dies gilt jetzt — nicht erst im August 2026.

Seit dem 2. August 2025:

- Verpflichtungen für allgemeine KI-Modelle (GPAI) gelten. Dies betrifft Anbieter von Grundlagenmodellen — OpenAI für ChatGPT, Anthropic für Claude, Google für Gemini. Sie müssen technische Dokumentation führen, Urheberrechtsregeln einhalten und Zusammenfassungen der Trainingsdaten veröffentlichen. Als Anwender haben Sie keine GPAI-spezifischen Verpflichtungen. Dies ist die Last des Anbieters.

Ab dem 2. August 2026:

- Vollständige Verpflichtungen für Hochrisiko-KI-Systeme treten in Kraft. Transparenzanforderungen gemäß Artikel 50 gelten. Nationale Behörden — in Belgien das BIPT, das Centre for Cybersecurity Belgium und die Arbeitsinspektion — beginnen mit der Durchsetzung.

Ab dem 2. Februar 2026:

- Die Europäische Kommission veröffentlicht Klassifizierungsrichtlinien mit praktischen Beispielen zur Bestimmung, ob ein KI-System als Hochrisiko einzustufen ist. Diese Leitlinien kommen sechs Monate vor der Durchsetzung und geben dem Markt ein letztes Zeitfenster zur Anpassung.

Die Hochrisikofrage: qualifiziert sich KI für Rechtsberatung?

Hier wird die Diskussion wirklich komplex — und hier vereinfacht die meiste Kommentierung zu stark.

Anhang III des AI Act listet Kategorien von KI-Systemen auf, die als Hochrisiko gelten. Punkt 8 umfasst die „Justizverwaltung und demokratische Prozesse” und schließt ausdrücklich KI-Systeme ein, die „einer Justizbehörde bei der Recherche und Interpretation von Fakten und Recht sowie bei der Anwendung des Rechts auf einen konkreten Sachverhalt helfen sollen.”

Lesen Sie das sorgfältig. Der Text sagt Justizbehörde — Gerichte, Richter, Tribunale. Nicht Anwälte. Nicht Steuerberater. Nicht Buchhalter.

Ein KI-Tool für Steuerrecherche, das von einem professionellen Berater zur Recherche von Bestimmungen und zur Vorbereitung von Beratung genutzt wird, unterstützt keine Justizbehörde. Es unterstützt einen Fachmann bei seiner vorbereitenden Arbeit. Diese Unterscheidung ist rechtlich relevant, und die kommenden Klassifizierungsrichtlinien der Europäischen Kommission (Februar 2026) werden sie voraussichtlich klären.

Darüber hinaus bietet Artikel 6(3) einen ausdrücklichen Ausnahmeweg. Ein in Anhang III aufgeführtes KI-System gilt nicht als Hochrisiko, wenn es:

- Eine „eng begrenzte verfahrenstechnische Aufgabe” ausführt

- Das Ergebnis einer „zuvor abgeschlossenen menschlichen Tätigkeit” verbessert

- Das Ergebnis einer Entscheidungsfindung nicht „wesentlich beeinflusst”

Ein Recherche-Tool, das rechtliche Bestimmungen für einen Fachmann abruft und organisiert, damit dieser sie interpretiert und anwendet, passt auf diese Beschreibung. Das Urteil des Fachmanns — nicht der Output der KI — bestimmt die Beratung. Die KI führt vorbereitende Arbeit aus; der Mensch trifft die Entscheidung.

Eine kritische Ausnahme: Ausnahmen nach Artikel 6(3) gelten niemals, wenn das KI-System Profiling natürlicher Personen durchführt. Wenn ein KI-Tool für Steuerberatung Empfehlungen basierend auf individuellen Mandantenmerkmalen personalisiert, könnte es unabhängig vom Ausnahmeweg in die Hochrisikoklassifizierung fallen. Dies ist die wichtigste Designbeschränkung für Anbieter von KI für Rechtsberatung.

Was dies speziell für die belgische Praxis bedeutet

Belgiens Umsetzung des AI Act spiegelt seine föderale Struktur wider:

- BIPT (Belgisches Institut für Postdienste und Telekommunikation) dient als Marktüberwachungsbehörde und zentrale Anlaufstelle

- Centre for Cybersecurity Belgium behandelt Cybersicherheitsaspekte

- Arbeitsinspektion deckt KI in betrieblichen Kontexten ab

- COC (Aufsichtsbehörde für Polizeiinformationen) deckt KI in der Strafverfolgung ab

Entscheidend ist, dass der AI Act eine Maximalharmonisierungs-Verordnung ist. Belgien kann keine eigenen zusätzlichen KI-Regeln einführen. Der Rahmen ist einheitlich in der EU — was bedeutet, dass Compliance in Belgien Compliance überall bedeutet.

Die Position der belgischen Anwaltschaft

Der OVB (Flämischer Anwaltsverband) und die NOvA (Niederländischer Anwaltsverband) veröffentlichten gemeinsame KI-Richtlinien über alice.law, die eine zulassende, aber vorsichtige Haltung einnehmen:

- Die Nutzung von KI ist „weder verboten noch verpflichtend” — sie fällt in die berufliche „Freiheit und Verantwortung” des Anwalts

- Anwälte sollten personenbezogene Daten pseudonymisieren, bevor sie diese in KI-Tools eingeben

- Grundsätzlich sollten personenbezogene Daten nicht in KI-Tool-Prompts eingegeben werden

- Anwälte müssen die Nutzungsbedingungen des KI-Tools lesen und verstehen: Richtlinien zum Datentraining, Speicherorte für Datenübertragung und -speicherung, ob das System offen oder geschlossen ist, Haftungsbestimmungen und IP-Regeln

- Der Anwalt bleibt vollständig verantwortlich für jeden KI-generierten Output, der in der beruflichen Arbeit verwendet wird

Der CCBE (Rat der Anwaltskammern Europas) verstärkte dies mit seinem Leitfaden vom Oktober 2025 zur Nutzung generativer KI durch Anwälte und etablierte einen europaweiten Rahmen, der berufliche Verantwortung über Verbot betont.

Die Position der belgischen Buchhalter

Das ITAA-Barometer 2025 zeigt einen Berufsstand, der sich der KI zuwendet, statt sich von ihr abzuwenden:

- 71 % der belgischen Buchhalter sehen KI als Chance für personalisierte Beratung

- 80 % glauben, dass es ihre berufliche Pflicht ist, Mandanten durch die digitale Transformation zu führen

- 59 % möchten in sichere Datenverwaltungslösungen investieren

ITAA-Präsident Bart Van Coile erklärte, dass Mitglieder „den Druck zunehmend komplexer Vorschriften spüren, aber der Anker des Vertrauens” für ihre Mandanten bleiben. Diese Rahmung — KI als Werkzeug, das die Rolle des vertrauenswürdigen Beraters verbessert, nicht bedroht — entspricht genau der regulatorischen Philosophie des AI Act.

Die Verpflichtung zur KI-Kompetenz: was sie tatsächlich erfordert

Artikel 4 ist die Bestimmung, die die meisten belgischen Fachleute übersehen, obwohl sie bereits in Kraft ist. Sie verlangt, dass Anbieter und Anwender sicherstellen, dass Mitarbeiter ein „ausreichendes Niveau an KI-Kompetenz” haben, unter Berücksichtigung ihres „technischen Wissens, ihrer Erfahrung, Ausbildung und Schulung” sowie des „Kontexts, in dem die KI-Systeme verwendet werden sollen.”

In der Praxis bedeutet dies:

- Ihre Mitarbeiter sollten verstehen, wie die von ihnen verwendeten KI-Tools auf konzeptioneller Ebene funktionieren — nicht die technische Architektur, sondern den allgemeinen Ansatz (abrufbasiert vs. generativ, was „Confidence Scoring” bedeutet, warum Quellen wichtig sind)

- Ihre Mitarbeiter sollten verstehen, was die Grenzen des Tools sind — was es nicht kann, wo es Fehler macht, wann unabhängig überprüft werden muss

- Ihre Mitarbeiter sollten verstehen, was der berufliche Verantwortungsrahmen ist — die KI gibt einen Entwurf aus, der Fachmann übernimmt die Beratung

- Dokumentation — interne Schulungsunterlagen genügen. Keine formale Zertifizierung erforderlich

Es gibt keine eigenständige Geldstrafe für Verstöße gegen Artikel 4. Aber sie fungiert als „wesentlicher erschwerender Faktor” bei jeder behördlichen Untersuchung. Wenn ein Problem auftritt und die Untersuchung keine KI-Kompetenzschulung aufdeckt, kann jede andere Strafe erhöht werden.

Die nationale Durchsetzung der KI-Kompetenz beginnt im August 2026 durch Marktüberwachungsbehörden — in Belgien bedeutet das BIPT.

Die GDPR-Schnittstelle

Für belgische Steuerberater funktioniert der AI Act nicht isoliert. Jedes KI-Tool, das personenbezogene Daten verarbeitet — Mandantennamen, Finanzinformationen, Steuerpositionen — muss gleichzeitig sowohl dem AI Act als auch der GDPR entsprechen.

Wichtige Interaktionspunkte:

- Datenminimierung gilt für beide Rahmen. Die Anforderung der OVB-Leitlinien, Daten zu pseudonymisieren, bevor sie in KI-Tools eingegeben werden, ist nicht nur professionelle Best Practice — sie ist GDPR-konform

- Automatisierte Entscheidungsfindung gemäß GDPR Artikel 22 und die Profiling-Regeln des AI Act schaffen überlappende Verpflichtungen. Wenn Ihr KI-Tool Entscheidungen über Personen trifft oder wesentlich beeinflusst, gelten beide Rahmen vollständig

- Der Digital Omnibus (November 2025) führte GDPR-Änderungen ein, die KI-Training als „berechtigtes Interesse” anerkennen und damit eine der Hauptspannungen zwischen den beiden Rahmen teilweise auflösen

Für die professionelle Steuerpraxis: Halten Sie personenbezogene Daten nach Möglichkeit aus Prompts heraus, pseudonymisieren Sie, wo nicht, und stellen Sie sicher, dass Ihr KI-Anbieter eine dokumentierte GDPR-Compliance für seine Datenverarbeitung hat. Dies sind Anwenderpflichten, die keine rechtliche Expertise zur Umsetzung erfordern — nur Bewusstsein und Disziplin.

Der Strafrahmen

Die Zahlen sind groß genug, um Aufmerksamkeit zu rechtfertigen:

| Verstoß | Maximale Strafe |

|---|---|

| Verbotene KI-Praktiken | 35 Millionen Euro oder 7 % des weltweiten Umsatzes (je nachdem, welcher Betrag höher ist) |

| Verpflichtungen für Hochrisikosysteme | 15 Millionen Euro oder 3 % des weltweiten Umsatzes |

| Irreführende Informationen gegenüber Behörden | 7,5 Millionen Euro oder 1 % des weltweiten Umsatzes |

Für KMU gilt der niedrigere der beiden Beträge. Für größere Organisationen der höhere Betrag. Dies sind Maximalstrafen — die tatsächliche Durchsetzung wird wahrscheinlich verhältnismäßig und abgestuft sein, ähnlich der Erfolgsbilanz der GDPR.

Das praktische Risiko für Anwender (professionelle Praxen, die KI-Tools nutzen) ist minimal, aus dem einfachen Grund, dass die Anwenderpflichten minimal sind. Schulen Sie Ihre Mitarbeiter, führen Sie Aufsicht, bewahren Sie Protokolle auf, befolgen Sie Anweisungen. Wenn Sie diese vier Dinge tun, ist der Strafrahmen für Ihre Praxis praktisch irrelevant.

Die eigentliche Compliance-Frage

Die wichtigste Erkenntnis aus dem AI Act ist nicht, was er verbietet. Es ist, was er legitimiert.

Wenn eine Verordnung explizite Compliance-Kriterien für KI-Tools in beruflichen Kontexten festlegt, schafft sie gleichzeitig zwei Kategorien: Tools, die die Kriterien erfüllen, und Tools, die dies nicht tun. Allzweck-Chatbots, die für Steuerrecherche verwendet werden — ohne Quellentransparenz, ohne Audit-Trails, ohne dokumentierte Genauigkeit, ohne Design für menschliche Aufsicht — werden es zunehmend schwer haben, ihre Nutzung in der professionellen Praxis zu rechtfertigen, wenn das regulatorische Rahmenwerk reift.

Speziell entwickelte KI-Tools für Rechtsberatung, die mit Transparenz, Quellenangabe, Confidence Scoring und Human-in-the-Loop-Architektur konzipiert sind, sind nicht nur bessere Tools. Sie sind die konformen Tools. Der AI Act verbietet KI nicht in der professionellen Praxis — er verbietet schlechte KI in der professionellen Praxis.

Der OVB positioniert KI bereits als legitimes Unterstützungstool. Das ITAA sieht KI bereits als Chance. Der regulatorische Rahmen bietet nun die Compliance-Struktur, die professionelles Interesse in professionelle Praxis verwandelt.

Eine praktische Compliance-Checkliste für belgische Steuerpraxen

Bereits erforderlich (seit Februar 2025):

- Stellen Sie sicher, dass Mitarbeiter die von ihnen verwendeten KI-Tools verstehen (KI-Kompetenz, Artikel 4)

- Dokumentieren Sie interne Schulungen zu KI-Fähigkeiten und -Grenzen

Erforderlich bis August 2026:

- Implementieren Sie Verfahren zur menschlichen Aufsicht für KI-gestützte Beratung

- Bewahren Sie KI-Systemprotokolle für mindestens sechs Monate auf

- Stellen Sie sicher, dass verwendete KI-Tools gemäß Anbieteranweisungen eingesetzt werden

- Überprüfen Sie Anbieterdokumentation auf Compliance-Ansprüche

Laufende Best Practice:

- Pseudonymisieren Sie Mandantendaten, bevor Sie sie in KI-Prompts eingeben

- Überprüfen Sie KI-Output, bevor Sie ihn an Mandanten liefern

- Führen Sie Aufzeichnungen über KI-gestützte Recherche für Prüfungszwecke

- Beobachten Sie die Klassifizierungsrichtlinien der Europäischen Kommission (Februar 2026)

Related articles

- “Ich vertraue KI nicht für Steuerberatung” — und Sie haben recht. Hier ist, warum Sie es trotzdem versuchen sollten. →

- Wie man ein Legal-AI-Tool evaluiert: 10 Fragen, die wirklich wichtig sind →

- Was ist Confidence Scoring — und warum es ehrlicher ist als eine selbstsichere Antwort →

Wie Auryth TX dies umsetzt

Auryth TX ist durch Architektur für die Einhaltung des AI Act konzipiert, nicht nachträglich.

Jede Rechercheanfrage erzeugt eine vollständig belegte Antwort mit Zitaten auf Artikelebene, Confidence Scoring und einer vollständigen Prüfspur. Das Human-in-the-Loop-Design bedeutet, dass der Fachmann immer die endgültige interpretative Entscheidung trifft — das Tool ruft ab, organisiert und markiert; der Fachmann urteilt, berät und übernimmt Verantwortung.

Quellentransparenz ist kein Feature — sie ist das Fundament. Jede zitierte Bestimmung verlinkt auf ihre Quelle. Jeder Confidence Score spiegelt die Abrufqualität und Abdeckungstiefe wider. Jede Recherchesitzung erzeugt eine dokumentierte Spur, die für professionelle Unterlagen geeignet ist.

Für die Verpflichtung zur KI-Kompetenz: Die Benutzeroberfläche von Auryth ist so konzipiert, dass sie während der Arbeit lehrt. Confidence-Indikatoren, Quellenherkunft, Domänenabdeckungskarten und zeitliche Versionsflags machen das Reasoning des Tools sichtbar — und verwandeln jede Recherchesitzung in implizites Kompetenztraining.

Keine personenbezogenen Daten gelangen durch Design in das System. Anfragen betreffen rechtliche Bestimmungen, nicht Mandanten. Die Architektur eliminiert die GDPR-Schnittstelle, bevor sie entsteht.

Bei 99 Euro pro Monat kostet die Compliance-Infrastruktur, die den Anwenderanforderungen des AI Act entspricht, weniger als eine einzige Stunde Non-Compliance-Risiko.

Schneller recherchieren. Mehr abdecken. Besser beraten — konform.

Sources: 1. European Parliament and Council (2024). Regulation (EU) 2024/1689 (AI Act). Official Journal of the European Union. 2. OVB (2025). “AI-richtlijnen voor advocaten.” ovb.be. Siehe auch: Alice.law (2025). “AI guidelines for lawyers in Belgium and the Netherlands.” 3. CCBE (2025). “Guide on the use of generative AI by lawyers.” ccbe.eu. 4. ITAA (2026). “ITAA-Barometer 2025.” blogitaa.be. 5. European Commission (2025). “General-Purpose AI Code of Practice.” digital-strategy.ec.europa.eu. 6. Ooms, W. & Gils, T. (2025). “Implementing the AI Act in Belgium: Scope of Application and Authorities.” SSRN. 7. ICT Rechtswijzer (2025). “The AI Act — Belgian implementation.” ictrechtswijzer.be.