KI und Berufshaftung: was passiert, wenn die Antwort falsch ist?

Wenn KI-gestützte Steuerrecherche zu falschem Rat führt, ist das belgische Recht eindeutig: der Fachmann zahlt. Aber genau das ist das stärkste Argument für transparente KI — nicht dagegen.

Von Auryth Team

Ein belgischer Steuerberater verlässt sich auf ein KI-Tool, um den geltenden Steuersatz für die Anlagestruktur eines Mandanten zu recherchieren. Das Tool ruft Art. 19bis WIB 92 ab — echter Artikel, echtes Gesetzbuch — aber liefert die Version von vor der letzten Programmgesetzänderung. Der Berater gibt Rat auf Basis des veralteten Satzes. Der Mandant handelt danach. Der Steuerbescheid kommt. Der Schaden ist entstanden.

Wer zahlt?

Das belgische Recht beantwortet diese Frage ohne jede Zweideutigkeit. Der Fachmann zahlt. Jedes Mal. Unabhängig davon, welches Tool den Fehler verursacht hat.

Der Haftungsrahmen, der bereits existiert

Belgien braucht keine neue KI-Gesetzgebung, um die Haftungsfrage zu beantworten. Buch 6 des belgischen Zivilgesetzbuches — das am 1. Januar 2025 in Kraft trat — liefert den vollständigen Rahmen.

Art. 6.5 bestimmt, dass jeder für durch seine Schuld verursachten Schaden haftet. Art. 6.6 definiert Schuld als entweder Verstoß gegen eine spezifische gesetzliche Regel oder Verletzung der allgemeinen Sorgfaltspflicht (zorgvuldigheidsnorm). Kein Unterschied zwischen einem manuell begangenen Fehler und einem Fehler, der durch Vertrauen auf ein Tool entstand.

Der Maßstab ist der normaler sorgfältiger und kompetenter Berufsausübender in denselben Umständen. Ein Steuerberater, der sich ohne Überprüfung auf KI-Output verlässt, fällt unter diesen Standard, ebenso wie einer, der sich auf ein veraltetes Papiergesetzbuch verlässt.

Eine bedeutende Änderung im neuen Buch 6: Art. 6.3 schafft das alte Kumulierungsverbot ab (samenloopverbod). Ein durch falschen Steuerrat geschädigter Mandant kann nun sowohl vertragliche als auch deliktische Ansprüche gegen denselben Berater geltend machen. Dies erweitert die Haftungsfläche des Beraters.

Die KI-Fehlerepidemie, die niemand erwartet hat

Die Haftungsfrage ist nicht hypothetisch. Weltweit wurden 486 dokumentierte Fälle von KI-Halluzinationsfehlern in Gerichtsverfahren identifiziert — 324 allein vor US-amerikanischen Gerichten. Über 200 davon ereigneten sich in den ersten acht Monaten des Jahres 2025 (Jones Walker, 2025).

Der Präzedenzfall: Mata v. Avianca (SDNY, 2023). Anwälte reichten einen Schriftsatz mit sechs vollständig von ChatGPT fabrizierten Fallzitaten ein. Die Fälle existierten nicht. Die zitierten Richter hatten diese Entscheidungen nie verfasst. Das Ergebnis: 5.000 $ Ordnungsgeld und eine zerstörte berufliche Reputation.

Aber Mata v. Avianca war nur der Anfang. Mitte 2025 sanktionierten drei separate US-Bundesgerichte Anwälte wegen KI-generierter Halluzinationen innerhalb von zwei Wochen. Sanktionen erreichten 10.000 $ pro Vorfall.

Die alarmierendste Entwicklung: Im September 2025 wurden Anwälte sanktioniert, nicht weil sie KI-fabrizierte Zitate eingereicht hatten, sondern weil sie nicht erkannt hatten, dass die Zitate der Gegenseite gefälscht waren. Die Prüfpflicht weitet sich aus.

Die Abhängigkeitsfalle

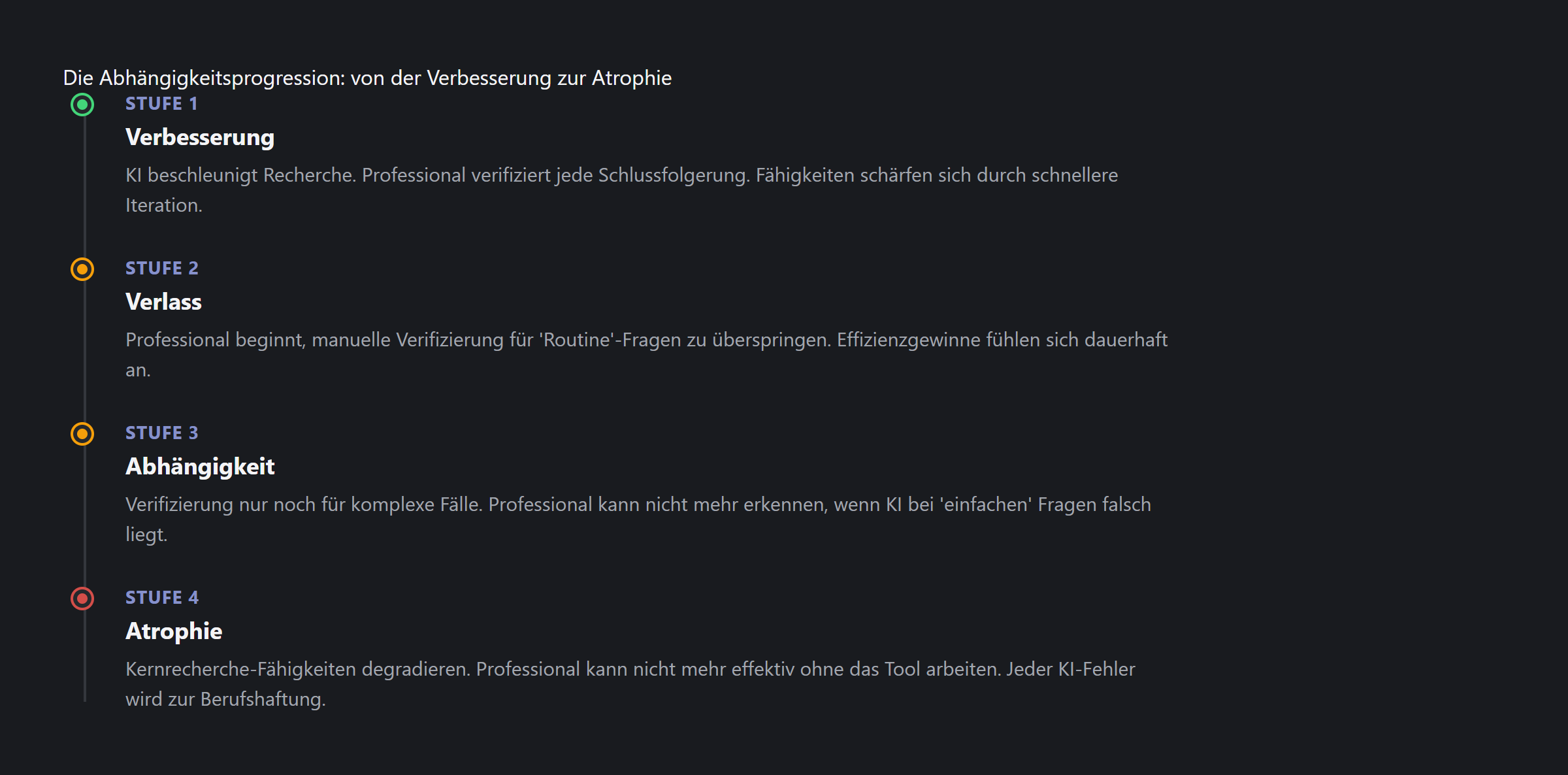

Diese Fälle offenbaren ein Muster, das über individuelle Nachlässigkeit hinausgeht. Forscher haben eine vierstufige Abhängigkeitsprogression in der KI-Adoption durch Fachleute identifiziert (Jones Walker, 2025):

- Verbesserung — KI unterstützt bei Routineaufgaben; der Fachmann behält volles Verständnis

- Integration — KI übernimmt zunehmend komplexe Arbeit, während das Vertrauen wächst

- Abhängigkeit — der Fachmann hat Schwierigkeiten, ohne KI zu arbeiten

- Atrophie — unabhängige Praxisfähigkeiten verschlechtern sich

Viele Wissensarbeiter haben bereits Stufe 3 erreicht. Hier erreicht das Haftungsrisiko seinen Höhepunkt: Der Fachmann vertraut KI genug, um aufzuhören zu prüfen, hat aber noch nicht genug Kompetenz verloren, damit es jemandem auffällt — bis etwas schiefgeht.

Die gefährlichste Phase der KI-Adoption ist, wenn der Fachmann dem Tool genug vertraut, um aufzuhören zu prüfen, aber nicht genug, um zu verstehen, wann es versagt.

Was die EU verlangt — und was nicht

Die EU-KI-Verordnung (Verordnung 2024/1689) führt KI-Kompetenzverpflichtungen ein (Art. 4, in Kraft seit 2. Februar 2025) und Pflichten für Betreiber von Hochrisiko-KI-Systemen (Art. 26, vollständige Einhaltung bis 2. August 2027). Fachleute, die KI für Steuerrecherche nutzen, könnten als „Betreiber” gelten — was menschliche Aufsicht, Monitoring und Aufzeichnungspflichten erfordern würde.

Die überarbeitete Produkthaftungsrichtlinie (in Kraft seit 8. Dezember 2024, Umsetzungsfrist 9. Dezember 2026) umfasst nun ausdrücklich Software, einschließlich KI-Systeme. Wenn ein KI-Tool ein fehlerhaftes Ergebnis produziert — etwa veraltetes Recht serviert — könnte der Hersteller verschuldensunabhängig haften. Dies schafft einen Regressweg: Der Fachmann entschädigt den Mandanten und nimmt dann den KI-Anbieter in Regress.

Was die EU nicht hat: eine harmonisierte KI-Haftungsrichtlinie. Der Vorschlag für eine KI-Haftungsrichtlinie wurde im Oktober 2025 zurückgezogen, nachdem sich die Interessengruppen nicht auf Kausalitätsvermutungen einigen konnten. Das bedeutet, dass belgische Fachleute vollständig auf nationales Haftungsrecht zurückfallen — Art. 6.5 und 6.6 des Zivilgesetzbuches.

Das konträre Argument: KI NICHT zu nutzen wird zum Risiko

Die meisten Fachleute betrachten KI als Haftungsrisiko. Die interessantere Frage ist, ob sich das Risiko in die entgegengesetzte Richtung verschiebt.

Die ABA Model Rule 1.1 (Kommentar 8, geändert 2012) verlangt von Anwälten, „über Veränderungen im Recht und seiner Praxis auf dem Laufenden zu bleiben, einschließlich der Vorteile und Risiken relevanter Technologie.” Das formelle Gutachten 512 der ABA (Juli 2024) erstreckte dies ausdrücklich auf generative KI: Anwälte müssen „ein angemessenes Verständnis der Fähigkeiten und Grenzen” von KI-Tools haben.

Das Muster ist vertraut. Als elektronische juristische Datenbanken verfügbar wurden — Jura, monKEY, Fisconetplus — erklärte kein einzelnes Gericht rein manuelle Recherche als fahrlässig. Aber der Standard verschob sich organisch. Gerichte und Kollegen begannen, datenbankgestützte Recherche als Basiskompetenz zu betrachten. Heute würde ein Steuerberater, der eine komplexe grenzüberschreitende Frage nur mit Papiergesetzbüchern recherchiert, als nachlässig gelten, nicht als prinzipientreu.

KI-Recherchetools befinden sich auf derselben Trajektorie. Wenn ein Tool nachweislich Gesetzesänderungen schneller erkennt als manuelle Überwachung, kann ein Fachmann, der es ignoriert, behaupten, seiner Sorgfaltspflicht nachgekommen zu sein?

| Ansatz | Haftungsargument |

|---|---|

| Nutzt KI ohne Verifizierung | Unter Sorgfaltsstandard — nicht geprüft, blind vertraut |

| Nutzt KI mit Verifizierung | Über Sorgfaltsstandard — breitere Recherche, dokumentierte Quellen, Prüfpfad |

| Nutzt gar keine KI | Heute: vertretbar. Morgen: zunehmend schwieriger zu rechtfertigen, wenn der Standard sich verschiebt |

Das Transparenz-Argument

Wenn die Berufshaftung unabhängig vom Tool bestehen bleibt, ist die Frage nicht, ob man KI nutzen soll — sondern welcher KI man vertrauen kann.

Ein undurchsichtiges KI-Tool (generischer Chatbot, keine Quellen) gibt dem Fachmann nichts zum Verifizieren und nichts zum Zitieren. Wenn das Ergebnis falsch ist, gibt es keinen Prüfpfad, kein Vertrauenssignal und keine Möglichkeit, Sorgfalt nachzuweisen.

Ein transparentes KI-Tool (Quellenangaben, Konfidenzwerte, temporale Versionierung, Autoritätsranking) gibt dem Fachmann genau das, was er für einen vertretbaren Workflow braucht:

- Quellenangaben verknüpfen jede Antwort mit spezifischen Bestimmungen, Urteilen oder Kommentaren — in Sekunden verifizierbar

- Konfidenzwerte signalisieren, wenn das System unsicher ist — der Fachmann weiß, wo er nachprüfen muss

- Versionshistorie zeigt, welche Gesetzesversion angewandt wurde — keine stille Anwendung veralteter Bestimmungen

- Prüfpfade dokumentieren, was gesucht wurde, wann und was gefunden wurde — Nachweis der Sorgfalt

Das Paradox: Das KI-Tool, das Unsicherheit zugibt, ist sicherer als jenes, das selbstsicher klingt.

Praktischer Rahmen: KI vertretbar einsetzen

Für belgische Steuerfachleute, die sich in dieser Landschaft bewegen, sechs Prinzipien:

- Verifizieren Sie jedes kritische Zitat. KI beschleunigt Recherche; sie ersetzt nicht die Verifizierung. Prüfen Sie die Artikelnummer, das Versionsdatum und ob die zitierte Quelle die Behauptung tatsächlich stützt

- Dokumentieren Sie Ihren Prozess. Protokollieren Sie, welche Abfragen Sie durchgeführt haben, welche Quellen das Tool zurückgegeben hat und welche Prüfschritte Sie unternommen haben. Dies ist Ihr Nachweis der Sorgfalt

- Beachten Sie die Vertrauenssignale. Wenn ein Tool Unsicherheit signalisiert, behandeln Sie das als Anlass für manuelle Recherche — nicht als Grund, die Antwort zu ignorieren

- Verstehen Sie die Grenzen des Tools. Wissen Sie, welchen Korpus es abdeckt, wie häufig es aktualisiert wird und welche Inhaltstypen es ausschließt. Art. 4 der KI-Verordnung verlangt diese Kompetenz

- Bewahren Sie unabhängige Kompetenz. Die Abhängigkeitsprogression ist real. Recherchieren Sie periodisch ohne KI, um Ihre professionellen Fähigkeiten scharf zu halten

- Wählen Sie transparente Tools. Ein KI-Tool ohne Quellenangaben ist ein Risiko — kein Vorteil. Wenn Sie das Ergebnis nicht verifizieren können, können Sie den Rat nicht verteidigen

Häufige Fragen

Verlagert der Einsatz von KI die Berufshaftung auf den KI-Anbieter?

Nein. Nach belgischem Haftungsrecht (Art. 6.5-6.6 ZGB) haftet der Fachmann für seine eigene Schuld — einschließlich der Schuld, sich auf nicht verifizierte KI-Ergebnisse zu verlassen. Der Fachmann kann jedoch Regress beim KI-Anbieter nehmen, sei es über vertragliche Haftung oder die überarbeitete Produkthaftungsrichtlinie, je nach den Umständen.

Verlangt das belgische Recht, dass Fachleute den KI-Einsatz gegenüber Mandanten offenlegen?

Nicht ausdrücklich — noch nicht. Aber die allgemeine Transparenzpflicht und die standesrechtliche Ehrlichkeitspflicht legen nahe, dass eine wesentliche Abhängigkeit von KI-Tools offengelegt werden sollte, besonders wenn die KI-Ergebnisse den erteilten Rat unmittelbar formen. Das ITAA hat hierzu noch keine spezifischen Richtlinien herausgegeben.

Deckt die Versicherung KI-bezogene Berufsfehler ab?

Unklar. Viele Berufshaftpflichtpolicen haben eine „stille KI”-Deckung — KI-Risiken weder ausdrücklich eingeschlossen noch ausgeschlossen. Einige internationale Versicherer haben bereits KI-Ausschlüsse eingeführt. Die kollektive ITAA-Police deckt Fahrlässigkeit breit ab, aber KI-spezifische Ansprüche wurden noch nicht getestet. Diese Unsicherheit ist selbst ein Grund, verifizierbare KI-Tools zu nutzen, die das Fehlerrisiko reduzieren.

Verwandte Artikel

- Warum Transparenz wichtiger ist als Genauigkeit in juristischer KI → /de/blog/transparenz-vs-genauigkeit/

- Was ist Konfidenz-Scoring — und warum es ehrlicher ist als eine selbstbewusste Antwort → /de/blog/confidence-scoring-erklaert/

- Die EU-KI-Verordnung und juristische KI: was belgische Steuerfachleute wirklich wissen müssen → /de/blog/eu-ki-gesetz-rechts-ki/

Wie Auryth TX das umsetzt

Auryth TX ist für genau diese Haftungslandschaft konzipiert. Jede Antwort enthält Quellenangaben, die mit den spezifischen Bestimmungen, Urteilen oder Kommentaren verknüpft sind, die sie stützen. Konfidenzwerte signalisieren, wenn die abgerufenen Quellen die generierte Antwort schwach stützen — der Fachmann weiß so, wo sorgfältiger zu prüfen ist.

Das temporale Versionierungssystem verfolgt, welche Version jeder Bestimmung angewandt wurde, wann sie in Kraft trat und ob seither Änderungen veröffentlicht wurden. Gespeicherte Recherchen werden markiert, wenn sich das zugrunde liegende Recht ändert. Die vollständige Abfragehistorie bietet einen Prüfpfad, der den Rechercheprozess des Fachmanns dokumentiert.

Wir eliminieren die Haftung nicht — das belgische Recht erlaubt das nicht, und das sollte es auch nicht. Wir geben Fachleuten die Transparenz, die sie brauchen, um nachzuweisen, dass sie ihre Arbeit sorgfältig gemacht, ihre Quellen geprüft und das professionelle Urteil ausgeübt haben, das das Recht verlangt.

Quellen: 1. Selbst, A.D. (2020). „Negligence and AI’s Human Users.” Boston University Law Review, 100, 1315-1376. 2. Buiten, M.C., de Streel, A. & Peitz, M. (2023). „The Law and Economics of AI Liability.” Computer Law & Security Review, 48. 3. Bertolini, A. & Episcopo, F. (2023). „The European AI Liability Directives — Critique of a Half-Hearted Approach and Lessons for the Future.” Computer Law & Security Review.