Die nächsten Grenzen der KI jenseits der Skalierung

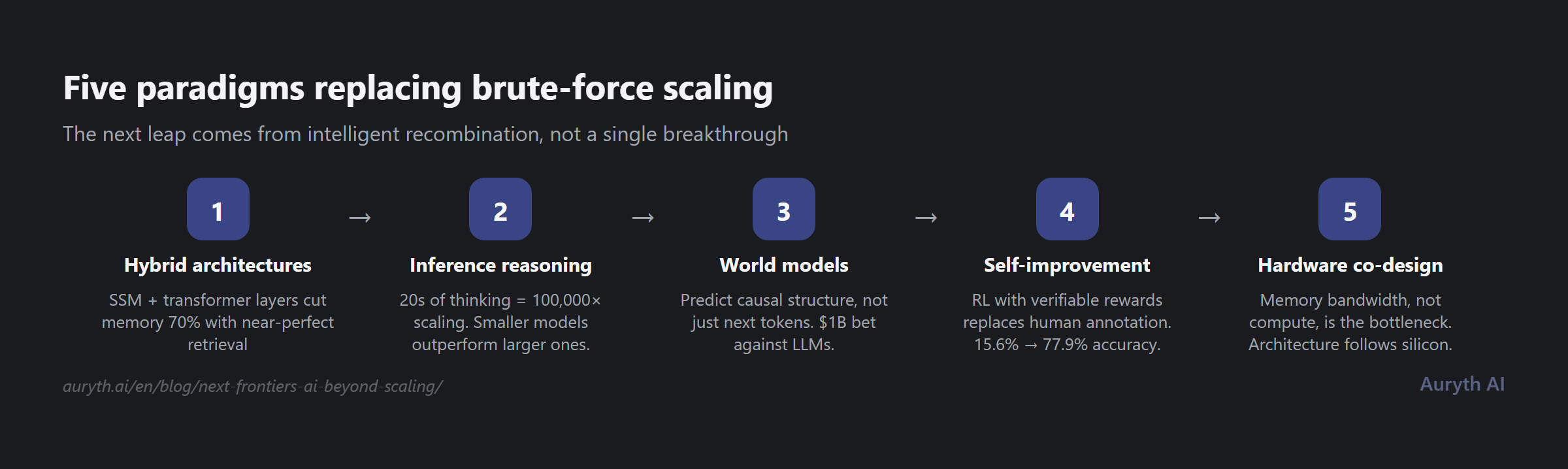

Die Ära immer größerer Modelle geht zu Ende. Fünf Paradigmen ersetzen die reine Skalierung — hybride Architekturen, Inferenz-Reasoning, Weltmodelle, Selbstverbesserungsschleifen und Hardware-Co-Design. Was das jeweils für KI in regulierten Branchen bedeutet.

Von Auryth Team

Die Architekten der KI-Skalierung erklären inzwischen selbst, dass ihr eigenes Paradigma ausgedient hat. Ilya Sutskever, dessen Arbeiten zu Skalierungsgesetzen die letzten fünf Jahre der KI-Forschung geprägt haben, sagte gegenüber The Decoder: „Wir bewegen uns vom Zeitalter der Skalierung zum Zeitalter der Forschung.” Yann LeCun verließ Meta, um über eine Milliarde Dollar darauf zu setzen, dass große Sprachmodelle eine Sackgasse sind. Selbst Dario Amodei weigert sich anzunehmen, dass höhere Ausgaben für Rechenleistung automatisch Fortschritt garantieren.

Das ist keine abstrakte Debatte. Wer in einer regulierten Branche arbeitet — Steuern, Recht, Compliance — wird erleben, dass die nächste Generation von KI-Werkzeugen davon abhängt, welches Paradigma sich durchsetzt. Zu verstehen, was kommt, hilft dabei, Substanz von Hype zu unterscheiden.

Die Kurzfassung: Fünf unterschiedliche Ansätze ersetzen die reine Skalierung, und jeder zielt auf eine andere Schwäche heutiger Systeme. Keiner wird allein gewinnen. Der nächste Sprung entsteht durch ihre Kombination.

Hybride Architekturen ersetzen leise den reinen Transformer

Die Transformer-Architektur, die heute jedes große Sprachmodell antreibt, hat ein grundlegendes Problem: Self-Attention skaliert quadratisch mit der Sequenzlänge. Doppeltes Kontextfenster bedeutet vierfache Rechenleistung. Bei ein paar tausend Tokens funktionierte das noch. Beim Durchsuchen ganzer Gesetzestexte versagt es.

Die Lösung besteht nicht darin, Transformers zu ersetzen — sondern sie zu verdünnen. Produktionssysteme von IBM, NVIDIA und AI21 verschränken Transformer-Attention-Schichten inzwischen mit State-Space-Model-Schichten (SSM). AI21s Jamba nutzt eine Attention-Schicht pro acht Schichten insgesamt. IBM Granite 4.0 verwendet eine von zehn. NVIDIAs Nemotron-H kommt mit rund 8 Prozent Attention aus.

Die Ergebnisse sind für professionelle Anwendungen relevant: 70 Prozent weniger Speicherverbrauch, zwei- bis fünfmal höherer Durchsatz und nahezu perfekte Dokumentensuche selbst mit minimalen Attention-Schichten.

Warum nicht ganz auf Attention verzichten? Weil eine Ablationsstudie aus 2025 ergab, dass das Entfernen aller Attention-Schichten die Retrieval-Genauigkeit auf exakt null sinken lässt. SSM-Schichten leisten allein keinen Beitrag zur Suche. Aber man braucht weit weniger Attention-Schichten als angenommen — bereits drei genügen für zuverlässiges Retrieval in einem 50-Schichten-Modell.

Für Retrieval-Augmented-Generation-Systeme wie das von Auryth ist das unmittelbar relevant. Hybride Architekturen ermöglichen schnellere Suche in größeren juristischen Datenbanken, längere effektive Kontextfenster für Querverweise zwischen Vorschriften und niedrigere Inferenzkosten pro Anfrage — ohne die Präzision zu opfern, die autoritätsgewichtetes Retrieval erfordert.

Inferenz-Reasoning tauscht Denkzeit gegen Modellgröße

Das wichtigste kürzlich entdeckte Skalierungsgesetz betrifft nicht das Training. Es betrifft die Inferenz.

Noam Brown von OpenAI brachte es auf den Punkt: Einem Modell 20 Sekunden Denkzeit für eine Pokerhand zu geben, lieferte denselben Leistungssprung wie eine 100.000-fache Skalierung des Modells bei 100.000-fach längerem Training. Die grundlegende Arbeit von Snell et al. zeigte, dass optimal eingesetzte Test-Time-Compute kleinere Modelle befähigt, deutlich größere in vergleichbaren Evaluierungen zu übertreffen.

OpenAIs o-Modellreihe nutzt umfangreiches Reinforcement Learning, um interne Gedankenketten zu erzeugen — einschließlich Rückverfolgung und Selbstkorrektur. Das o4-mini erreicht 99,5 Prozent bei mathematischen Wettbewerbsaufgaben zu etwa 30 Prozent der Kosten von o3.

Allerdings gibt es zwei harte Obergrenzen. Die Kostengrenze: Komplexe Anfragen können über das 100-Fache der Rechenleistung eines einzelnen Durchlaufs erfordern. Die Zeitgrenze ist subtiler und folgenreicher — wenn Evaluierungen drei Wochen dauern, weil das Modell drei Wochen zum Denken braucht, wird die Zeit selbst zum Engpass.

Die Forschung zeigt: Keine einzelne Reasoning-Strategie dominiert universell. Self-Consistency (Mehrheitsvotum) erreicht unabhängig von zusätzlicher Rechenleistung ein Plateau. Prozess-Belohnungsmodelle, die schrittweises Feedback geben, sind 8 Prozent genauer und bis zu fünfmal recheneffizienter. Varianten der Monte-Carlo-Baumsuche entscheiden dynamisch, ob neue Kandidaten exploriert oder bestehende verfeinert werden.

Für Konfidenz-Scoring im professionellen Einsatz hat das direkte Auswirkungen. Ein System, das bei mehrdeutigen Anfragen mehr Denkzeit investieren kann — und meldet, wenn seine Konfidenz niedrig ist — ist grundlegend nützlicher als eines, das jede Frage identisch verarbeitet. Die Herausforderung liegt darin, dies für den professionellen Echtzeitbetrieb rechenbar zu machen.

Weltmodelle und neurosymbolische Systeme zielen auf das Denken selbst

Der tiefste Graben in der KI-Forschung verläuft heute zwischen der Skalierung von Sprachmodellen und grundsätzlich anderen Ansätzen zum Verstehen.

LeCuns neues Unternehmen, AMI Labs, hat bei einer Bewertung von 3,5 Milliarden Dollar 1,03 Milliarden Dollar eingeworben — unter den Investoren NVIDIA, Bezos und Samsung —, um Systeme auf Basis der Joint Embedding Predictive Architecture (JEPA) zu bauen. Statt das nächste Token vorherzusagen, prognostiziert JEPA abstrakte Repräsentationen der Realität. Das Ziel ist kausales Verständnis statt statistischem Musterabgleich.

LeCuns Position ist unmissverständlich: „Wer sich für menschenähnliche KI interessiert, sollte nicht an LLMs arbeiten.”

Das pragmatische Gegenargument kommt von Systemen, die neuronale Netze mit formaler Verifikation verbinden. DeepMinds AlphaProof, veröffentlicht in Nature, kombiniert ein Sprachmodell mit Reinforcement Learning, um mathematische Aussagen in der formalen Sprache Lean zu beweisen. Bei der Internationalen Mathematik-Olympiade 2024 löste es Aufgaben, die nur fünf menschliche Teilnehmer bewältigten — und jeder Beweis wurde vom Theorembeweiser verifiziert. Halluzinationen sind ausgeschlossen.

Für juristische KI ist das bedeutsam, weil es eine tragfähige Architektur für nachweisbar korrektes Reasoning aufzeigt. Ein System, das seine eigenen Schlussfolgerungen formal gegen eine juristische Wissensdatenbank verifizieren kann — nicht nur abrufen und zusammenfassen, sondern logische Konsistenz beweisen — wäre ein qualitativer Sprung gegenüber aktuellen RAG-Ansätzen.

François Chollets ARC-AGI-Benchmark legt die Lücke weiterhin offen. Das beste kommerzielle Modell erreicht 37,6 Prozent bei Aufgaben, die echtes Reasoning statt Musterabgleich erfordern. Chollets zentrale Erkenntnis: „Die Reasoning-Leistung aktueller Frontier-KI bleibt grundlegend auf die Abdeckung des Trainingswissens beschränkt.” Menschliches Denken generalisiert über die Trainingsdaten hinaus auf eine Weise, die heutigen Systemen verschlossen bleibt.

Selbstverbesserung funktioniert, hat aber harte Grenzen

DeepSeek-R1 hat etwas Bemerkenswertes gezeigt: Die Anwendung von Reinforcement Learning direkt auf ein Basismodell, ausschließlich mit korrektheitsbasierten Belohnungen — ohne überwachtes Feintuning, ohne menschliche Demonstrationen — erzeugte ein Modell, das spontan Selbstverifikation und Reflexion entwickelte. Die Erfolgsquoten bei mathematischen Wettbewerbsaufgaben sprangen durch reines Reinforcement Learning von 15,6 auf 77,9 Prozent.

Doch dasselbe Paper deckte eine kritische Grenze auf: Reinforcement Learning bei kleineren Modellen „kann schlicht nicht mit Destillation von einem leistungsfähigeren Lehrermodell konkurrieren.” Ein destilliertes 32-Milliarden-Parameter-Modell übertraf größere Modelle, die eigenständiges Reinforcement Learning von Grund auf betrieben.

Reine Selbst-Bootstrapping-Ansätze stoßen an eine Decke. Man braucht zuerst ein starkes Lehrermodell. Das stellt die optimistischsten Visionen rekursiver Selbstverbesserung infrage, bestätigt aber einen differenzierteren Weg: Große Frontier-Modelle erzeugen verifizierte Reasoning-Spuren, die in kleinere Modelle destilliert werden, welche dann als Grundlage für die nächste Verbesserungsrunde dienen.

Die breitere Post-Training-Revolution hat sich von menschlichen Präferenzen hin zu verifizierbaren Belohnungen verschoben. Mathematische Korrektheit, Code-Ausführung, formale Beweissysteme — sie ersetzen teure menschliche Annotation durch automatisierte Verifikation. Dasselbe Prinzip steht hinter Auryths Konfidenz-Scoring: Verifizierbarkeit statt Selbsteinschätzung des Modells.

Model Collapse — der Qualitätsverlust, wenn Modelle auf ihren eigenen Ausgaben trainieren — ist real, aber beherrschbar. Die entscheidende Erkenntnis: Solange originale Realdaten im Trainingsmix verbleiben, wird der Collapse vermieden. Da über 74 Prozent der neu erstellten Webseiten inzwischen KI-generierten Text enthalten, ist Datenkuratierung mittlerweile genauso wichtig wie der Trainingsalgorithmus selbst.

Hardware ist die unsichtbare Hand hinter jeder Architektur

Transformers haben sich durchgesetzt — wegen GPUs, nicht trotz ihnen. Self-Attention ist dichte Matrixmultiplikation, die eine Hardware-Auslastung von 80 bis 90 Prozent erreicht. SSMs mit ihren rekurrenten Operationen kamen anfangs auf lediglich 10 bis 15 Prozent — und waren damit in der Praxis langsamer, trotz besserer theoretischer Skalierung.

Die Speicherbandbreitengrenze ist zur dominierenden Einschränkung geworden. Sprachmodell-Inferenz ist durch Speicherbandbreite limitiert, nicht durch Rechenleistung. Deshalb liefert Cerebras mit seiner enormen On-Chip-Speicherbandbreite etwa die doppelte Geschwindigkeit von NVIDIAs neuester Hardware bei großen Modellen.

Der Energieverbrauch wird zunehmend zum architektonischen Treiber. US-Rechenzentren verbrauchten 2024 insgesamt 183 Terawattstunden. Der Energieverbrauch allein durch KI könnte bis 2026 jährlich 134 Terawattstunden erreichen — das entspricht dem Gesamtverbrauch Schwedens. Dieser thermodynamische Druck begünstigt Architekturen, die pro Anfrage nur einen Bruchteil ihrer Parameter aktivieren: Mixture-of-Experts-Modelle, aggressive Quantisierung und potenziell neuromorphe Ansätze.

Für professionelle KI-Anwendungen hat der Hardware-Trend eine konkrete Konsequenz: Die Inferenzkosten werden darüber entscheiden, welche KI-Werkzeuge im großen Maßstab wirtschaftlich tragfähig sind. Architekturen, die mit dem geringsten Rechenaufwand pro Anfrage genaue Ergebnisse liefern — genau die Effizienz, die hybride Suche und gezieltes Retrieval bieten — werden das Rennen um den Produktiveinsatz gewinnen.

Was das für KI in regulierten Branchen bedeutet

Fünf Paradigmen laufen zusammen. Hybride Architekturen liefern Geschwindigkeit und Skalierbarkeit. Inferenz-Reasoning ermöglicht Tiefe bei schwierigen Problemen. Weltmodelle versprechen kausales Verständnis. Selbstverbesserungsschleifen reduzieren die Abhängigkeit von menschlicher Annotation. Hardware-Beschränkungen erzwingen Effizienz.

Für Fachleute, die bei ihrer Recherche auf KI angewiesen sind — in Steuern, Recht, Compliance — ergeben sich drei Konsequenzen.

Erstens: Genauigkeit wird sich nicht durch größere Modelle verbessern, sondern durch bessere Reasoning-Architekturen. Systeme, die bei schwierigeren Anfragen mehr Rechenleistung einsetzen, ihre eigenen Schlussfolgerungen verifizieren und echte Unsicherheit melden können, werden Systeme ablösen, die jede Frage gleich behandeln.

Zweitens: Retrieval-basierte Systeme werden wichtiger, nicht weniger wichtig. Während Sprachmodelle an Datengrenzen und Skalierungsplateaus stoßen, wird die Fähigkeit, autoritative Quellen zu durchsuchen, zu gewichten und zu zitieren — der Kern dessen, was Auryth entwickelt — zum Differenzierungsmerkmal gegenüber den Trainingsdaten allein.

Drittens: Die Kosten der KI-Inferenz werden darüber entscheiden, welche Werkzeuge wirtschaftlich überleben. Architekturen, die professionelle Genauigkeit bei tragbaren Rechenkosten liefern, werden sowohl billige, aber unzuverlässige Chatbots als auch teure, aber brillante Frontier-Modelle hinter sich lassen. Die optimale Lösung sind Retrieval-Augmented-Systeme mit gezieltem Reasoning — präzise, wo es darauf ankommt, effizient überall sonst.

Die Ära des „Einfach größer machen” ist vorbei. Die Ära des „Klüger machen” hat begonnen.