AI implementeren in uw fiscale praktijk: waarom vertrouwen belangrijker is dan technologie

De meeste AI-implementaties mislukken omdat kantoren de vertrouwensfase overslaan. Een praktisch 4-fasenmodel voor Belgische fiscale praktijken.

Door Auryth Team

U kocht de tool. U deed de demo. Iedereen was onder de indruk. Drie maanden later gebruiken twee mensen het — en een van hen is de vennoot die het contract ondertekende.

Dit scenario speelt zich wereldwijd af in professionele dienstverlening. Onderzoek van BCG naar enterprise AI-adoptie toont aan dat succesvolle implementatie uit drie componenten bestaat: 10% algoritmen, 20% technologie-infrastructuur en 70% organisatorische transformatie. Toch besteden de meeste kantoren 90% van hun implementatie-inspanning aan de eerste twee.

In Belgische fiscale praktijken is de kloof nog groter. Fiscalisten dragen beroepsaansprakelijkheid voor hun advies onder de ITAA-deontologische code. Wanneer u hen vraagt een AI-tool te vertrouwen, vraagt u hen niet om nieuwe software te leren — u vraagt hen om hun professionele reputatie op het spel te zetten. Geen wonder dat de demo alleen het gedrag niet verandert.

De vertrouwenskloof waar niemand over praat

De cijfers zijn ontnuchterend. Onderzoek toont consequent aan dat ongeveer 80% van enterprise AI-projecten hun beoogde doelen niet haalt. PwC Belgium’s eigen enquête stelde vast dat slechts 21% van Belgische bedrijven voorbij de AI-pilotfase is geraakt.

Maar hier wordt het tegenstrijdig: België behoort tot de top drie van EU-landen voor AI-gebruik op de werkplek volgens Eurostat. Belgische professionals zijn niet technofoob — ze zijn kritisch. Ze hebben ChatGPT geprobeerd voor fiscale vragen. Ze hebben het artikelnummers zien verzinnen. Ze weten hoe slechte AI eruitziet.

Het probleem is geen weerstand tegen technologie. Het is weerstand tegen ongeverifieerde autoriteit.

Tech-first vs trust-first: twee aanpakken, één winnaar

De meeste implementatiegidsen lezen als producthandleidingen: installeren, configureren, trainen, uitrollen. Dit is de tech-first-aanpak, en die mislukt omdat ze adoptie behandelt als een software-rollout in plaats van een gedragsverandering.

| Tech-first-aanpak | Trust-first-aanpak | |

|---|---|---|

| Week 1 | Volledige teamtraining, alle functies | Eén persoon, één use case |

| Maand 1 | Iedereen zou het moeten gebruiken | Pilotgebruiker verifieert 20 antwoorden handmatig |

| Maand 3 | ”Waarom gebruikt niemand het?” | Pilotgebruiker deelt geverifieerde resultaten met team |

| Maand 6 | Abonnement opgezegd | Team bouwt gedeelde querybibliotheek |

| Resultaat | Shelfware | Ingebed werkflowtool |

De trust-first-aanpak is trager. Het is ook de enige die werkt.

De 20-antwoordenregel

Voordat iemand in uw kantoor een oordeel vormt over een AI-tool, moet één persoon 20 antwoorden handmatig verifiëren. Niet 5 — dat is te weinig om randgevallen tegen te komen. Niet 50 — dat is te veel om motivatie vol te houden. Twintig.

Dit is wat die 20 antwoorden u leren:

- Antwoorden 1–5: U leert waar de tool goed in is. Eenvoudige opzoekingen, tariefbevestigingen, artikelidentificatie.

- Antwoorden 6–12: U vindt de eerste beperkingen. Een ontbrekende bron, een verouderde referentie, een vraag die het onhandig behandelt.

- Antwoorden 13–20: U ontwikkelt gekalibreerd vertrouwen. U weet wanneer u op de output kunt steunen en wanneer u extra moet controleren. Dit is expertise die geen demo kan bieden.

Gekalibreerd vertrouwen is waardevoller dan blinde zekerheid.

De persoon die dit proces doorloopt, wordt de AI-kampioen van uw kantoor — niet omdat die werd aangewezen, maar omdat die zijn eigen overtuiging heeft opgebouwd.

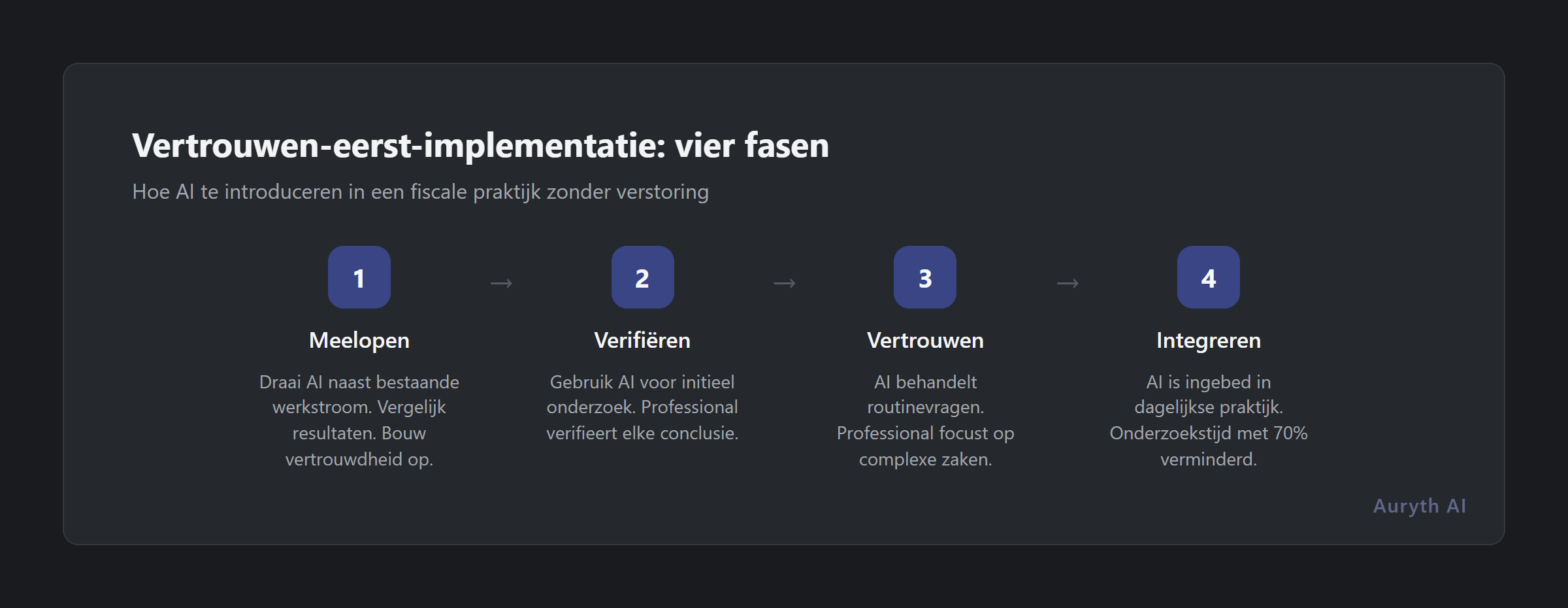

Een implementatiemodel in vier fasen

Fase 1: Verkennen (weken 1–2). Eén persoon. Eén use case. Kies de professional die het nieuwsgierigst is, niet de meest senior. Kies een afgebakend toepassingsgebied — TOB-tariefopzoekingen, artikelidentificatie of zoeken naar rulings. Het doel is nog geen productiviteit. Het is vertrouwdheid.

Fase 2: Verifiëren (weken 3–6). De 20-antwoordenregel. Uw pilotgebruiker voert 20 echte queries uit van lopende cliëntdossiers. Voor elk antwoord verifieert die tegen primaire bronnen: Fisconetplus, Jura, de wettekst zelf. Ze documenteren wat correct was, wat onvolledig was, wat fout was. Dit verificatielogboek wordt het waardevolste implementatie-instrument van uw kantoor.

Fase 3: Uitbreiden (maanden 2–3). Deel bewijs, geen enthousiasme. De pilotgebruiker presenteert het verificatielogboek aan het team — niet “deze tool is geweldig” maar “hier zijn 20 vragen die ik heb getest, hier is wat het goed had, hier is waar het correctie nodig had.” Collega’s vertrouwen bewijsmateriaal van peers meer dan demo’s van leveranciers. Breid uit naar 2–3 gebruikers en bredere use cases: cross-domein vragen, temporele queries, regionale vergelijkingen.

Fase 4: Integreren (maanden 4–6). Bouw institutionele kennis op. Maak een gedeelde querybibliotheek — sjablonen voor terugkerende onderzoekspatronen. Documenteer welke vraagformuleringen de beste resultaten opleveren en welke onderwerpen extra verificatie nodig hebben. Maak de tool onderdeel van de werkflow, geen afzonderlijke stap.

Waar het misgaat: drie implementatiekillers

De sprong van demo naar deployment. Van een indrukwekkende demo rechtstreeks naar kantoor-brede uitrol. Zonder de vertrouwensfase stort adoptie binnen weken in. Dit is de meest voorkomende faalmodus — en de meest vermijdbare.

Overmatig vertrouwen zonder verificatie. De tegenovergestelde fout: een gebruiker die te snel vertrouwt, stopt met verifiëren en uiteindelijk advies produceert op basis van incorrecte AI-output. Eén slechte ervaring vergiftigt de put voor het hele team.

Onderbenutting door wantrouwen. Een gebruiker die gedwongen werd de tool te gebruiken, het nooit vertrouwde en het alleen gebruikt voor triviale opzoekingen die handmatig sneller zouden gaan. De ROI komt nooit omdat de tool op 10% van zijn capaciteit draait.

Alle drie de faalscenario’s delen dezelfde oorzaak: Fase 2 overslaan.

Meten wat er echt toe doet

Vergeet feature-adoptiemetrieken. In een fiscale praktijk vertellen drie cijfers u of AI-implementatie slaagt:

| Metriek | Wat het meet | Gezond streefcijfer (maand 6) |

|---|---|---|

| Queries per professional per week | Werkelijke gebruiksdiepte | 8–15 queries |

| Complex query-ratio | Vertrouwensrijpheid | >40% cross-domein of temporeel |

| Zelfgerapporteerde tijdsbesparing per dossier | Ervaren waarde | 30–60 minuten |

Als queries hoog zijn maar complexiteit laag, gebruikt uw team AI als zoekmachine — niet als onderzoekstool. Als complexiteit hoog is maar queries laag, groeit het vertrouwen maar is de gewoonte nog niet gevormd.

Veelgestelde vragen

Hoe lang duurt volledige AI-implementatie in een fiscale praktijk?

Reken op 4–6 maanden van eerste login tot ingebedde werkflow. De eerste twee weken zijn verkenning; de echte adoptiecurve begint na de 20-antwoorden verificatiefase. Kantoren die dit proberen te comprimeren tot 2 weken rapporteren consequent lagere adoptiecijfers.

Moeten we beginnen met senior vennoten of junior medewerkers?

Geen van beide. Begin met de meest nieuwsgierige professional, ongeacht anciënniteit. Nieuwsgierigheid voorspelt adoptie beter dan autoriteit of technische vaardigheid. De rol van de kampioen is om bewijs op te bouwen dat anderen overtuigt — dat vereist oprechte interesse, geen mandaat.

Wat als de tool iets fout heeft tijdens de verificatiefase?

Dat is precies de bedoeling. Fouten vinden tijdens gecontroleerde verificatie is het beste wat kan gebeuren. Het leert gekalibreerd vertrouwen en geeft de pilotgebruiker specifieke kennis over de grenzen van de tool. Een fout gevonden in Fase 2 bouwt meer vertrouwen op dan tien correcte antwoorden tijdens een demo.

Gerelateerde artikelen

- Hoe een juridische AI-tool evalueren: 10 vragen die er echt toe doen → /nl/blog/juridische-ai-tool-evalueren/

- “Ik vertrouw AI niet voor fiscaal advies” — en u hebt gelijk → /nl/blog/ai-weerstand-fiscaal-advies/

- Hoeveel tijd bespaart fiscale AI werkelijk? Een eerlijke inschatting → /nl/blog/tijdsbesparing-fiscale-ai/

Hoe Auryth TX dit toepast

Auryth TX is ontworpen voor trust-first-adoptie. Elk antwoord toont zijn bronvermeldingen — de specifieke artikelen, rulings en commentaar die het heeft opgehaald. Betrouwbaarheidsscores vertellen u hoe zeker het systeem is, zodat u weet wanneer u extra moet verifiëren en wanneer u op de output kunt vertrouwen.

Het platform ondersteunt het 20-antwoorden verificatieproces op natuurlijke wijze: elk antwoord bevat de primaire bronnen zodat u ze zelf kunt controleren tegen Fisconetplus of de wettekst. Exportfuncties laten u uw verificatielogboek opslaan en delen met collega’s.

Begin met een gratis proefperiode van 14 dagen. Verifieer de eerste 20 antwoorden zelf. Oordeel dan.

Bronnen: 1. Yang, Y. et al. (2024). “Artificial Intelligence in Auditing: A Framework and Assessment.” Auditing: A Journal of Practice & Theory. 2. Daly, S. et al. (2025). “Trust and AI Adoption in Organizations.” Technological Forecasting and Social Change. 3. Ibrahim, M. et al. (2025). “Technology Acceptance Model for AI in Professional Services.” Information Systems Frontiers.